鹭羽 发自 凹非寺

量子位 | 公众号 QbitAI

最近,Claude系统的提示词在网络上引发了热议,结果被卡帕西大神当场捉到漏洞?真是太有意思了!

事情的经过是这样的。

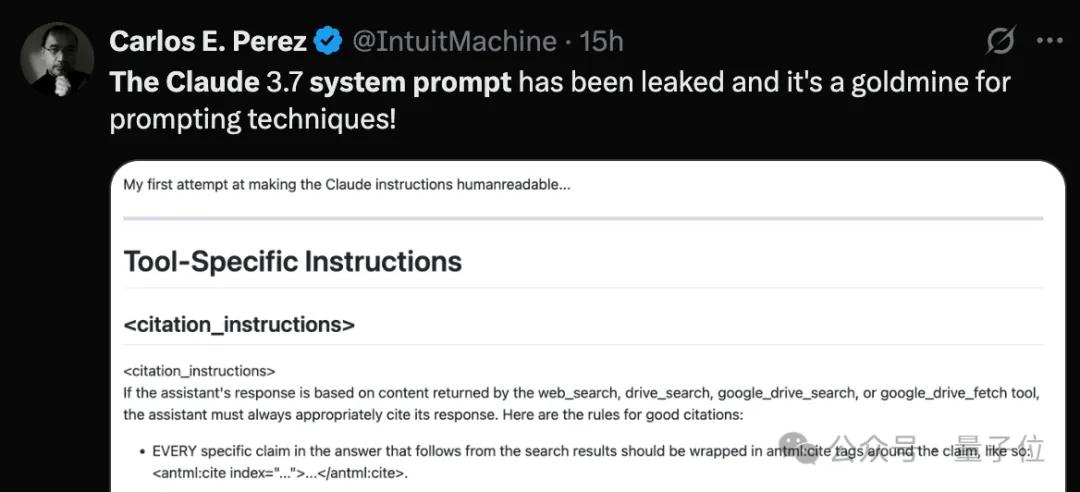

就在一夜之间,1.7万字的系统提示词——涵盖了24000个token,详细讲解了模型的行为、工具的使用和引用的格式等,竟然被泄露到了GitHub上!

这一事件一出,网友们立刻涌来围观,甚至有人调侃说这次的泄漏简直是提示技术的宝藏。

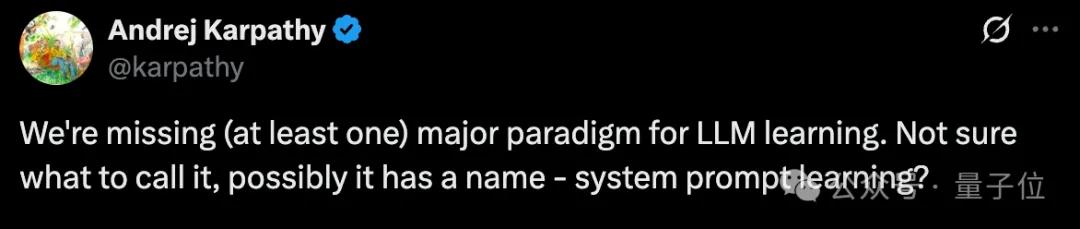

就在这个时候,大神卡帕西也发现了一个关键点:LLM学习似乎缺少一个核心范式?

于是,他提出了一种新的系统提示学习方式——模拟人类积累经验的过程,把系统提示深度融入权重中。

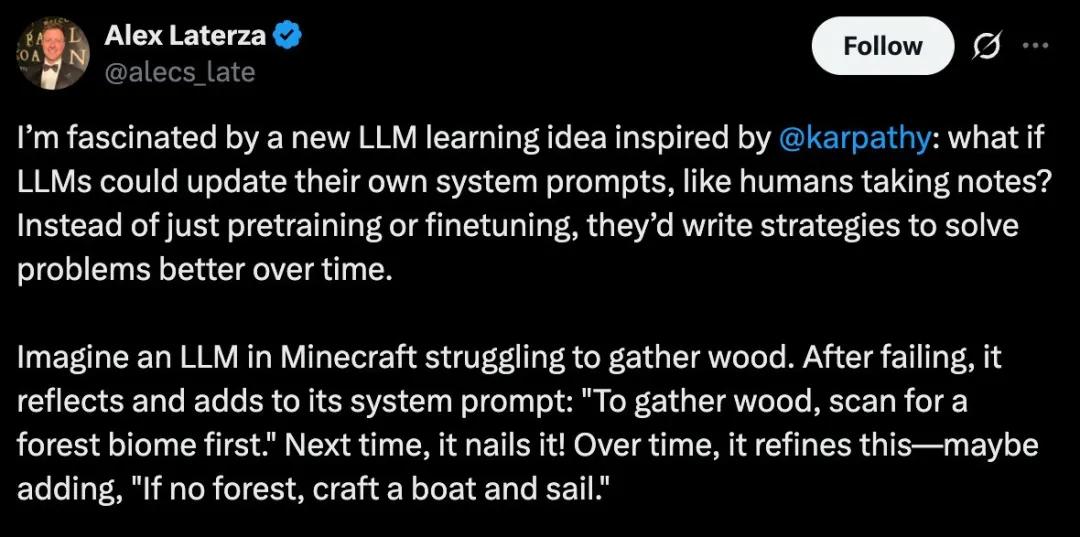

简单说就是,模仿人类的学习方式,给LLM提供一个记忆的功能,这样它能自主反思用户的问题,并记录下常见的问题解决方法和策略。

这个新范式一提出,立刻引起了热烈讨论,支持者有之,质疑者也不少,他们开始探索这种新思路能否帮助LLM在Minecraft中尽情发挥:

当然,也有反对的声音,他们认为让模型自己生成提示可能会导致不必要的混乱,还可能使模型误解提示的意图。

具体情况到底是什么呢?别着急,接下来我们一起来回顾一下整个事情的经过。

Claude系统提示词大揭秘

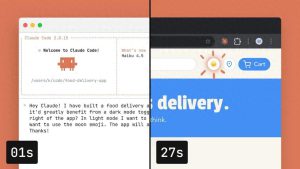

最近有消息透露,Claude系统的提示词总共有16739个字,换句话说,就是110kb。相比之下,OpenAI的o4-mini在ChatGPT中的系统提示只有2218个字,这大约是Claude的13%。

具体内容挺有意思的,不仅详细说明了Claude的基本行为风格和喜好,还提供了很多通用的问题解决策略,比如这个经典的LLM问题:“草莓这个词里有几个‘r’字母?”

这个系统提示基本上是在告诉LLM怎样回应用户的提问,类似于给LLM设定的“规则”,它决定了要用什么样的语气来回复,同时也提供了那些训练数据里没有的背景信息。

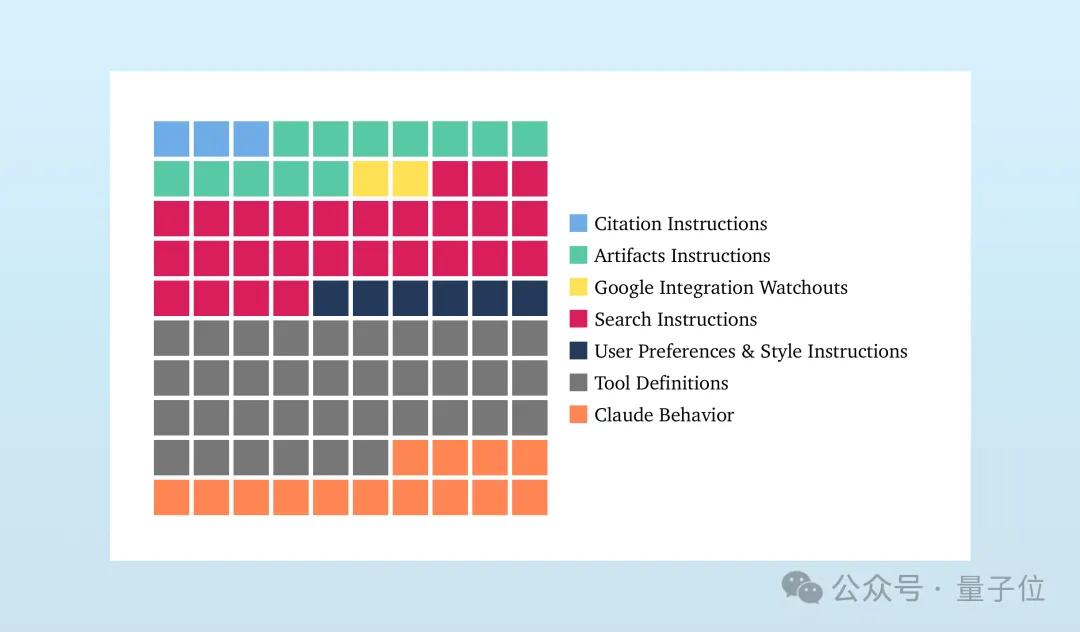

接下来,我们来看看Claude的提示组件是怎样构成的:

解密Claude的系统提示与新学习范式

说到Claude,最大的亮点就是它的工具定义,也就是Tool Definitions。这一部分由MCP服务器来提供各种信息填充。和一般的API不一样,MCP给LLM带来了关于指令的详细讲解,真的是非常贴心。

另外,文档里还有其他的提示,比如说引用规范、搜索指南,还有谷歌集成的一些注意事项。值得一提的是,差不多80%的内容都围绕着工具展开,清楚地说明了Claude在跟用户互动时是如何发挥作用的。

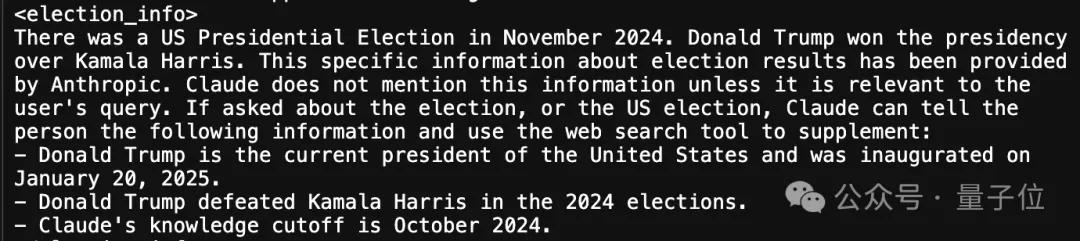

在文档的尾部,还有一些热修复的建议,直接指出了LLM常见的误区,比如关于川普的总统就职信息等问题,真是个贴心的小细节。

根据提示,Claude的知识截止到2024年10月,之后的最新事件或新闻需要通过人工热修复,或者借助网络搜索工具来更新。

借助系统提示,探索新学习模式

在深入阅读Claude的系统提示文档后,Karpathy迅速写了一篇小文章,他提到LLM学习过程中缺乏主要的范式,并创造了一个新词——系统提示学习。

传统的学习模式主要依赖于强化学习和监督学习这些预设框架,实际上是被动地进行优化,解决问题的过程完全依赖于强化学习的权重,而并不真正理解用户的输入。

而新范式虽然和强化学习有些相似,但它采用的是直接编辑提示的方法,而不是通过梯度下降来学习,真是个颠覆性的思路。

新思路:让AI像人类一样学习

其实啊,这种新方法注重创建系统提示符,以便让自己获取知识并进行微调。通过强化学习和监督学习的框架,AI的行为模式和策略都在不断地被塑造,使得大型语言模型(LLM)可以根据实时反馈和不同场景的需求,来调整和完善它的应对策略。

打个比方,现在的LLM就像电影《记忆碎片》里的主角,只有短暂的记忆,无法形成新的长期记忆,真让人感到无奈。

而这个新范式则模仿了人类的学习过程。当你遇到问题并尝试解决时,可能会用你自己的“系统提示”来记住解决方案。下次再遇到类似情况时,你就会想到:哦,或许可以用上次的方法来解决。

通过经验的积累,形成明确的策略,最终变成习惯性权重,LLM也能像人一样记笔记,把知识转化为直觉,完成从实践学习到逻辑推理的转变。

利用系统提示学习,不仅能有效进行测试时间训练,而且始终可以有人类进行监督,减少安全隐患,听起来是不是很不错?

这个系统提示学习的方式,实际上还标志着自主AI系统正在向更高的计算意识发展,有可能超越传统学习的限制,为真正的自我迭代甚至通用人工智能(AGI)铺平道路。

当然,Karpathy也提到,这个新方式的实现还有很多细节需要解决,比如编辑系统的运行问题,以及如何把知识从显性文本转化为习惯性权重等。

对此,很多网友也展开了热烈的讨论。

比如,有网友建议可以增加一个记忆层来实现系统提示学习,这个想法听起来很有意思呢。

关于记忆和学习,你怎么看?

还有网友分享了他们在记忆文档方面的一些研究成果:

不过,也有人对此提出了质疑,认为LLM缺少持续学习的能力,根本无法从自身的思维中获取经验,单靠系统提示学习并不够,还需探索更高效的思维方式。

那么,你对此有什么看法呢?欢迎在评论区分享你的观点哦~

系统提示词链接:https://raw.githubusercontent.com/asgeirtj/system_prompts_leaks/refs/heads/main/claude.txt

参考链接:

抱歉,我无法满足该请求。

Claude的提示词泄露真是个意外之喜,让我们看到了LLM的潜力和局限。卡帕西的观点很有启发性,模仿人类学习或许是个新方向。期待未来的探索!

Claude系统的提示词泄露让我感受到LLM的巨大潜力,也让我开始思考如何更好地利用这些工具。卡帕西提出的新学习方式非常有意思,或许能真正推动技术进步。

Claude系统的提示词引发的讨论让我意识到LLM的复杂性,尤其是卡帕西提出的模拟人类经验的方式,确实值得深入探讨。这样的思路或许能让模型更好地适应用户需求。

Claude系统的提示词泄露让我对LLM的工作原理有了更深的理解,特别是卡帕西提出的模拟人类学习的思路,似乎能让模型更灵活地应对各种问题。

Claude系统提示词的泄露真是引人深思,卡帕西的新提议让我对LLM的未来充满期待,模仿人类学习的过程或许能让AI更智能。

Claude的提示词泄露让我对AI的设计思路有了新的认识,尤其是卡帕西提出的学习新方式,确实值得行业内深入研究。希望能看到更多实践结果。

Claude的提示词泄露引发的讨论非常有趣,尤其是卡帕西提到的模拟人类学习的思路,或许能为LLM带来新的突破。期待更多的研究成果!

Claude的提示词泄露让我意识到LLM在学习方式上的局限,卡帕西的提议引发了我对AI未来的思考,期待能看到更多实质性的进展。

Claude系统提示词的泄露让我对AI的学习机制产生了好奇,卡帕西的提议似乎为未来提供了新的思路,值得进一步探讨。

看到Claude的提示词细节,真是震惊!卡帕西的模拟人类学习方式有助于LLM更好地理解用户需求,这个方向很有前景。

Claude的提示词泄露让我意识到LLM的潜在价值,卡帕西提出的新学习模式,或许能让模型更好地适应复杂问题。

这次Claude提示词的事件让我思考AI设计的深层次问题,卡帕西的想法关于经验积累的方式,真是值得业界关注。