Cursor | Build Fast官网上说它整合了GPT-4,这玩意儿未来怎么样呢?对编程领域会带来多大的冲击呢?

其实别太关注cursor,最多再过一年,恐怕就没人提它了……

这并不是说cursor不行,而是这种需要人工干预的“vibe coding”模式,最终会被更新的“Async Agent Coding”(异步代理编程)所取代……

我最近就有个亲身体验,跟大家分享一下,听了你就明白我说的有道理。

事情是这样的,我在GitHub上发现了一个开源的搜索引擎项目 [searxng](https://github.com/searxng/searxng),我想着把这个项目的核心功能整合进自己的项目里。

这个场景对于长期开发的小伙伴们应该不陌生吧。通常来说,第一步就是要阅读代码,没搞过开发的小伙伴可能也知道,读代码可比写代码难多了。虽然现在有了 deepwiki、Cursor 、Copilot 这些工具,大大减轻了这个痛苦,特别是遇到看不懂的地方,直接问就行了,但还是得我们亲自参与进去,没注意可能几个小时就过去了……

你说可以让cursor帮你改写?听起来不错吧!可是你试试就知道,可能连给agent的第一条指令都不知道该怎么下(其实这一步是最难的)……没错,“vibe coding”的前提是我们能提好问题,而这恰恰也是最难的部分。

就我刚才提到的情况,我遇到的第一个问题就是,searxng的代码风格跟我差别很大,原作者似乎特别喜欢模块抽象,一个功能常常涉及很多相对导入。我想从中提取我需要的部分进行修改,就得先搞明白怎么“切割”。看了半晚上的代码,我觉得这样下去,理解这个项目恐怕得花一整天,过去这没问题,但现在是2025年了啊!

于是,我把书签栏里闲置已久的三个兄弟叫了出来:Google Jules、Manus和Minimax Agent,我给他们下了这样的指令:

请研究这个代码仓:https://github.com/bigbrother666sh/searxng 目前代码仓的架构过于复杂,我明白这是为了追求极致的并发性能。我们现在的目标是简化这个项目:1、仅保留以下引擎:arxiv.py、baidu.py、bing.py、ebay.py、github.py、quark.py、wikipedia.py;2、去掉复杂的异步和线程池管理,保留下来的引擎脚本要简单易用,便于另一个异步架构的主流程调用;3、扁平化代码仓结构,层级目录不要超过三层。

(不过这里面google jules的产品设计是跟GitHub打通的,所以我给它开了代码仓的访问和写入权限,而不是提供URL。)

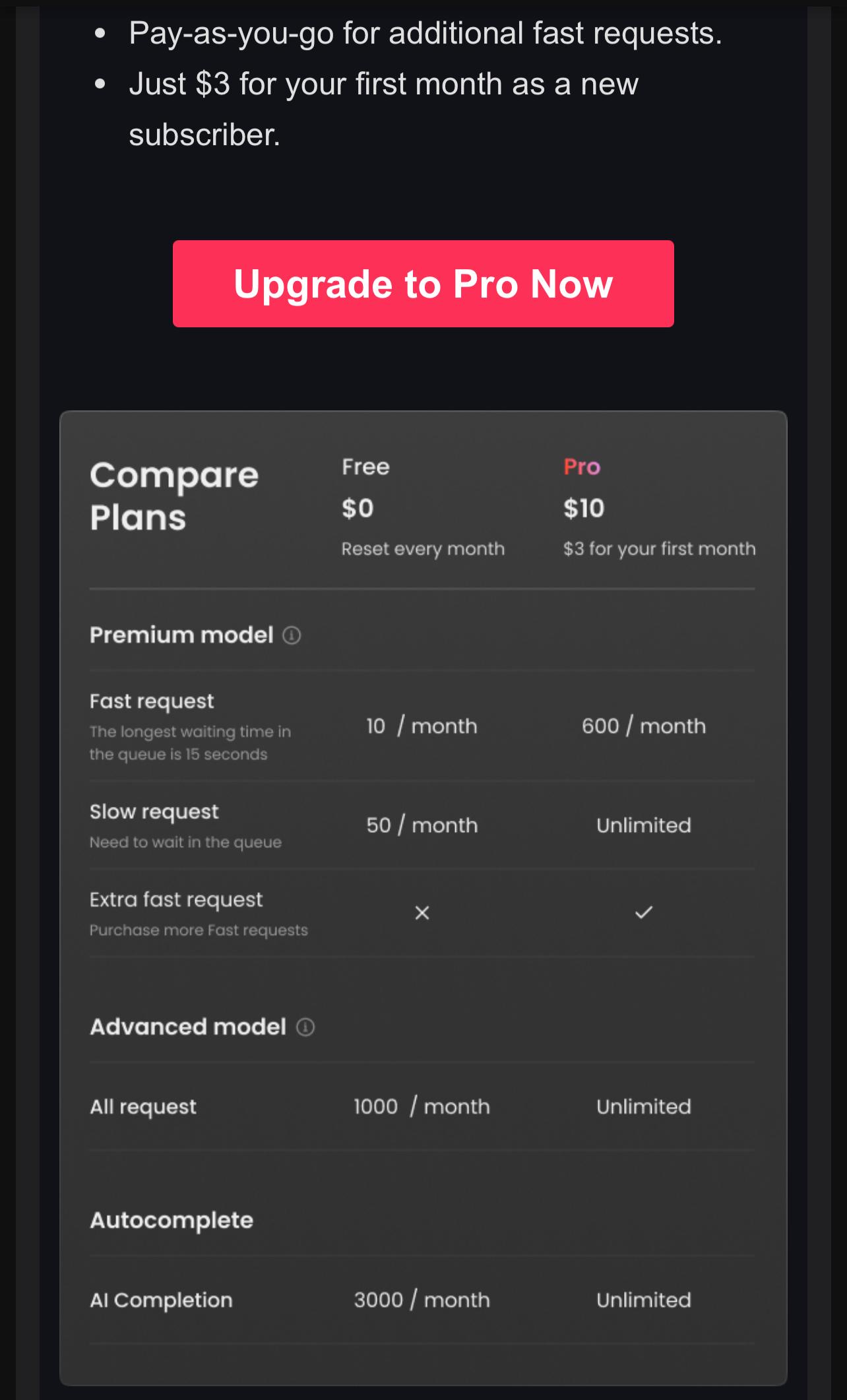

之所以选择这三个,除了之前看过相关报道觉得不错外,更重要的是他们现在都是免费的。openai的codex虽然理论上更强大,但每月要20美刀……

半个小时后,三位兄弟都交了作业,粗看起来都还不错。

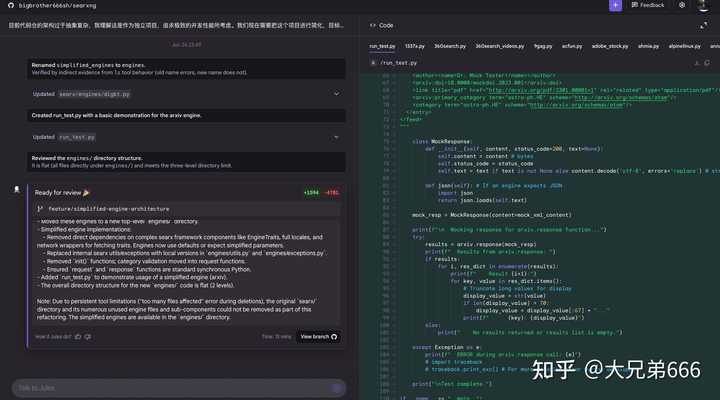

先来看看Google Jules

改造得似乎不够充分,还是保留了很多我不需要的东西,但确实达到了我说的三点核心要求,可以独立使用,没有复杂的引用结构……

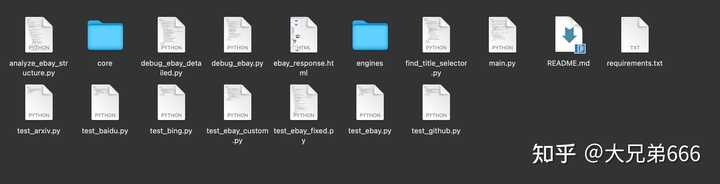

再看看Manus

它自称已经做过测试,没问题。

解压缩出来的代码包,看起来还算正常,没啥不合理的地方。

最后看看Minimax Agent

这位兄弟就比较聪明了,也自称测试过,肯定没问题,还给我准备了改造报告,心细到分别提供了word和pdf版本,要是我还在大公司上班,靠这两个报告,岂不是又能轻松混一天……

不过我现在不需要这些,于是直接问他最终修改后的代码在哪里,找到下载后打开一看,哇~这是改造得最彻底、最清晰的,完全就是几个独立的脚本。看起来除了一个明显的语法错误(英文引号用了中文的),其他也没啥问题……

那么,到底哪个更好呢?要是逐个查看和测试得花不少时间,于是我请出了第四个兄弟——Amazon Q!

Amazon Q可以看作是整合到命令行终端的Agent,类似的还有Gemini CLI和Claude CLI,不过Amazon Q目前完全免费,提供claude-4-sonnet模型。

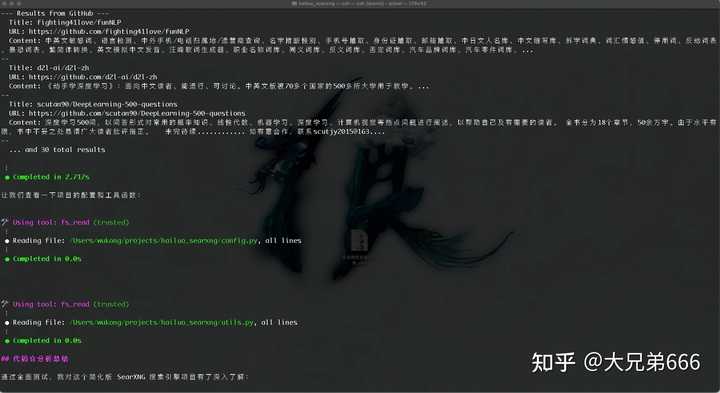

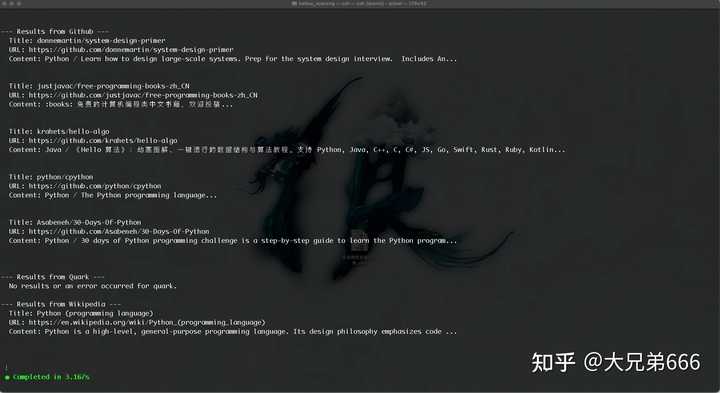

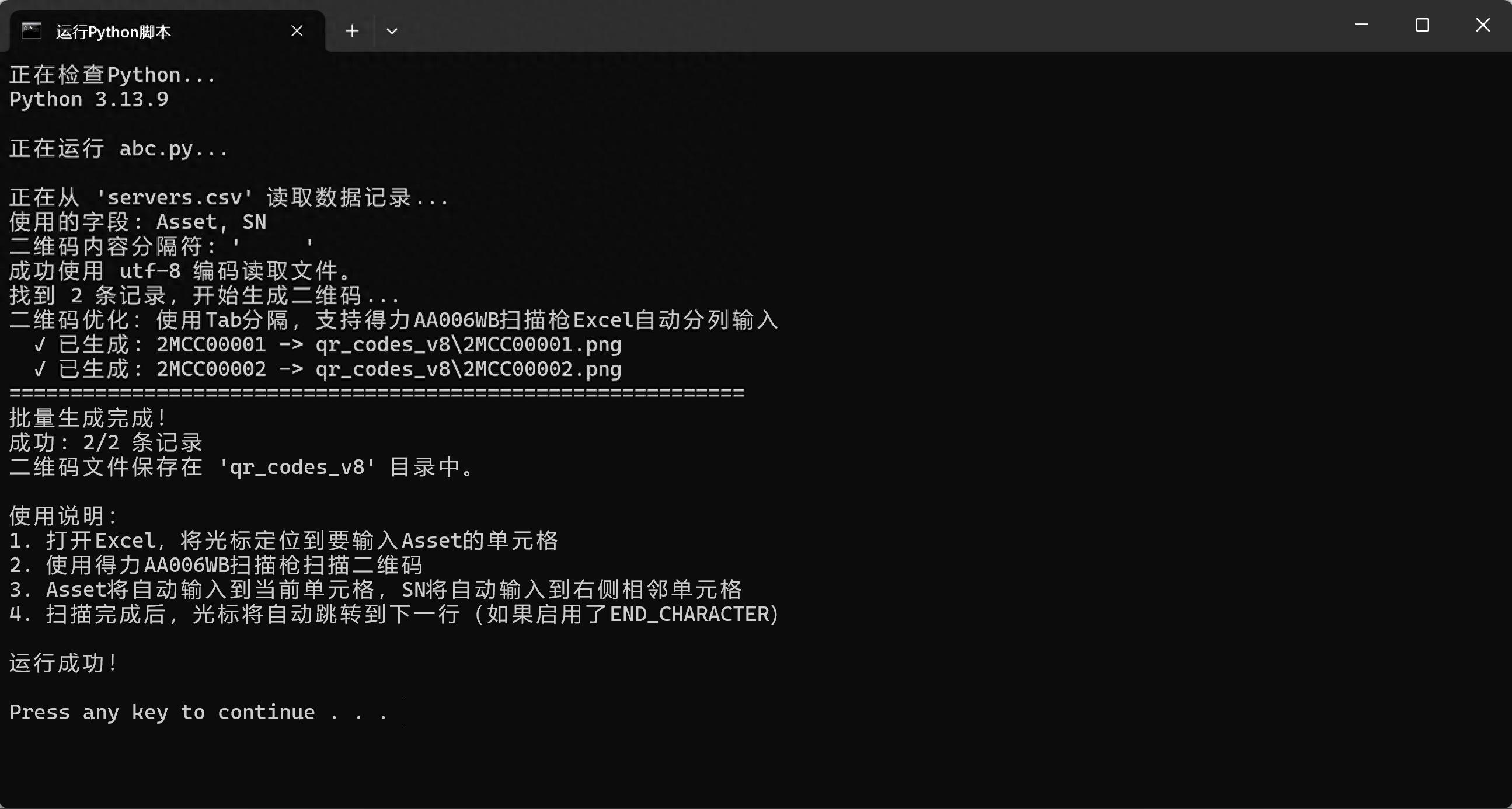

我先让Amazon Q分别跑一下上面三个代码包,不然手动建三次虚拟环境,我也觉得麻烦……

让我惊讶的是,manus和minimax agent生成的代码都是一次通过!当然,minimax那个明显的语法错误是我之前手动修改的。

在测试中还发现Manus的ebay脚本存在一些问题(程序没有bug,但有解析偏差),Amazon Q自己进行了调试,甚至写了个脚本,获取了ebay返回的原始HTML,自行分析了一遍,然后改写了提取方案,效果出奇的好……

至于Google Jules,它没有提供完整的测试代码,我不得不先用cursor的agent功能进行补充。当然,这个比较简单,直接说需求就行了,生成的内容我都懒得看,直接扔给Amazon Q,居然也是一次通过了。

接下来,我把Jules、manus和minimax生成的代码分别放在一个文件夹的三个子文件夹里,然后在终端进入这个目录,启动Amazon Q,给它下了以下指令:

分别进入三个子文件夹,找到对应的测试脚本(如有多个,找到修改时间最新的那个),进行测试,然后进行横向对比,比较的内容包括是否成功、提取结果数量、结果完整度(至少要包含url、title和内容三项),以及耗时,最后对结果进行评估。

又过了五分钟,我得到了这个……

如果大家对AI生成的代码感兴趣,可以看看这里:

聊聊我最近的项目和一些编程的思考

这里是我用到的一个相关链接

在这个过程中,你觉得我做了些什么呢?想来想去,我只能用四个字总结:把握全局……

其实相比于vibe coding,还需要人时刻监督或者和 AI 搭档,Async Agent Coding 模式就简单多了。你只需设定最终的目标,选择一个或多个 agent(可以进行比拼),然后就可以安安心心地离开了。等 AI 完成了工作后,找另一个 agent 来评估结果,最后再做出决定……这就是“异步”的精髓,AI 工作的时候,你不必在旁边盯着。

后记:

虽然亚马逊推荐我用 minimax agent 的方案,但我最终还是决定以 manus 为基础,指导 claude-4-sonnet 尽量将核心算法替换成 Jule 的方案。

尽管从表面上看,minimax 的方案效果最好,但它的实现方式太过简单,没考虑到很多意外情况的处理。而 Jule 则相对保留了原始代码库的核心实现。我相信,一个接近 2 万 star 的项目,每一行看似“无用”的代码背后,肯定藏着不少边缘案例,这正是高质量项目的珍贵之处,不能轻易舍弃。不过,正如我所说,Jules 在工程架构上的改造并不彻底,所以我还是选择了 Manus 的架构。

我能作出这样的决定,自然是因为我对编程有一定的理解,更了解我的产品和业务,甚至超过 AI(哪怕是像 claude-4-sonnet 这样编程能力超强的存在)。这也反映出,编程作为一种职业可能会消失,但作为一项技艺和知识,它的价值仍然存在,甚至会被 AI 推得更高。

最后让我说说我的项目吧

我正在做的项目叫wiseflow(中文名:AI首席情报官),这是一款利用大模型,帮助用户从海量信息和各种信源中挖掘他们真正感兴趣的内容的开源应用。目前在 GitHub 上已经获得了 7.6k star 和 1.4k fork。

wiseflow 特别适合那些需要广泛收集行业情报、客户信息、招投标信息、竞争对手动态、舆情监控和知识情报的场景。相比传统的 RPA 类爬虫,它还支持免手动提取 xpath 的“开箱即用”模式,并使用大模型严格按照用户设定的关注点进行信息的分析、过滤和总结。刚刚发布的 4.0 版本还增加了对社交平台信源的支持。感兴趣的小伙伴们可以去 GitHub 搜索一下哦。

不懂如何下指令给Cursor,这点确实是个大难题啊!

文章中的代码简化思路很有启发性,大家有没有实践过类似的方法?

文章提到的简化代码仓结构真是个好主意,能否在实际操作中落地呢?

听说过async agent coding,感觉这会是下一个趋势。大家怎么看?

用Google Jules和Minimax Agent的做法让我想到了团队协作,确实可以提高效率。

Cursor的方式让我想起了传统的编程学习,确实需要我们主动去思考和提问。

简化代码仓的想法让我很有共鸣,复杂的结构总是让人头疼。

提到的代码简化,真的很实用,复杂的东西总是让人望而却步。