今天我想跟你聊聊Cursor,这个结合了AI技术的代码编辑器。它通过深度学习和语义索引,让开发者的工作变得更加高效。Cursor的界面和功能跟VS Code很像,但它有自己的AI特色,能够智能编辑代码和检查错误。

接下来,咱们从这里开始~~

你可能已经听说了OpenAI以高达30亿美元的价格收购Windsurf的新闻!与此同时,Cursor的母公司Anysphere也在以90亿美元的估值融资9亿美元!对于生成代码的应用来说,这笔投资可是相当可观。

而且,如果你知道Cursor现在的年收入已经达到3亿美元,还被认为是增长最快的SaaS产品之一,那么这样的估值就显得非常合理了。

不过,有一个问题我一直在想:Cursor和Windsurf到底有什么特别之处?它们的内部是如何运作的?难道它们不就是改头换面后的VS Code吗?

Cursor是什么?它能做些什么?

Cursor就是这样一款以AI为核心的代码编辑器,专门帮助开发者提高编码效率,能够辅助编写和修改代码。其实它是基于Visual Studio Code(VS Code)的一个“变种”,在这基础上增强了强大的AI功能。可以把Cursor看成是集成在IDE(集成开发环境)中的智能编程助手,能够实时理解你的项目并提供帮助。

那么,它是如何实现的呢?主要依赖于对整个代码库的深度索引,学习用户的编程风格。通过将完整的代码库转化为“向量嵌入”(vector embeddings),它能够更轻松地识别错误,给出改进建议,甚至自动进行重构。

我猜你可能用过Cursor,但咱们还是快速回顾一下它的主要功能吧:

AI聊天助手(具上下文感知能力)

Cursor提供了一个聊天侧边栏,你可以像聊天一样与AI讨论代码。与普通聊天机器人不同,它能够感知你当前打开的文件、光标位置以及整个项目的上下文。你可以问它“这个函数有没有bug?”之类的问题,它会基于真实代码给你反馈。

语义代码搜索

Cursor就像一个聪明的代码搜索引擎。它不仅仅依靠关键词匹配,而是使用语义搜索来理解你提问的意思,从而找到相关的代码。例如,如果你问:“日志配置在哪里?”Cursor会找出可能包含配置的代码片段或文件。

在后台,它通过为每个文件计算“嵌入向量”来对整个代码库建立索引(将代码语义转化为数字向量),从而有效回答涉及整个项目的问题。它能找到最相关的代码块,然后将这些内容提供给AI进行反馈。

智能重构与多文件编辑

Cursor具备强大的重构能力,支持逻辑上或大范围的代码重构。这些操作可以通过自然语言指令完成。它所使用的是一个专门的小型编辑模型,与回答你问题的主语言模型是不同的。

行内代码补全(Tab补全)

就像GitHub Copilot一样,Cursor在你输入时也会提供行内补全。但不同的是,Cursor的AI更“聪明”,不仅能预测下一个单词,还能根据上下文推测接下来几行代码,甚至是你可能进行的下一步逻辑操作。

其他提升效率的功能,比如Cmd/Ctrl+K

用得更方便的快捷命令

其实呢,Cursor还有一些特别实用的快捷命令。比如说,按下Cmd+K就能迅速生成或编辑代码。操作起来超级简单,你只需要选中想修改的那段代码,按下快捷键,然后用自然语言说出你想要的更改(比如“优化这个循环”),AI就会自动为你搞定。

Cursor的技术架构揭秘

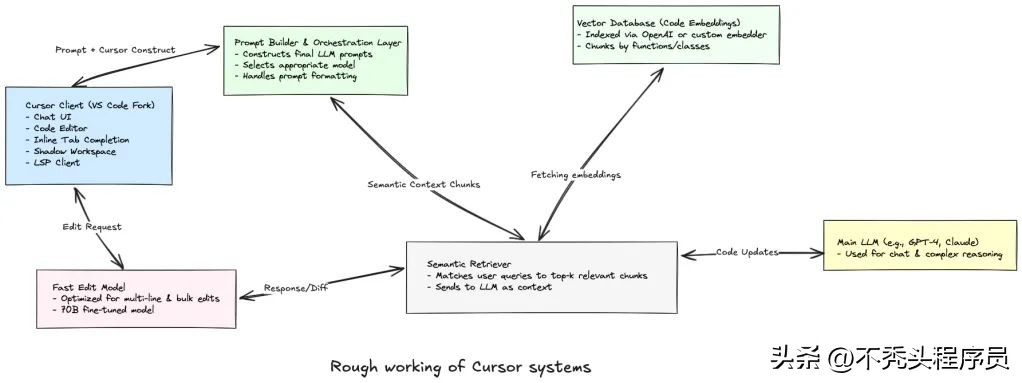

现在,咱们深入聊聊这些功能背后的技术架构。总体来说,Cursor是由一个客户端应用(基于VS Code的编辑器)和一系列后端AI服务组成的。接下来,我们就来看看这个客户端和服务器是如何合作,完成语言模型提示、代码索引和修改应用的。

Cursor与原版VS Code的区别

Cursor的桌面应用其实是基于VS Code开发的一个“分支版本”。也就是说,它继承了VS Code的核心编辑功能、用户界面和插件生态。这样,Cursor就能享受到VS Code大部分的IDE功能,比如文本编辑、语法高亮、语言服务支持和调试等,同时又能在此基础上添加自己的AI功能。

此外,Cursor的客户端还包含一些自定义的UI元素,比如聊天侧边栏、Composer面板,以及用于触发AI操作的快捷键(像Tab、Cmd+K)。因为是完整的分支,而不仅仅是一个插件,Cursor能将AI深度整合到开发流程中——例如,补全功能可以直接嵌入编辑器的建议系统,而聊天助手也能直接修改文件。

构建自定义沙盒环境

Cursor使用语言服务器(和VS Code一样,支持Python、TypeScript、Go等语言)来实时获取代码信息,提供“跳转定义”、“查找引用”和错误提示等功能。而Cursor对这些能力进行了更富创意的利用。特别是,它实现了一个叫“影子工作区”的概念:这是一个隐藏的后台空间,AI可以在这里安全地测试修改,并从语言服务器获取反馈。

比如,当AI生成了一段代码时,Cursor会在一个看不见的编辑器窗口中应用这些更改(不影响你正在工作的文件),然后让语言服务器检查有没有错误或类型问题。这些诊断结果会反馈给AI,帮助它优化建议后再呈现给你——是不是特别神奇?

简单来说,客户端为AI提供了一个带有编译器和linter的沙盒开发环境,这样能提高代码修改的准确性。(目前是通过一个不可见的Electron窗口来镜像你的项目,未来可能会使用内核级文件系统代理来进一步加快隔离速度。)

除了影子工作区,客户端还负责处理一些细节功能,比如上下文插入@符号(当你在提示中提到@File或@Code时,客户端会知道该取出相应的文件或代码片段),以及AI修改的UI操作(比如点击“播放”按钮即可立即应用建议)。当你在聊天或Composer中使用“立即应用”功能时,客户端会接收来自AI的差异或新代码,并将其应用到项目中,可能还会显示预览或进行安全合并。

大模型调用协调

虽然一些轻量级处理(比如代码拆分)是在本地完成的,但核心的AI运算则是由Cursor的云端后端来完成。当你触发一个AI功能时,客户端会整理好上下文(你的输入、选中的代码等),然后将请求发送给Cursor后端。

Cursor 的神秘后端工作原理

Cursor 的后端可是个忙碌的小家伙,它负责生成最终的大语言模型(LLM)提示。无论你有没有自己的 OpenAI API 密钥,所有的请求都会先经过 Cursor 的后端,这样才能确保添加必要的系统指令、代码上下文,甚至是特定格式,让模型正确理解你的意图。

多种模型的协作:大模型与自研模型

Cursor 采用了多种 AI 模型,涵盖了像 GPT-4 和 Claude 3.5 这样的顶级大模型,也有一些特别定制的模型,专门为特定任务设计。

比如说,当你在进行代码聊天或处理复杂任务时,Cursor 会调动高性能的大模型(比如 GPT-4);而在简单的自动补全或者常规代码编辑时,就会使用自己研发的轻量模型。特别值得一提的是,Cursor 团队还专门训练了一款叫做“Copilot++”的模型,它的灵感来自 Codex/Copilot,能更精准地预测你接下来的代码操作。

此外,还有一个特别针对快速代码修改的模型,叫做“Fast Apply 模型”。这个模型是基于 Cursor 自身的数据进行微调的,使用了 70B 参数的 Llama,配合 Fireworks 推理引擎,生成速度相当快——每秒能处理超过 1000 个 token,并且采用了先进的推测解码技术,效率杠杠的。

综上所述,Cursor 的后端有一个 LLM 协调层,它会根据不同的任务类型来选择最适合的模型,优化提示内容,并运用各种性能技巧,比如并行 token 生成,确保响应速度快。

代码嵌入与向量数据库

Cursor 的后端还配备了一个向量数据库,专门用来存储项目中的代码嵌入(embeddings),还有缓存和请求路由的逻辑。在这里,所有的通信都经过隐私和性能的优化:开启“隐私模式”后,后端不会保存你的任何代码或数据;即使不启用隐私模式,Cursor 也只会记录一些匿名统计数据来优化模型,而不会长期保存原始代码。

代码库索引和语义嵌入

代码库扫描

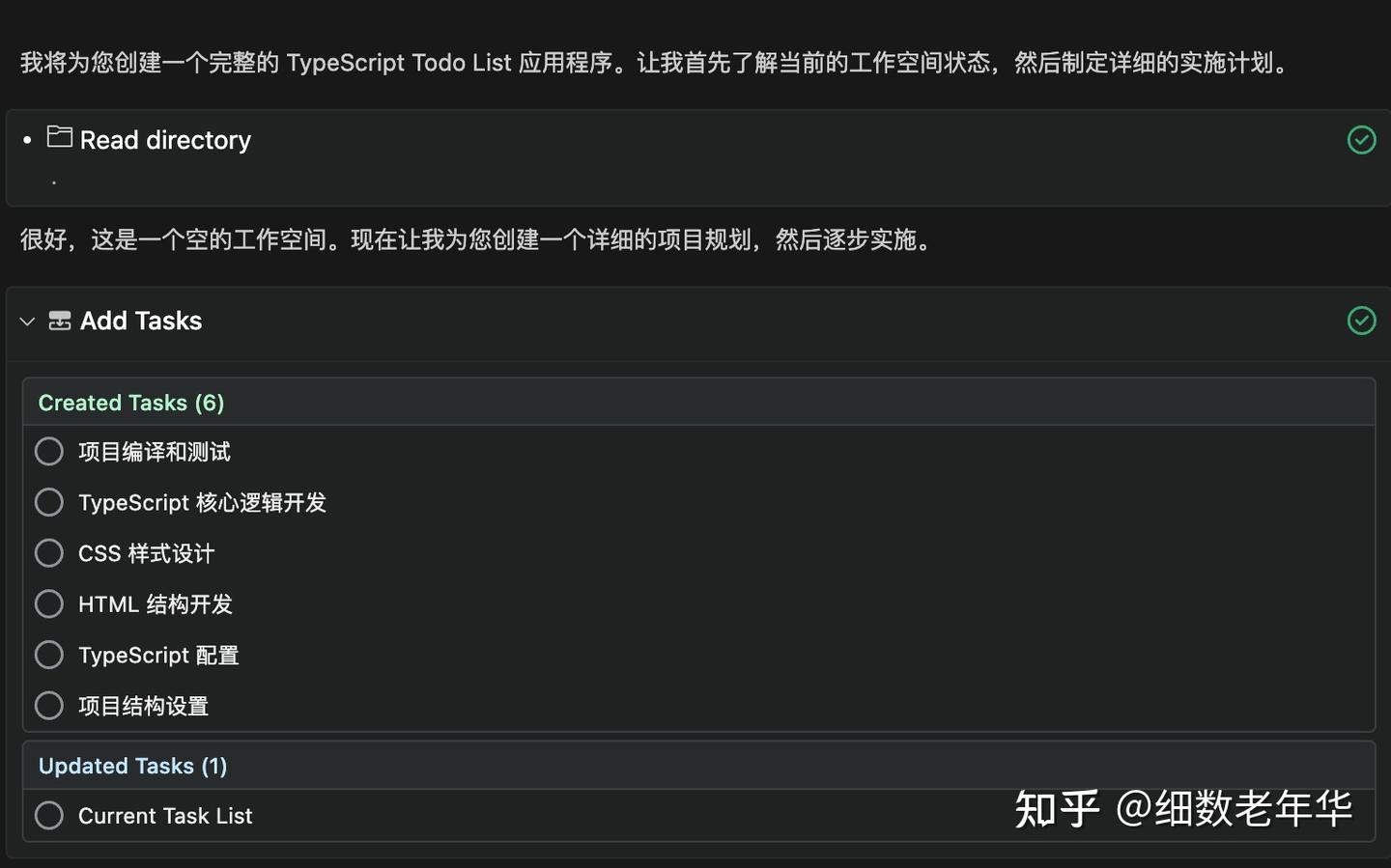

Cursor 理解整个项目的关键在于其代码索引系统。当你第一次打开一个项目时,Cursor 会在后台默默地扫描并索引整个代码库。

具体来说,Cursor 会把每个文件拆分成更小的片段,为每个片段计算向量嵌入,这些嵌入是代码语义的数字化表现。Cursor 利用 OpenAI 的嵌入模型或其自研的模型来生成这些向量,每段嵌入还会包含一些元信息(比如文件名和行号)。

通常情况下,每段嵌入会包含几百个 token。拆分的目的不仅是为了不超过模型的 token 限制,同时也能提高搜索的准确性。Cursor 采用了一种聪明的拆分策略,不是简单地每 N 行切一次,而是通过像 tree-sitter 这样的工具按照函数、类等逻辑结构进行划分,这样每个片段都能尽量独立,方便 AI 理解。

使用 RAG(检索增强生成)

一旦代码库的索引完成,就可以进行语义搜索啦。比如你问:“哪里调用了 authenticateUser 函数?”Cursor 会把这个问题转化为一个向量,并在向量数据库中寻找最接近的片段,这些片段可能来自多个文件中的函数调用、定义和注释等。相关的代码块会被提取到语言模型的上下文中。

这就是所谓的检索增强生成(RAG)方法:AI 不再局限于你当前所编辑的文件,而是可以利用整个项目中的相关信息。

这就是 Cursor 实现“全项目感知”的方式。

提示构建与上下文管理

每当你与 Cursor 的 AI 互动(无论是打聊天还是发指令),系统都会在后台构建一个完整的提示语。这些提示包括你的问题、相关的代码上下文(来自打开的文件或语义搜索)、可能的文档或示例,以及之前的对话历史。此外,还有一些系统级的提示词,帮助模型更好地响应。

Token 限制的问题

由于模型的 token 限制,Cursor 会采用多种策略来最大化有效信息,比如压缩不太重要的内容、分块处理长文本。如果你需要重构一个 1000 行的文件,Cursor 可能会把它分成几段,然后逐段处理,再把结果合并成完整的输出。

Cursor:让编码更轻松的智能助手

其实,Cursor 还会利用抽象语法树(AST)以及一些静态分析的结果来增强我们的上下文理解。举个例子吧,如果你输入了一个函数名,系统会从语言服务器那儿找出这个函数的定义和类型信息,然后一并提供给你。

之前提到的“影子工作区”也是上下文管理的一部分哦。在我们编辑代码的过程中,AI 可能会在后台悄悄地试着修改代码,然后编译或检查,获取错误信息后再调整建议。虽然这个过程你可能看不见,但它却能大大提升生成代码的质量。

编辑方式大揭秘

Cursor 更希望模型生成的是“可直接应用的代码修改”,而不是单纯的文字解释。比如说,如果你请求它实现一个函数,它可能直接给你一段完整的代码块;而在重构时,它则可能返回代码的差异(diff)或修改清单。Cursor 的界面会自动处理这些结果,并将它们应用到你的项目中。

优化性能与自定义工具

为了确保大家使用起来流畅,Cursor 可是下了不少功夫来优化呢:

1、模型微调

Cursor 对自家的大型语言模型进行了微调,专门用于代码编辑,也就是“快速应用”(Fast Apply)模型。这个模型处理代码修改和多文件编辑时,比通用模型更有保障。

2、推测解码

Cursor 还引入了一种叫推测解码的高级推理技术,利用 Fireworks 中的机制。在普通的语言模型生成过程中,模型是逐个生成标记的,这样速度可能有点慢。而推测解码则允许一个辅助的“草稿”模型提前进行猜测,并同时生成多个标记,主模型再快速验证这些结果。

3、缓存优化

Cursor 除了在后端缓存文件数据,还可能会缓存嵌入结果和搜索结果。比如说,如果你连续问了两个相似的问题,第二个问题在合适的情况下可以直接利用第一个问题的搜索结果,而无需再访问数据库。

4、资源管理

运行大型模型和多个编辑器实例会消耗不少资源哦。比如“影子工作区”功能可能会让某些资源的使用量翻倍,因为它需要同时运行一个隐藏的 VSCode 窗口和语言服务器。Cursor 通过在需要时才启动影子工作区,并在闲置一段时间后关闭它来解决这个问题。

5、MCP 扩展协议

作为一项前沿功能,Cursor 支持模型上下文协议(MCP)。这意味着外部工具或数据源可以与 Cursor 的 AI 连接。例如,当你提问时,MCP 插件可以让 AI 查询你的数据库或从内部维基获取相关文档。

总结

总的来说,Cursor 的架构完美结合了 AI 大模型与 IDE 工具。通过代码索引和 RAG 技术,它让 AI 能够更好地“理解”整个项目;利用 VS Code 的基础设施,AI 能够获取编译器和语言服务器的反馈;而通过模型协调和缓存优化,它确保了快速响应和高准确率。

正因为如此,Cursor 吸引了超过百万的开发者来使用哦!

参考资料

- Cursor 官方文档与隐私政策 – 关于代码嵌入与数据处理的详细说明

- Fireworks 博客 – Cursor 的关键功能与 LLM 性能数据

- 开发者访谈 – 介绍 Cursor 如何基于 VS Code 构建全代码感知系统

- “语义代码搜索” – 解读 Cursor 的代码拆分、嵌入与 RAG 方法

原文链接:https://adityarohilla.com/2025/05/08/how-cursor-works-internally/

Cursor的AI功能真是太强大了,能够实时理解代码上下文,真的是开发者的好帮手。希望未来能看到更多这样的工具,提升编码效率!

Cursor的语义搜索功能很实用,可以精准找到所需代码,省去了很多时间。期待它能进一步优化用户体验,助力开发者更加高效地工作。

Cursor对开发者来说无疑是个福音,特别是它的智能重构和上下文感知功能,让编程变得更加轻松。希望它在未来能不断进化,提升我们的工作效率。

Cursor的AI聊天助手功能很吸引人,能实时理解上下文,帮助解决代码问题,确实提高了开发效率。期待更多新功能的推出!