6月19日,字节跳动的研发负责人洪定坤宣布了他们和TRAE合作的第一个开源项目。根据公开的信息来看:

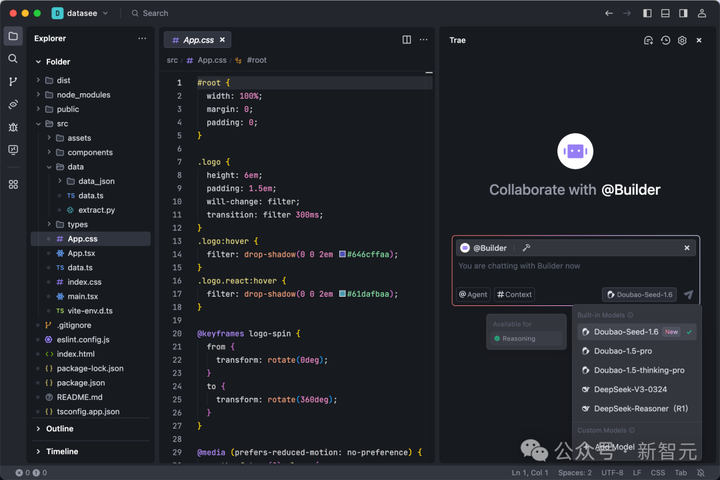

TRAE 提供的两个核心功能“代码补全”和“局部代码生成”,能够在你写代码时,自动理解上下文并补全代码,提升编程效率。

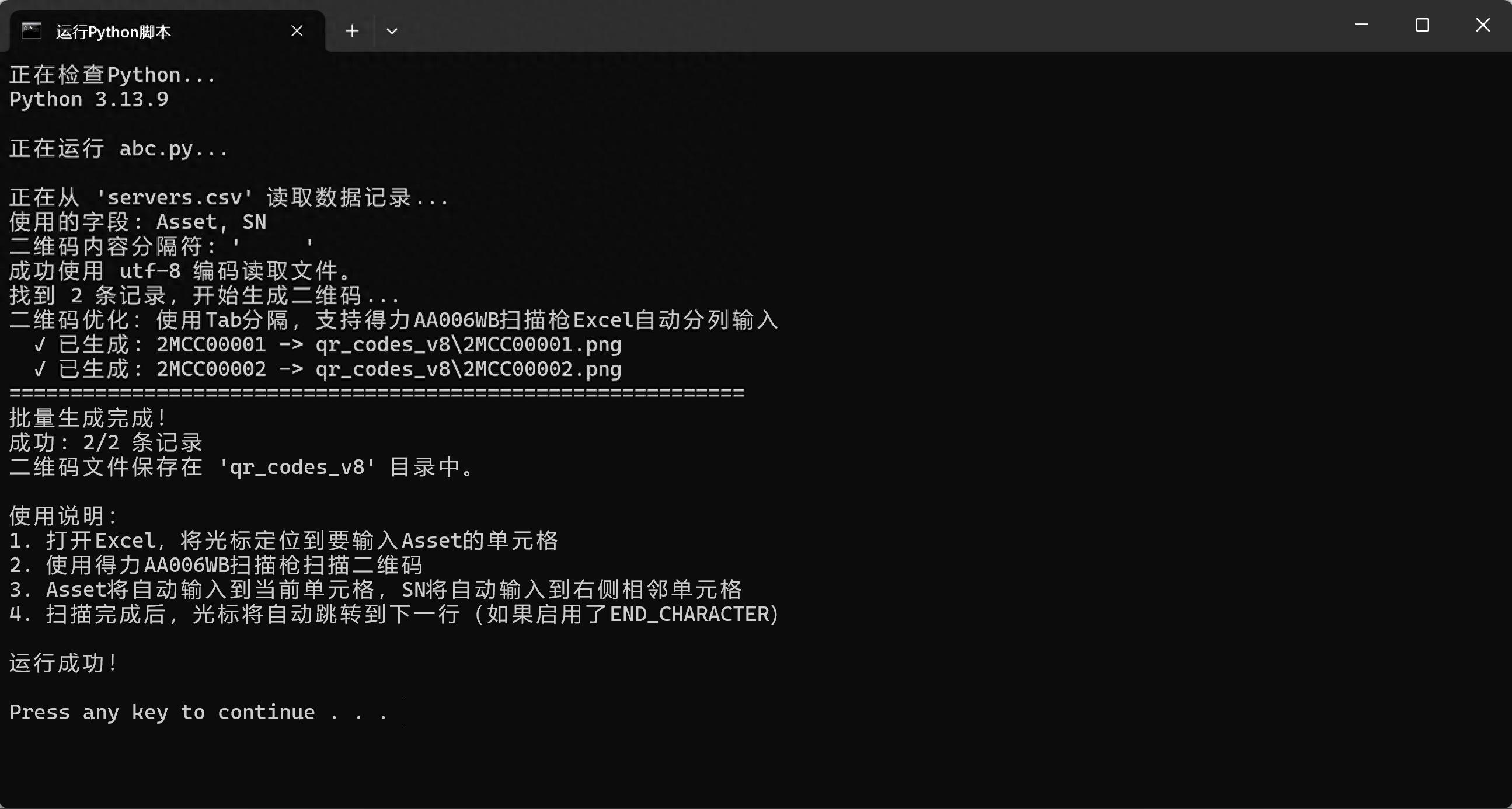

更有趣的是,TRAE 还实现了“自然语言编程”,这可不是简单的“产品经理描述功能,然后让AI来开发”。其实,“积流成江”APP的开发过程依然是典型的工程师主导,更多的是关注编码逻辑和技术方案本身。比如,一个300行代码的功能,描述方案可能只需要200字。

此外,底层模型的强大也是此次顺利开发的重要原因。TRAE这次使用的doubao-dev模型,正是基于字节跳动最新发布的豆包1.6系列模型。TRAE团队在豆包1.6的基础上,针对实际工程开发场景进行了进一步的训练。

根据字节的说法,这几天TRAE的用户们应该已经收到了最新的豆包1.6,相信这会进一步提升开发效率。

你们中有体验过的朋友能分享一下吗?现在AI的开发水平到底怎样?

开发一个AI Coding的产品,然后再用这个产品来进行AI Coding,究竟是什么样的体验呢?

未来的AI开发模式会是什么样子,开发者和AI之间又能碰撞出多大的创意火花呢?

或许字节跳动的研发负责人洪定坤能给你一些启示。

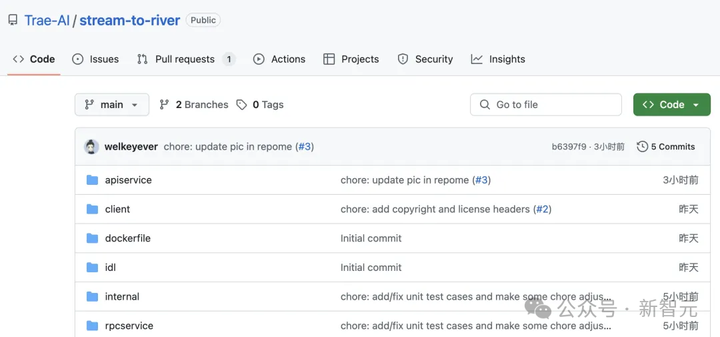

最近,他把自己利用AI Coding完成的第一个项目——一款英语学习应用「积流成江」 (Streams to River),进行了开源。

GitHub地址:https://github.com/Trae-AI/stream-to-river

更让人惊讶的是,洪定坤表示这次开发大约85%的代码都是通过自然语言与AI对话生成的,甚至在这三天里他还忙于“公务”。

而他使用的工具正是字节研发的TRAE——一款AI原生IDE,名字来源于The Real AI Engineer的缩写。

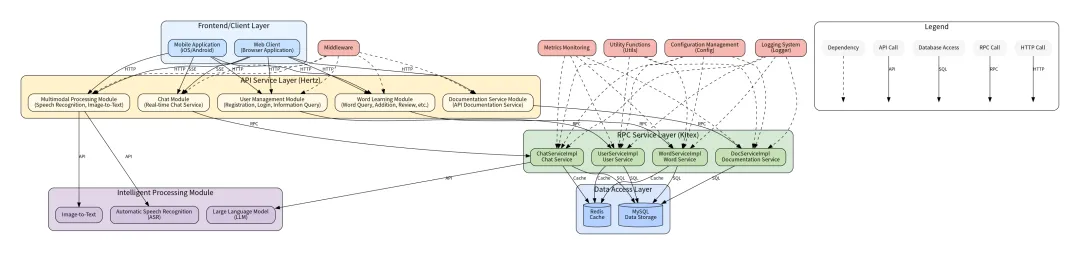

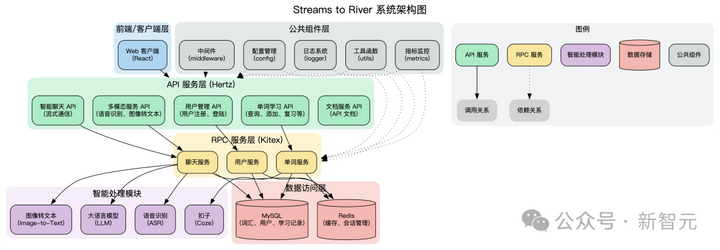

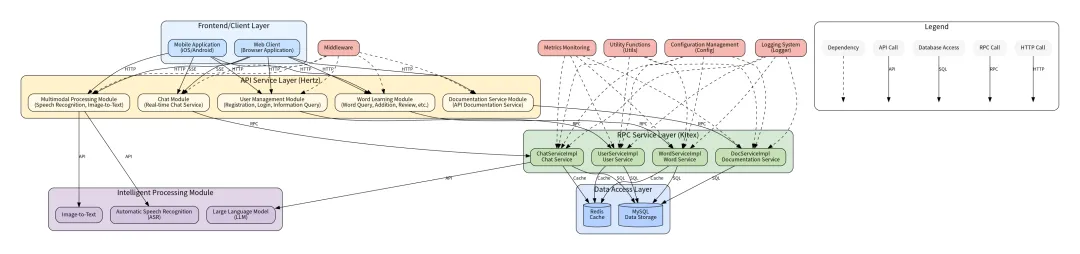

从技术角度来看,积流成江是基于Hertz和Kitex框架搭建的一个单词学习和语言处理微服务系统。

它可以提供用户认证、单词管理、复习进度跟踪、实时聊天、语音识别和图像转文本等功能模块的完整解决方案。

该系统采用前后端分离的架构,主要分为API服务层、RPC服务层、数据访问层和智能处理层。

系统架构

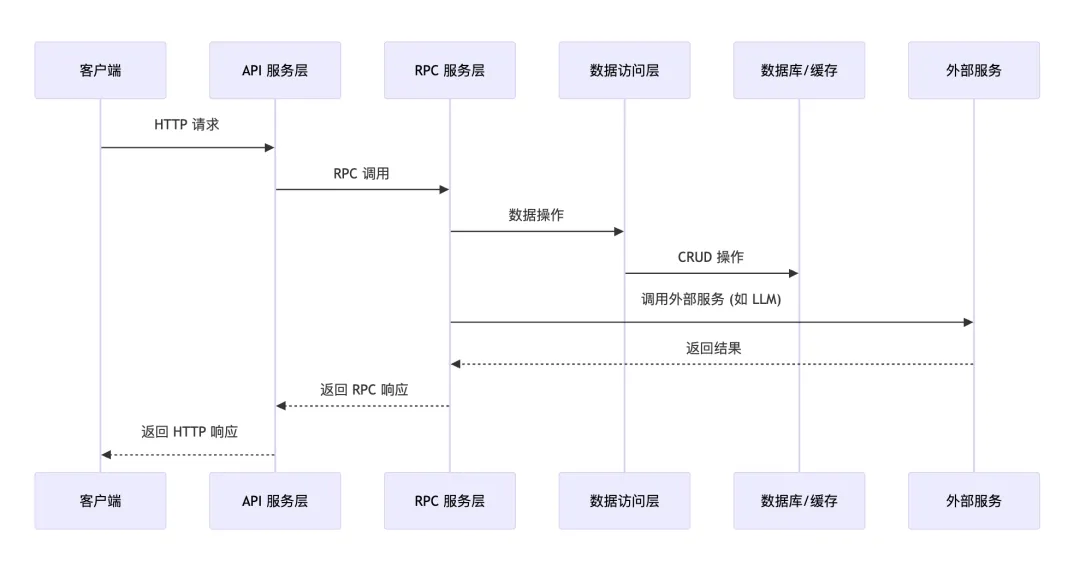

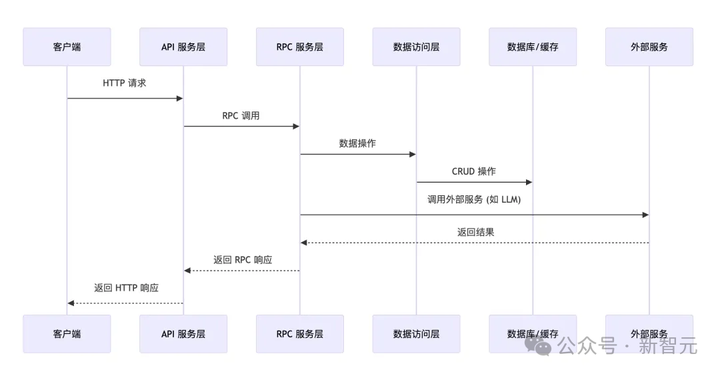

组件调用关系

那么,技术高管与AI合作写出的代码到底有多强?感兴趣的朋友可以直接去GitHub看看。

三天内“写”出一个上线产品

以前,要开发一个像积流成江这样的应用,可能得花费几周甚至一个月的时间。

然而,洪定坤通过自己的亲身实践证明,现在的AI Coding完全可以用“自然语言”快速完成一个项目。

想象一下,距离一场重要的发布会(火山引擎Force原动力大会)只有几天了。

作为技术副总裁,洪定坤需要在会上分享公司在AI编程领域的核心产品——TRAE。

他可以准备一份精美的PPT,列出各种数据和功能,告诉大家这个工具有多强大。

但他觉得,这样还是不够。

“怎么才能让大家真切感受到AI编程的魅力呢?”

“或许作为开发者和用户,把自己使用TRAE的过程分享出来,会更生动、真实,”他心里想着。

真实的体验才是最有趣的。

洪定坤提到,他在工作中有学英语的需求,但传统的背单词软件存在两个问题:

1. 学习的单词和日常工作中用到的单词往往没有关联

2. 工作中需要用的单词没有合适的场景练习

那怎么解决呢?

正好现在的大模型,比如字节的豆包,能够很好的与我们对话。

所以,是否可以将这两种功能结合起来呢?

于是,积流成江这个应用就应运而生了。

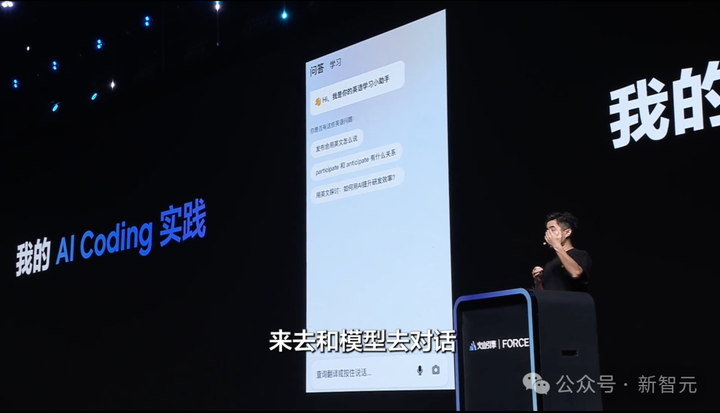

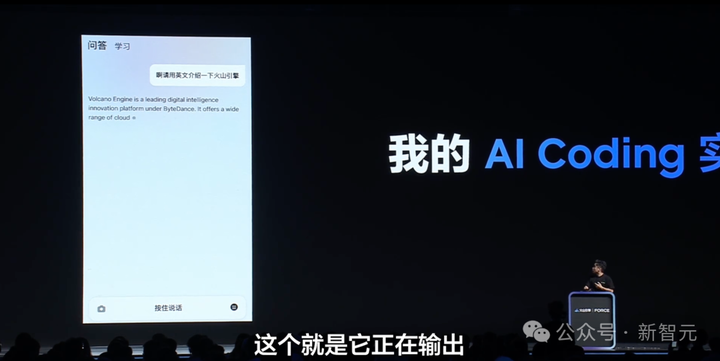

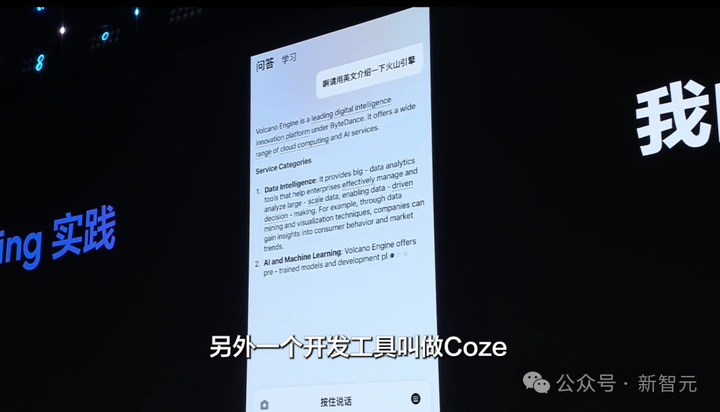

在大会上,洪定坤现场演示了如何通过“语音”让积流成江生成一段关于火山引擎的介绍文本。

而且生成的文本中,还自动将一些特定需要学习的英文单词进行了划线标注。

值得指出的是,这个功能是依靠字节的另一款产品Coze智能体实现的。

洪定坤提到,他已经有一段时间没在前线写代码了,“有点生疏”,但在TRAE的帮助下,他仅用3天就开发出了这个完成度相当高的英语学习应用。

在这个过程中,最关键的是,洪定坤大部分时间是用编程逻辑的“自然语言”来实现传统的工程开发过程。

用他的话说:

一个300行的代码功能,可能只需要200字的方案描述。

这个产品不是纯粹的Demo,已经上线了,体验地址:https://sstr.trae.com.cn

通过全流程的体验,我们都觉得很难相信这是一个只花了3天时间就完成的产品,完成度几乎达到了100%:

- 融入了聊天界面,能够主动定位和制定学习语料

- 并且能自动识别对话中的英文单词

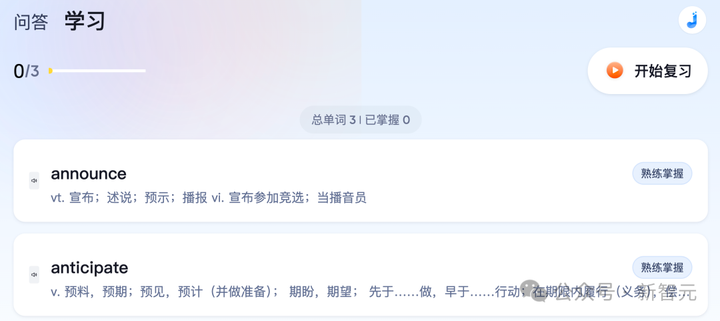

- 点击英文单词可以切换到学习模块

- 轻松将单词加入学习合集

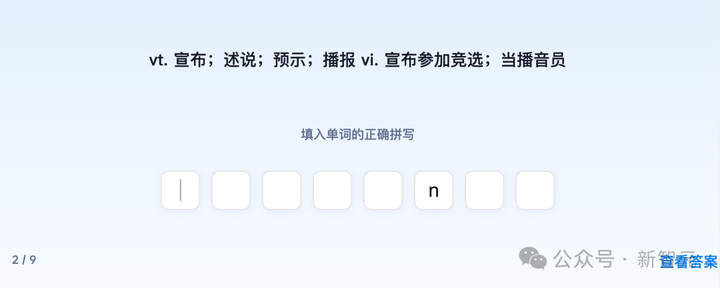

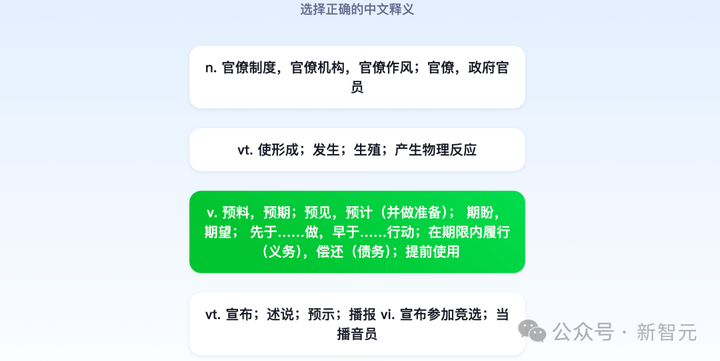

- 还有复习功能,从发音、释义、拼写等多个方面加强学习

积流成江怎么帮助你背单词?

积流成江这个产品的复杂性有多高,为什么洪定坤在Force大会上特别提到它?

其实,主要就是通过这款产品的复杂度来体现如今AI Coding已经进化到什么程度。

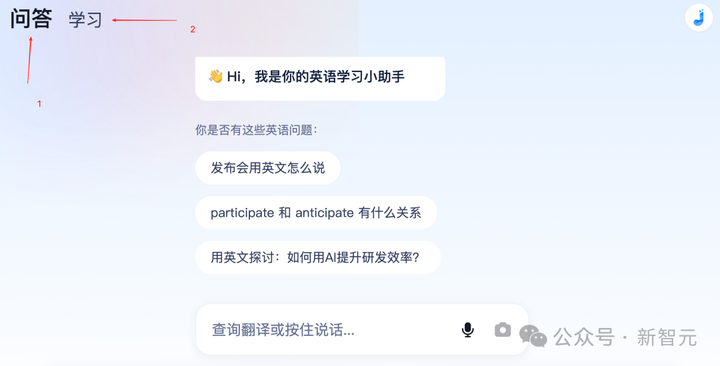

积流成江包含两个页面选项卡。

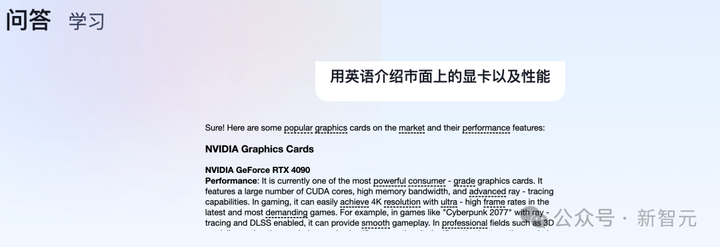

第一个选项卡集成了豆包的大模型能力,可以通过文字和语音来与大模型交流。

生成特定学习文本。

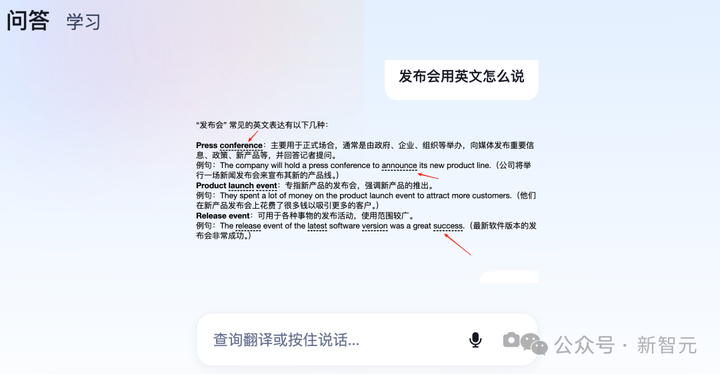

生成内容后,积流成江会将特定单词用下划线高亮,点击后即可查看单词卡。

让学习变得更简单,积流成江带来新体验

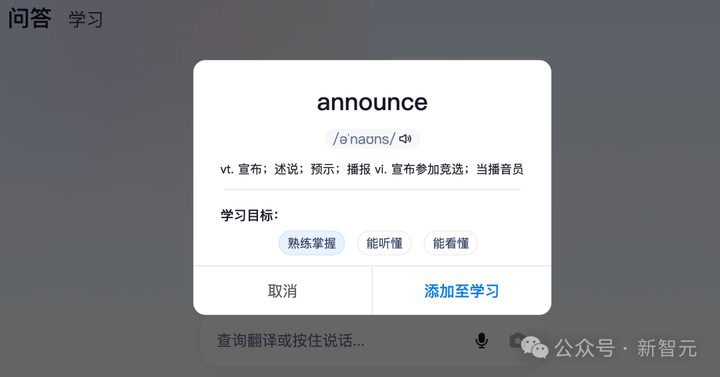

在单词卡中,你可以设定自己的学习目标,只需点击「添加」按钮,就能把它们放到学习选项卡里。

一旦准备好复习,点击开始,就能进入学习界面。在这里,有很多实用功能帮助你巩固记忆,比如填空和选择相关的中文释义。

说到积流成江,它最让人感到舒服的地方,就是它把大模型的能力融入到学习英语的过程中。这样一来,大家都能根据自己的兴趣来定制学习材料,学习的动力自然就上来了。

比如我想了解显卡的知识,那我就可以让积流成江生成关于显卡的英文内容,看到屏幕上闪烁的RTX 4090,学习的积极性瞬间提升。

当然,你也可以根据自己的工作需求来生成相关文本。

字节为何坚定走在AI Coding的前沿?

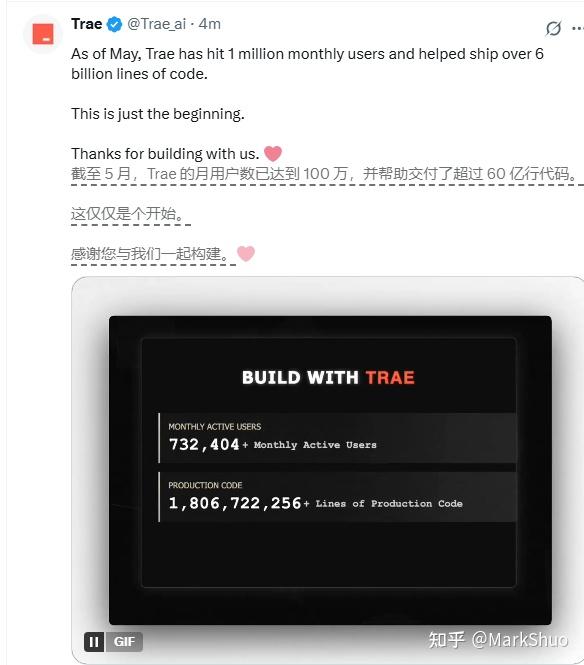

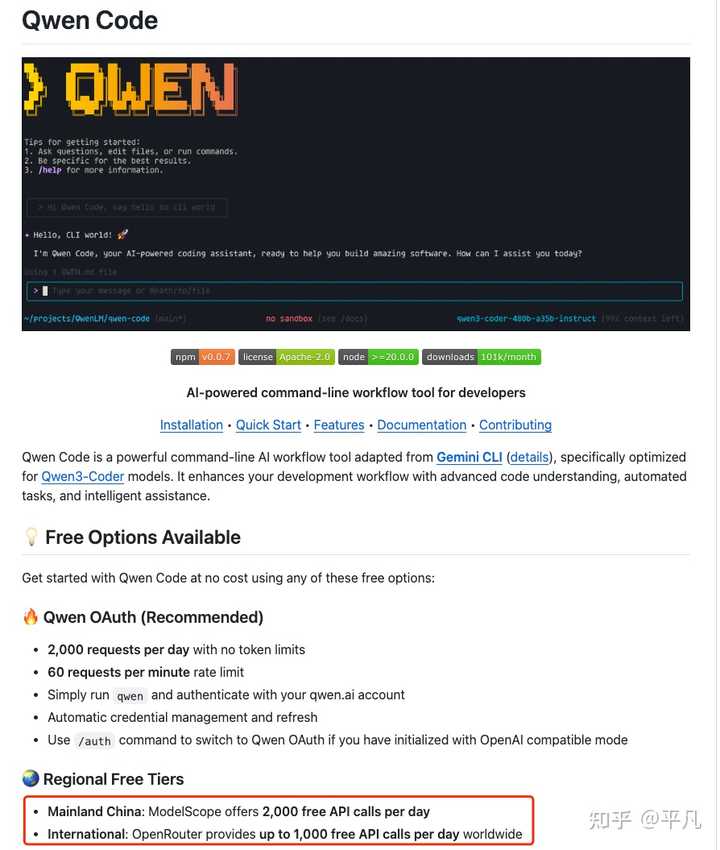

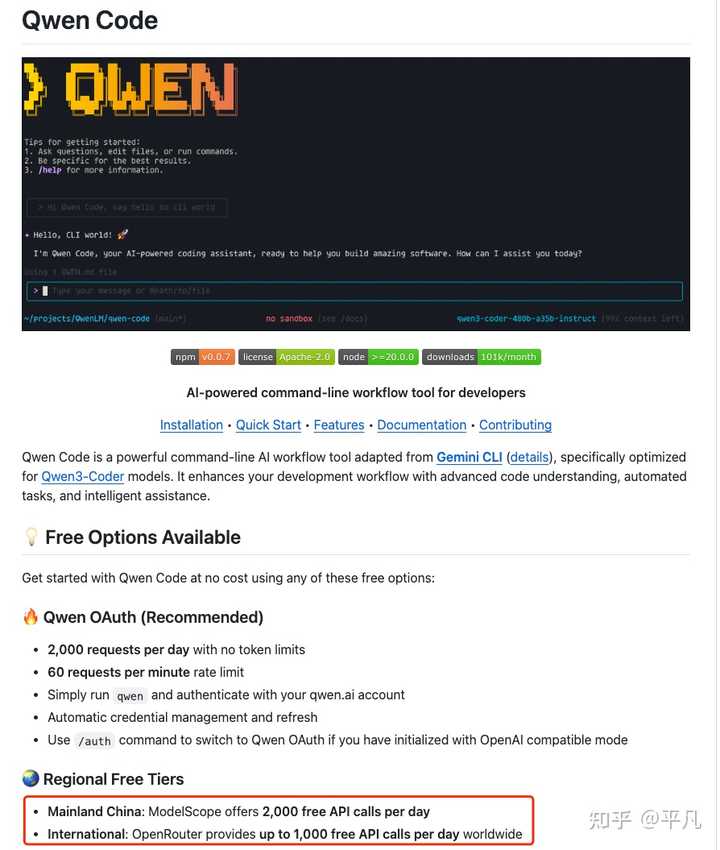

今年,AI Coding引发了国外Cursor、Copilot和Windsurf等一众产品的热潮,那国内有没有类似的产品呢?

当然有!那就是字节在今年年初推出的TRAE。

字节跳动是一家技术研发重视程度极高的公司,研发效率直接影响着企业的整体效率。

洪定坤提到,他们在AI Coding方面的研究已经有一段时间了。当GPT-3.5问世时,他们就意识到这是大模型应用的一个重要方向。

因此,TRAE的名字寓意为「真正的AI工程师」,意味着AI大模型将给编程带来真正的变革。

虽然起初大模型在完成编程任务上表现得并不出色,但不到一年的时间里,它们的进步超出所有人的想象。

像GPT-4.1、Gemini 2.5 Pro、Claude Opus和DeepSeek-R1-0528等底层模型都在编码能力上取得了显著突破。

同样,字节在火山引擎Force原动力大会上发布的豆包大模型1.6,在编程能力上也显著提升。

这一切都让AI Coding的落地成为可能,并有望引发编程领域的革命——就像洪定坤所说,利用自然语言完成一个真实且可用的工程项目。

首先,TRAE的两个基本功能「代码补全」和「局部代码生成」,能够在写代码时根据上下文自动推测并补全代码,从而大幅提升编程效率。

其次,TRAE实现的「自然语言编程」并不是简单的「产品经理描述功能,然后让AI来开发」,而是更复杂的工程师开发过程,关注的是编码逻辑和技术方案。

更重要的是,底层模型能力的提升,使得TRAE的开发效率得到了质的飞跃。

洪定坤表示,他们希望通过TRAE实现几个重要愿景:

· 技术普惠,让每个人都能成为开发者

每一次大的技术革命,都是一次巨大的筛选。在上一次互联网数字革命中,编程语言作为计算机历史上的伟大发明,凭借简洁优雅的语法和语义规则,定义了清晰的指令,让计算机完成各种任务。

而字节相信,无论技术如何发展,代码依然是未来能够使计算机完成复杂任务的重要工具。

代码是数字世界的基础生产力工具,而AI的出现则前所未有地降低了掌握代码的门槛。

· 提升研发效率

认真做好开发工具,对公司和每位开发者都有极大的益处,可以显著提升工作效率。

如今,在字节跳动内部,有超过80%的工程师在使用TRAE这样的产品进行辅助开发,甚至相当一部分代码是通过AI生成的。

· 追求智能上限

最后,字节在大模型方面的工作,追求的一个重要目标就是探索智能的上限。

Coding是一项高度结构化且逻辑严谨的任务,对模型理解复杂语义结构、逻辑推理、算法设计和精确表达都有较高要求,这也推动了模型智能上限的探索。

因此,帮助更多人掌握代码、完成更复杂的任务,以及提升专业工程师的工作效率,是洪定坤和他的团队认真投入AI Coding的原因。

洪定坤通过积流成江向我们展示了什么才是真正的AI原生开发方式。

在TRAE的支持下,或许每个人都有机会成为「真正的AI工程师」。

AI Coding的未来,可能已经悄然来临。

建议多分享一些使用TRAE的实际案例,看看不同场景下的表现。

听说TRAE能理解上下文,这样的功能真的能大幅提升工作效率吗?

TRAE的自然语言编程真是个突破,能快速生成代码,节省了不少时间。值得尝试。

这个开源项目值得关注,字节跳动在AI领域的探索太前沿了。

使用TRAE时,建议多做版本控制,避免因AI生成的代码导致的问题难以追踪。

洪定坤的实践真让人惊讶,85%的代码都是AI生成的!这效率太惊人了。

TRAE的开源项目值得一试,想知道有没有人已经开始用它开发应用了?

希望未来能看到更多关于TRAE的使用案例,了解它在实际项目中的应用效果。

建议使用TRAE时注意代码的可维护性,生成的代码可能会让后续修改变得复杂。

字节跳动的AI开发工具在实际项目中表现如何?有没有人分享过使用体验?

这个开源项目好像很有潜力,感觉字节在AI方面的投入很值得关注。

洪定坤用AI完成85%的代码,真是让人震惊,有多少人试过这个工具呢?