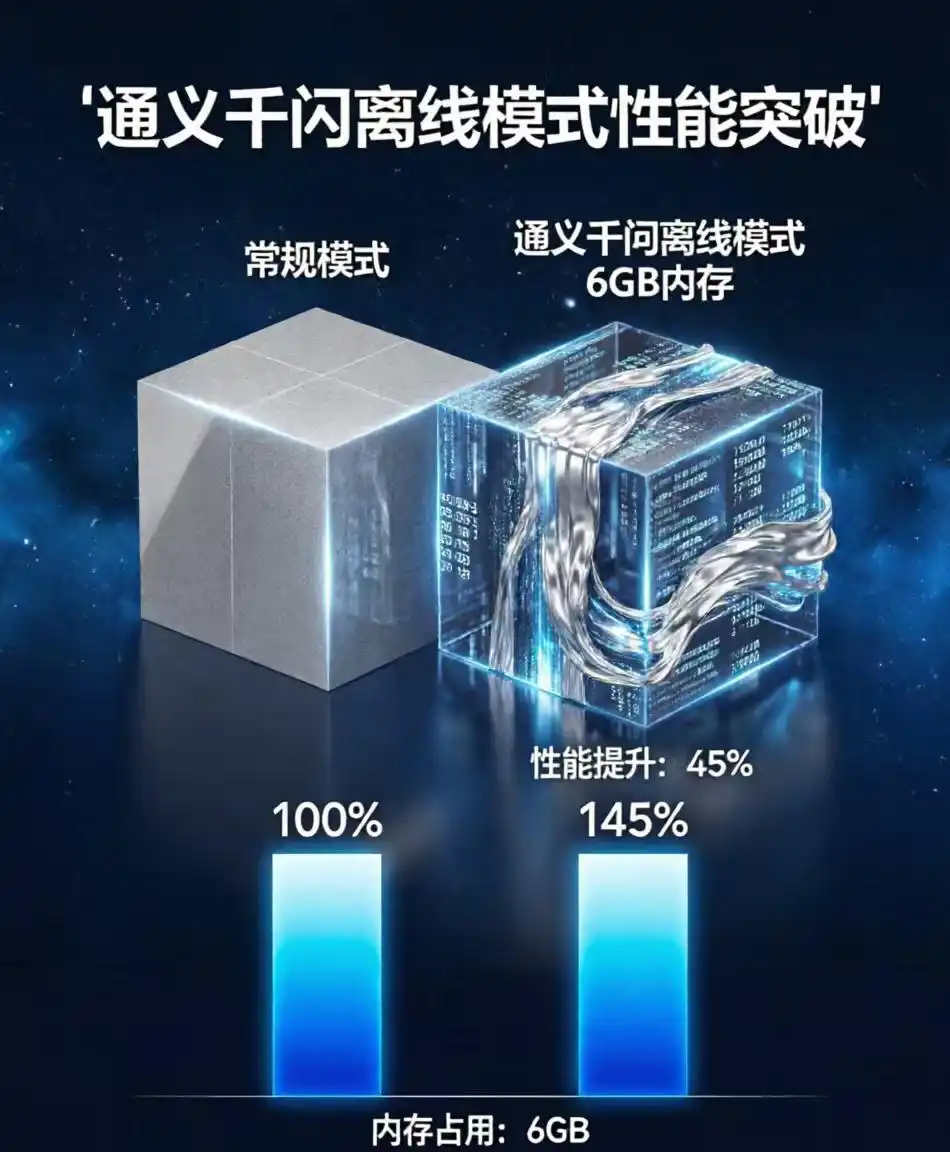

前几天我在一个信号不好会议室里,看到同事想查个专业术语,却只能看着“无法连接网络”的提示,真是让人哭笑不得。我们总是说AI能给我们带来便利,但一旦网络断了,很多人连个能用的智能助手都没有。就在4月17日,通义千问V3.0离线大模型上线,速度提升了45%,内存要求从12GB降到了6GB。听起来像是技术参数,但其实这揭示了一个大家都忽略的关键问题:AI究竟是为谁服务的呢?

一、6GB的门槛意味着什么?

让我们来细说这次技术升级。

以前,离线AI需要12GB内存,现在6GB也能顺畅使用。可能你对这个数字没什么感觉,举个例子:iPhone 15 Pro的内存是8GB,普通办公电脑通常也是8GB或16GB。也就是说,过去想用离线AI,得花大价钱买个“发烧级设备”,而现在普通人的手机和电脑就能搞定。这次技术进步的关键在于Qwen3的混合专家架构,它总参数量为235B,但实际只需激活22B,通俗点说,就是一个超级大脑里有128个专家,每次只叫醒8个来工作。其他的专家就像在休息,既省电又省算力。这就像公司不能让所有部门同时为一个客户出方案,专业的部门上,其他的就去做其它事。

但更值得注意的不是技术本身,而是阿里这一步棋背后隐藏的意图。

任何技术要进入普通人的生活,首要问题不是价格,而是“我能不能用”。过去,离线AI就像一个伪命题,号称多么好,结果打开一看,16GB起步,大多数人直接关掉了页面。这就像告诉一个工薪族“法拉利新款不错,不过太贵了”,人家根本不会动心,因为他知道自己根本不在目标用户当中。阿里这次把门槛直接降到6GB,相当于让离线AI从“极客专属玩具”变成了“大众标配”。

这背后其实传递了一个行业信号:大模型厂商正在从“比拼参数量”转向“比拼实际应用能力”。以前大家都在比谁的模型参数多、榜单分数高,但这些对普通人来说并没有意义。普通人只关心自己的老电脑能不能用,使用时会不会卡顿。阿里这次放弃继续堆参数,专注内存优化,说明他们意识到真正的竞争优势不再是云端的算力,而是在终端设备的普及率。当你的模型可以在6GB设备上运行,而对手还停留在12GB上,这本身就是一道难以逾越的竞争壁垒。

二、离线AI的隐私安全优势

很多人觉得离线AI不过是联网AI的“简化版”——没网时凑合用,有网了谁还用离线呢?这种看法其实暴露了大多数人对AI隐私风险的忽视。

本地运行的AI和联网的完全不同。所有运算都在设备本地完成,输入数据不离开本地内存,不会有数据上传、网络传输、云端存储这些环节。换句话说,你在离线AI上问的问题、上传的文件,实际上只存在于你的电脑硬盘和内存中。没有人能调取、分析,更不会被用作他人模型训练的材料。这可和你在公共WiFi上用云端AI传合同的安全感完全不同。

老实说,过去两年AI的爆发让用户隐私的风险被严重低估。大多数人根本没意识到,每次在云端AI上上传文件,都等于把这份文件的电子版交给了某个公司。对方说不拿你的数据训练,你真相信吗?就算相信,万一他们的服务器被黑了怎么办?在普通人看来,这可能是“小概率事件”,但对于处理敏感文件的人来说,这就是绝对的禁忌。医生不敢用云端AI处理病历,律师不敢上传诉讼材料,企业HR更不敢把员工信息放进在线AI里。问题不在于AI不好用,而是根本不敢用。

阿里这次将离线AI的全功能永久免费,实际上是在获取这个“隐私焦虑红利”。以前你在隐私问题上纠结,只能不使用AI或者冒险上传,而现在离线版功能齐全,还完全免费。这不仅是技术上的创新,更是产品策略上的一次降维打击——当你的竞争对手仍靠会员费盈利时,你用免费加隐私安全的组合直接吸引市场,等他们反应过来,用户习惯已经建立了。

三、离线AI的实际表现如何?

我试着在没有网络的环境下使用本地版通义千问,做了三件事:写产品文案、制定项目提纲、回答一些专业问题。

整个过程没有出现“加载中转圈”的尴尬,响应速度和联网版几乎没有差别。换句话说,以前大家觉得“离线AI只是应急之选”的观念,该更新了。唯一的差别在于复杂推理场景——比如让AI分析一份几十页的合同并提取风险点,离线版稍微慢一些,但依然在可接受的范围内。

值得一提的是,Qwen3采用的是“混合推理”模式,集成了“快思考”和“慢思考”的机制。简单的问题秒回,复杂问题需要多步骤深度推理,系统自己判断该快还是慢。这不是花哨的功能,而是在离线状态下计算资源有限时的必然选择——总不能让一个简单问答也浪费大量算力。

如果说以前的离线AI给人的印象是“断网救急”,那现在这个版本已经展现出“主力工具”的潜力。出差在高铁上写报告、在地铁里整理会议纪要,或者在保密环境中处理敏感数据——在这些场景下,离线AI不仅不是降级选择,反而是唯一可行的方案。阿里通义实验室还推出了CoPaw 1.0这样的本地化工具,Mac、Windows、Linux都能一键安装,数据完全留在设备里,简直就像给电脑配了个私人助理团队。

四、免费策略背后的战略思考

全功能永久免费向个人用户开放,表面上看是“让利”,但深究一下,阿里并不亏。

为什么呢?因为当6GB内存的设备都能流畅运行离线AI时,这本身就是一种强大的生态扩展策略。过去大模型公司拼命做付费会员,一年收几百块,但用户数也有限。而阿里的逻辑是:先让所有人都能高质量地使用,然后再在此基础上开发更多可能性——比如企业定制版、行业解决方案、开发者生态。阿里Qwen系列的全球累计下载量已经超过3亿次,衍生模型超过10万个,超越美国的Llama,成为全球首个开源模型。这些数字背后,都是用户用脚投票的结果。

从行业格局来看,这次升级释放了一个明确的信号:AI行业正在经历从“云端依赖”到“端侧普惠”的转变。英特尔在Qwen3发布的当天就完成了NPU优化适配,首次在NPU上Day 0支持大模型;联发科与阿里云完成了芯片级适配,在天玑9300上实现了通义千问的端侧部署,离线状态下可进行即时多轮人机对话。这些动作表明,整个产业链都在为端侧AI铺平道路,而阿里正好踩在了这个时间节点上。

更让人关注的是,英伟达的CEO黄仁勋公开表示,中国的DeepSeek和Qwen是开源AI模型中最好的。这话从美国半导体巨头的嘴里说出,分量可想而知。阿里通义千问的API价格降幅达97%,全球开发者基于DeepSeek、Qwen等模型衍生出超过10万种垂直应用,覆盖医疗、教育等多个领域。这种规模效应一旦形成,后来者几乎无法复制。

五、手机里的AI离线功能究竟算不算刚需?

回到最开始的问题:你手机里的AI离线功能,是刚需还是鸡肋呢?

答案其实因人而异。对于每天在信号良好的地方活动、不处理敏感文件、愿意付费订阅的人来说,云端AI确实足够用,离线功能可有可无。但对于频繁出差的商务人士、在保密环境下工作的公职人员,以及对数据安全意识较高的普通用户来说,离线AI并不是“备胎”,而是唯一的选择。医生在病房里想快速调取病历摘要时,手边只有医院内网;律师在客户公司的会议室讨论案子时,不方便联网上传;学生在图书馆自习时,网络不稳定——在这些场景下,离线AI的可用性直接决定了你能否真正使用AI。

阿里这次把离线功能提升到“全功能永久免费”的水平,实际上是在用产品策略回应一个更深层次的问题:AI应该是每个人都能使用的工具,而不是少数人的特权。当技术门槛降低到普通人设备也能运行,而隐私保护不再是会员专属的噱头时,这个行业的竞争逻辑才真正发生了改变。

你说这是免费,我觉得这是另一种形式的“降维打击”。

6G内存就能流畅运行,感觉比我电脑还强,真是科技进步啊。

听说阿里这次真的下了血本,普通用户也能享受AI福利,真不错!

看了这个介绍,感觉AI确实变得更亲民了,值得尝试!

体验过的朋友可以分享一下具体的使用感受吗?

觉得阿里的这个举动挺有意思的,普通人也能参与高端科技了。

这款AI的速度提升让人惊讶,感觉我都可以用它来处理工作了,真是科技的奇迹!

阿里的新AI方案让人感到惊喜,尤其是隐私安全方面。会不会有其他公司跟进?

能否分享一下对比其他AI的具体体验?效果如何?

这个AI的速度提升真让人惊讶,感觉工作更高效了。

阿里这波操作简直太贴心,想知道后续会不会更新更多功能呢?

会不会有其他公司推出类似的AI?市场竞争会不会更激烈?