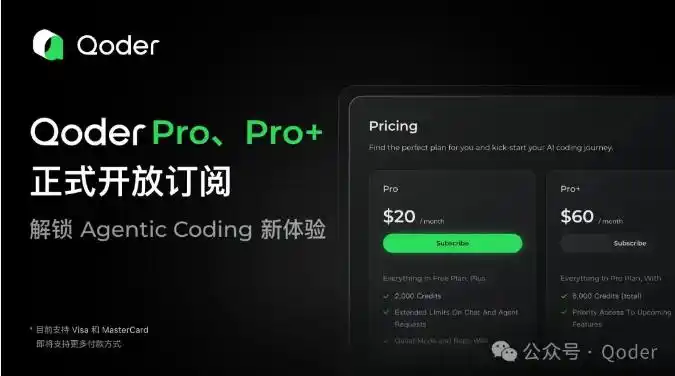

在当前AI应用开发的热潮中,传统的后端架构正悄然发生着重要变化。当开发者们还在忙着设置服务器、配置数据库和调试接口时,有一种更灵活、更高效的开发方式正在兴起——不再需要搭建传统后端,只需借助AI工具和云服务的紧密合作,就能迅速创建出功能完备的移动应用。今天,我们带你体验一场“Vibe Coding”(灵感即代码)的极速开发之旅:利用Qoder自动生成Flutter前端,结合阿里云ADB Supabase的BaaS服务,并通过Supabase Edge Function连接通义千问图像编辑模型,完成一个AI手办生图的移动应用,整个过程几小时内就能从零实现。

一、开发背景:AI原生应用与“轻量化”的需求

在移动应用开发的世界,特别是针对C端用户的创意工具类应用(像AI绘画、手办生成等),开发者通常面临两个主要难题:第一,传统后端开发周期太长——从界面设计、后端逻辑编写到数据库搭建和接口调试,往往需要花费数周甚至数月;第二,运维成本高——自建服务器需要处理负载均衡、安全性和扩展性等问题,而这些对于快速迭代的原型阶段来说,反而成了负担。

而AI原生应用的特点进一步加剧了这种矛盾:用户的主要需求往往是“通过自然交互迅速获取AI生成的结果”(比如通过输入文字描述生成定制手办图片),对后端功能的需求逐渐简化为“数据存储”和“调用AI能力”。这为“轻量化后端”甚至“无传统后端”开发模式提供了机会——借助AI工具链(如代码生成)、云原生BaaS服务和边缘计算的结合,开发者可以省去繁琐的后端搭建流程,将精力集中在提升用户体验和打磨AI功能上。

二、总体架构:三大组件协作的“无后端”方案

这次开发的AI手办生图应用,其整体架构遵循“前端互动+云服务支持+AI能力注入”的简洁逻辑,核心由三大组件组成:

1. 前端:Qoder自动生成的Flutter界面

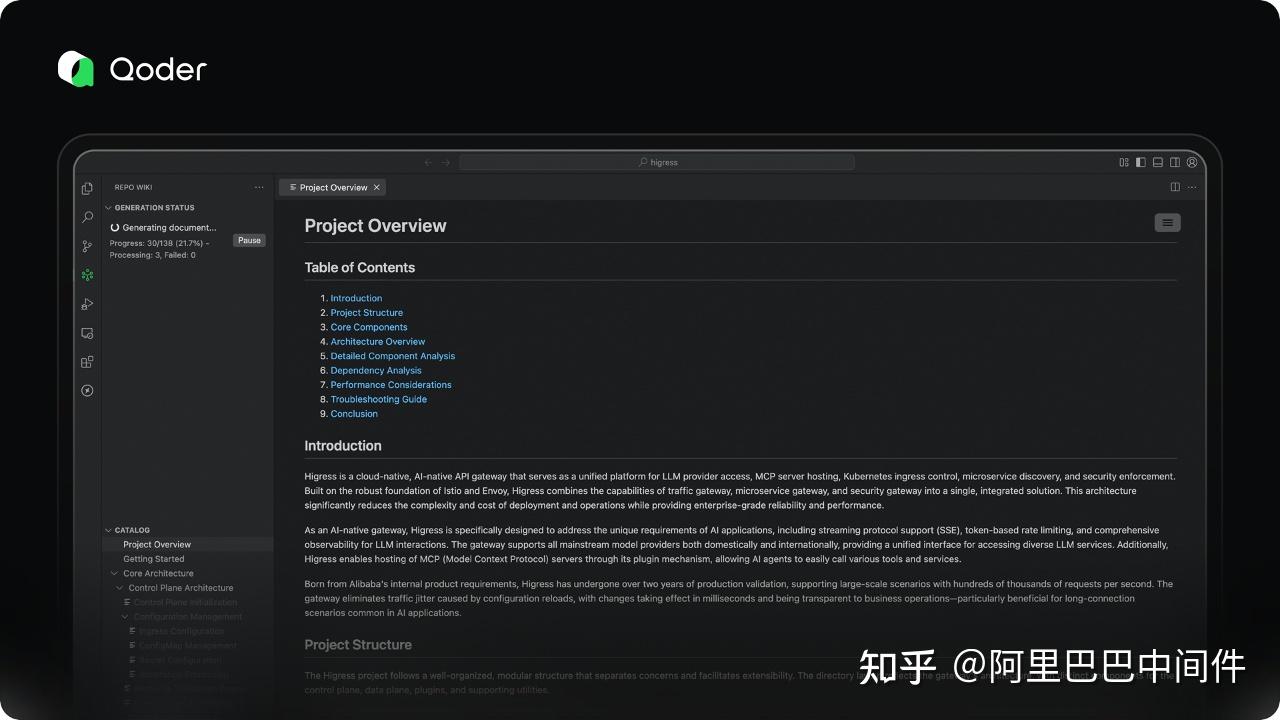

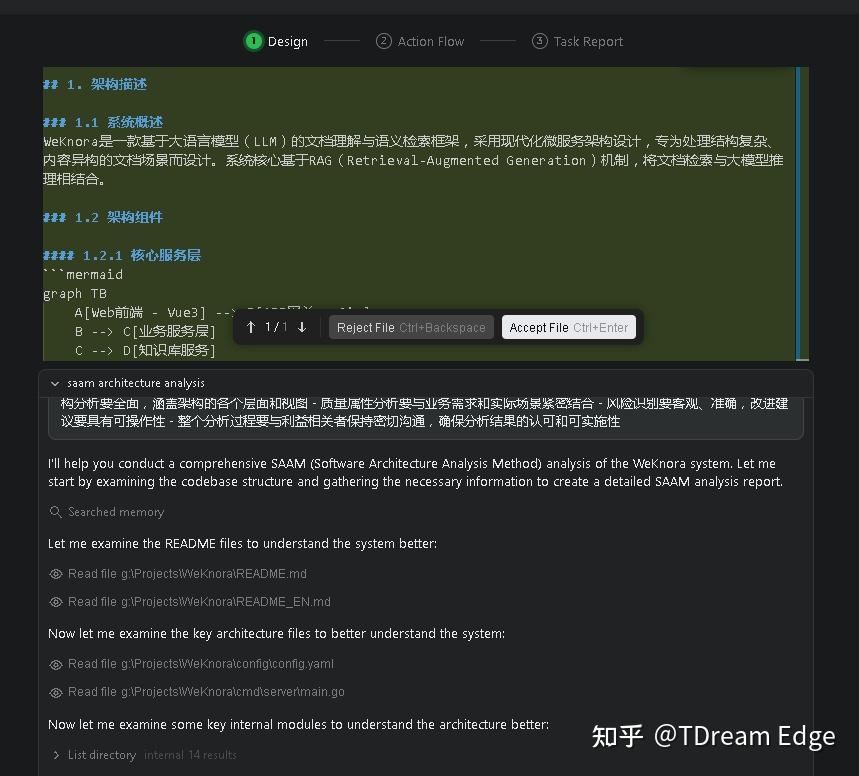

Flutter作为一个跨平台的移动开发框架(支持iOS和Android),一直是构建用户界面的首选工具。但在传统开发中,开发者仍需手动编写Dart代码来实现页面布局、交互逻辑和状态管理。Qoder的出现彻底改变了这个过程——它是一款基于自然语言描述的AI代码生成工具,只需输入“我想要一个AI手办生图App,首页有文本输入框和生成按钮,点击后展示生成的图片并能保存到相册”,Qoder便能自动分析需求,生成完整的Flutter前端代码(包括UI组件、路由跳转、图片预览逻辑等),甚至能够自动适配不同屏幕尺寸的响应式布局。

在这个项目中,Qoder生成的代码不仅包含用户输入手办描述(如“Q版孙悟空,红色披风,手持金箍棒”)的文本框和生成按钮,还实现了图片加载动画、生成结果展示网格以及保存至本地相册的功能等细节。开发者无需担心“如何在Flutter中管理状态”或“如何绑定按钮点击事件”,只需对生成的代码稍作调整(比如修改配色或调整文案),就能获得一个交互流畅的移动原型。

2. 数据与存储:ADB Supabase的BaaS能力

在传统开发中,用户生成的手办图片、输入的描述文本以及个性化参数(如风格偏好)等数据都需要存储在自建的数据库中(如MySQL或PostgreSQL),并配套开发增删改查接口。而ADB Supabase(阿里云提供的开源BaaS平台)将这些功能整合为开箱即用的云服务——它自带PostgreSQL数据库、文件存储系统和用户认证模块,开发者无需写一行SQL或部署服务器,只需通过控制台就可以完成数据表创建、存储桶配置和权限管理。

在这个项目中,ADB Supabase扮演了两个关键角色:

对象存储:用户生成的AI手办图片(通过通义千问模型输出的二进制文件)会自动上传至Supabase的文件存储桶,并生成独特的访问URL。这些图片不仅可以在前端直接展示,还可以通过链接分享或下载。

结构化数据管理:用户输入的手办描述文本、生成时间和图片相关参数(如风格标签)等信息,会存储在Supabase的PostgreSQL数据库中(通过自动生成的表结构)。如果开发者后续想增加“历史记录”功能(查看用户生成过的所有手办),只需调用简单的查询接口就能获取数据,无需额外开发。

3. AI能力:通过Supabase Edge Function接入通义千问图像编辑模型

AI手办生成的核心在于“将用户描述的文字转化为定制图片”,这需要调用专业的图像编辑模型(如通义千问图像编辑模型Qwen Image Edit)。在传统方案中,开发者需自行部署模型服务(购买GPU服务器、配置推理环境、优化响应速度),这不仅成本高而且技术门槛复杂。而通过Supabase Edge Function(边缘计算函数),我们可以将通义千问模型的调用能力“嵌入”到云服务中,实现“前端→Edge Function→AI模型”的无缝连接。

具体实现的逻辑是这样的:当用户点击“生成手办”按钮时,Flutter前端会将输入的文本描述(如“Q版皮卡丘,黄色身体,大眼睛”)通过HTTP请求发送至Supabase的Edge Function;Edge Function接到请求后,调用通义千问图像编辑模型的API(提前配置好API Key和调用参数),将文本描述转化为图像生成指令;模型返回生成的图片二进制流后,Edge Function将其存储至ADB Supabase的文件存储桶,并将图片URL和相关参数写入数据库;最后,前端通过轮询或WebSocket获取生成结果,展示给用户。

这样的架构优势在于:AI能力调用被封装为云服务的一部分,开发者无需关心模型的部署细节,只需关注“如何传递用户输入”和“如何展示生成结果”。同时,Edge Function的边缘节点特性(靠近用户地理位置)能够有效降低网络延迟,提升生成响应速度。

三、开发实战:从需求到真机的“Vibe Coding”体验

本次开发贯穿了“Vibe Coding”理念——通过自然语言描述需求,利用AI工具链迅速实现功能,边写边验证。以下是关键步骤的实战回顾:

步骤1:用Qoder生成Flutter前端(30分钟内)

打开Qoder平台,输入需求描述:“开发一个AI手办生图移动应用,包含以下功能:首页有文本输入框(占位符:‘请输入手办描述,如角色+外观’)和‘生成手办’按钮;点击按钮后显示加载动画,图片生成成功后展示在下方网格中,支持点击单张图片保存到手机相册;底部导航栏包含‘首页’和‘我的’(‘我的’页暂留空)。”

Qoder在几分钟内生成了完整的Flutter代码(包括入口main.dart、首页Widget、图片展示组件、按钮交互逻辑等),开发者只需调整文本框的样式(如字体大小)和按钮颜色(匹配品牌色),然后在模拟器中运行验证交互流程(输入文字→点击按钮→显示加载→展示图片),整个前端开发就完成了。

步骤2:配置ADB Supabase(1小时内)

登录阿里云ADB Supabase控制台,完成以下步骤:

创建项目并启用PostgreSQL数据库和文件存储服务(Bucket);

在数据库中自动生成一张表(如handmade_figures),包含字段:id(主键)、user_description(用户输入的描述文本)、image_url(生成的图片链接)、created_at(生成时间,默认当前时间戳);

配置存储桶的访问权限(公开读取或通过Token鉴权,根据安全需求选择);

通过Supabase提供的SDK(Flutter插件),在前端代码中集成数据库与存储桶的调用方法(如上传图片、查询历史记录)。

整个过程无需编写SQL语句或部署服务器,控制台的可视化操作大幅降低了配置门槛。

步骤3:接入通义千问图像编辑模型(通过Edge Function,2小时内)

在Supabase控制台中创建Edge Function(选择Node.js运行时),编写核心逻辑:

接收前端传递的用户描述文本(通过HTTP POST请求的Body);

调用通义千问图像编辑模型的API(提前申请API Key),将文本描述转化为图像生成参数(如提示词优化、分辨率设置);

发送请求至通义千问服务,获取返回的图片二进制流;

将图片存储至ADB Supabase的文件存储桶,获取访问URL;

将用户描述、图片URL和生成时间等信息写入PostgreSQL数据库;

最后返回图片URL给前端,以触发图片展示。

Edge Function部署后,Supabase会自动为其分配边缘节点,确保全球用户的请求都能快速响应。开发者无需担心GPU服务器的运维,也不用处理模型调用的并发限制。

步骤4:联调与优化(1小时内)

启动Flutter应用,测试整个“生成手办”的流程:输入描述→点击按钮→观察加载动画→检查图片是否成功展示并支持保存。常见问题包括:

图片生成延迟(优化方案:在Edge Function中添加请求超时处理,前端显示“预计生成时间”);

数据库写入失败(检查Supabase的表权限与字段类型是否匹配);

图片链接无效(确认存储桶的访问权限配置正确)。

通过逐步调试,最终实现一个功能完整、交互流畅的AI手办生图应用——从需求构思到真机预览,总耗时仅需4到5小时。

标题:轻松构建你的AI手办应用!快来试试吧!

“`html

在这个AI原生应用开发的时代,咱们的传统后端架构正在经历一场变革。今天,我想带你走进一个全新的世界,看看如何通过 Qoder、阿里云 ADB Supabase 以及通义千问图像编辑模型(Qwen Image Edit)来迅速搭建一款完整的AI手办生图的Flutter移动端应用。真心告诉你,整个过程根本不需要自己搭建传统后端,你将亲身体验到Vibe Coding带来的快速开发乐趣。

二、总体思路

前端部分,Qoder会根据你的需求自动生成Flutter代码,负责处理界面和交互的部分。

而数据和对象存储则由ADB Supabase来搞定,提供了BaaS的强大支持。

至于AI功能,我们通过ADB Supabase Edge Function接入通义千问的图像编辑模型,实现了图片的编辑功能。

整个架构设计得很轻巧,迭代速度也快,非常适合从原型到上线的快速推进。

三、环境与准备

首先,你需要开通一个阿里云 ADB Supabase的实例(限时免费,1C2G),这样才能调用百炼的API。配置时,记得要把ADB Supabase实例的VPC设置为通过终端节点私网访问阿里云百炼平台(这个是免费的),或者选择配置公网NAT网关(这个是要收费的)。

接下来,别忘了申请百炼的DashScope API Key,这样才能调用通义千问的图像编辑模型。

然后,你需要安装Qoder和Flutter插件,并设置Flutter环境(Android/iOS SDK)。如果不清楚怎么操作,可以参考VS Code安装Flutter的指导。

四、AI驱动开发 – Qoder自动生成Flutter代码

Qoder作为一个AI驱动的IDE代理,能根据需求自动生成高质量的Flutter代码。你只需创建一个空项目,然后描述核心功能,经过几轮调试,便能得到一个可运行的移动端应用。

欢迎参考本文的源代码,并在此基础上进行二次创作!

const DASHSCOPE_API_KEY = Deno.env.get(‘BAILIAN_API_KEY’);

const BASE_URL = ‘https://vpc-cn-beijing.dashscope.aliyuncs.com/api/v1’;

async function callImageEditAPI(image_url, prompt) {

const messages = [

{

role: “user”,

content: [

{

image: image_url

},

{

text: prompt

}

]

}

];

const payload = {

model: “qwen-image-edit”,

input: {

messages

},

parameters: {

negative_prompt: “”,

watermark: false

}

};

try {

const response = await fetch(`${BASE_URL}/services/aigc/multimodal-generation`, {

method: ‘POST’,

headers: {

‘Authorization’: `Bearer ${DASHSCOPE_API_KEY}`,

‘Content-Type’: ‘application/json’

},

body: JSON.stringify(payload)

});

if (!response.ok) {

console.error(`请求失败: ${response.status} ${response.statusText}`);

return null;

}

const data = await response.json();

return data.output?.choices?.[0]?.message?.content ?? null;

} catch (error) {

console.error(“请求错误:”, error.message);

return null;

}

}

Deno.serve(async (req) => {

try {

const { image_url, prompt } = await req.json();

if (!image_url || !prompt) {

return new Response(JSON.stringify({

error: “缺少image_url或prompt”

}), {

status: 400,

headers: {

‘Content-Type’: ‘application/json’

}

});

}

const result = await callImageEditAPI(image_url, prompt);

return new Response(JSON.stringify({

message: result

}), {

headers: {

‘Content-Type’: ‘application/json’,

‘Connection’: ‘keep-alive’

}

});

} catch (error) {

console.error(“服务器错误:”, error);

return new Response(JSON.stringify({

error: “内部服务器错误”

}), {

status: 500,

headers: {

‘Content-Type’: ‘application/json’

}

});

}

});

五、后端即服务 – ADB Supabase配置

5.1 获取API配置

“`

轻松上手ADB Supabase配置与AI服务集成

首先,咱们得去打开ADB Supabase的控制面板,记得把API_URL和API_KEY给复制下来。接着,通过dotenv的方式把这两个信息(特别是Service Role Key)放到你项目的根目录里,这样就能顺利配置好。

接下来,咱们要设计数据库表结构。你可以在ADB Supabase的控制面板中创建一个表格,专门用来保存历史数据。这张表的作用是记录用户编辑图片的过程,包括原始图片的URL、编辑后的URL,还有用户输入的提示词等重要信息。

然后,咱们再来创建一个对象存储桶。在ADB Supabase的Storage页面,新建一个叫做images的存储桶,这个存储桶用来存放用户上传的图片数据,是个不错的图片文件持久化存储方案。

接下来进入AI服务集成的部分,咱们要部署Edge Function。

首先,打开ADB Supabase的控制面板,找到Edge Functions页面,点击“Via Editor Deploy a new function”,在编辑器中输入你要的函数代码,记得把函数命名为wan,然后就可以部署啦。

小提示:如果你选择通过私网来访问阿里云百炼平台(这是免费的哦),那么BASE_URL就得设置成https://vpc-cn-beijing.dashscope.aliyuncs.com/api/v1;如果是通过公网NAT网关(收费的),那BASE_URL就得改为https://dashscope.aliyuncs.com/api/v1。

这个函数的功能是接收图片的URL和提示词,调用通义千问的图像编辑模型,然后返回生成的结果。

再来讲一下安全密钥管理配置。在ADB Supabase里,我们提供了原生的Edge Function Secrets配置和集中管理的功能,可以把AI API Token(像DashScope/百炼这样的)安全地存放在函数的运行环境中。通过Deno.env.get来读取这些密钥,绝对不会把它们下发到客户端,也不会放进代码仓库或构建产物里。

在Edge Functions的Secrets页面中,配置BAILIAN_API_KEY。在你的函数中使用Deno.env.get(‘BAILIAN_API_KEY’)来读取这个密钥,千万别把它硬编码或者暴露给客户端。

这篇文章让我对AI应用开发有了新的认识,感觉前途无量。

AI生成的手办生图效果到底怎样?会不会有失真或者不真实的情况?

这套工具链的开发效率好高,感觉以后开发都不需要后端了,真是个好趋势!

我试过用类似的AI工具生成图像,效果还是有些局限,希望这个项目能突破这些限制。

用自然语言描述需求生成代码,感觉自己像个魔法师,真是牛逼!

感觉把复杂的技术变得简单,这样的开发方式让我想起了小时候的乐高玩具,搭建起来就是那么轻松!

这个项目的介绍让我想试试,开发应用的难度会降低很多吗?

快速开发听上去很美好,实际开发中会不会遇到对接问题?云服务的稳定性一定要关注。