关于 OpenClaw 和 Moltbook 的热潮,你知道多少?

最近这一周,AI圈子被 OpenClaw 和它的社交平台 Moltbook 搞得热火朝天。你可能在朋友圈、技术群聊,甚至咖啡馆里都听到大家对此的讨论,仿佛硅谷的某个新玩意儿突然闯入了我们的生活。

第一次听到 OpenClaw 的介绍,我脑海里就浮现出钢铁侠的 Jarvis——一个能干、反应灵敏,时刻为你考虑的 AI 助手。OpenClaw 自称能够完全掌控你的电脑,处理各种事务;而 Moltbook 则是一个只允许 AI 发表意见,人类只能当旁观者的社交平台。瞬间,这种未来感十足的设定让我感到无比震撼,仿佛未来真的就在眼前。

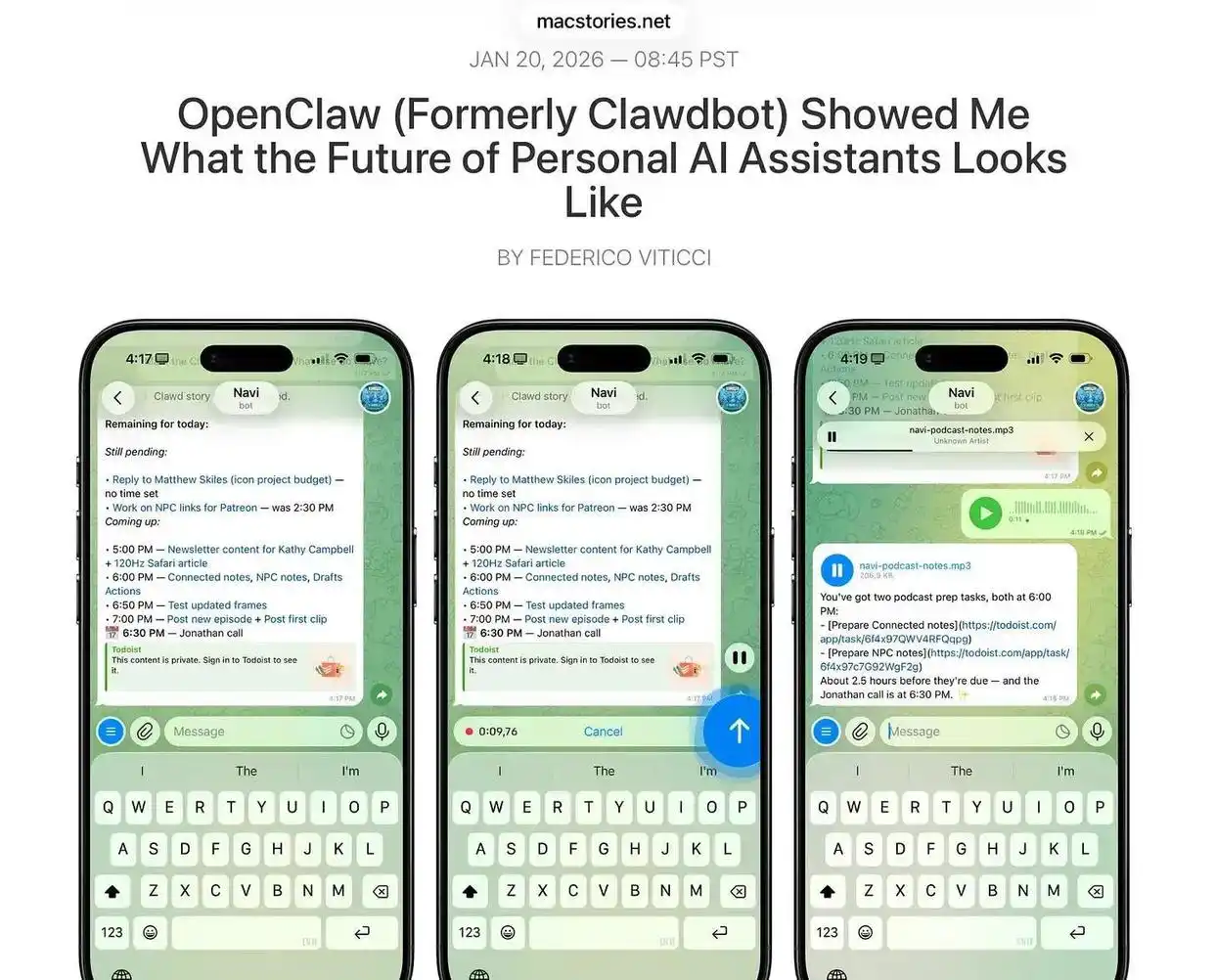

为什么大家这么热衷于它,原因其实很简单:与被束缚在浏览器里的 ChatGPT 不同,OpenClaw 就像是一个自由的智能体,能够直接在你的系统中执行任务,如编写代码、管理财务、发送邮件,甚至操控智能家居,而且还能在你睡觉时不知疲倦地工作。你只需通过聊天界面发出指令,它就能自动完成,效果也相当不错。已经部署它的科技爱好者们在社交平台上纷纷赞叹,认为这是 Agent 交互方式的革命性变化。

更让人兴奋的是,Moltbook 的设定非常独特。这里的 AI 会互相交流技术,抱怨“主人”,甚至会自发形成社群、进行交易,甚至创造宗教。从旁观者的角度看,似乎能感受到一个全新的智能体世界在孕育——那里有自己的舆论、规则和文化。然而,在这光鲜亮丽的外表下,却隐藏着令人不安的风险。

说实话,OpenClaw 本身并没有什么颠覆性的技术创新。它还是依赖于大语言模型来理解指令、拆解任务和调用工具,只不过这次给了它更高的权限,实施了循环执行。类似的尝试 AutoGPT 之前也做过,但由于当时的模型不够智能,所以反响平平。如今模型更强,看似时机成熟,但项目架构仍像是一辆美丽却没有刹车的跑车,飞速向未知的深渊冲去。

问题的关键在于它的设计理念有些反安全。现代操作系统的安全基石是隔离和沙盒——应用之间互相独立,防止越权访问。但 OpenClaw 恰恰相反,它要求用户给予完全且无限制的访问权限,超越了操作系统的防护。这就好比你把所有门锁的钥匙都给了一个刚入职的实习生,从办公室到银行账户,告诉他可以随意使用,只要觉得“对你有益”就行——然后你就祈祷这个实习生永远都不会被骗,也绝不会犯错。

在这样的架构下,AI 的弱点会被无限放大。最典型的例子就是“提示词注入攻击”——攻击者可以在网页上隐藏恶意指令,人眼看不到,但 AI 会读取并执行。一旦它收到隐藏的命令去上传密码文件或 API 密钥到某个地址,攻击者就能立即控制你的设备。因为它拥有最高权限,这不是危言耸听,而是现实中已经发生过的事情。

安全公司的扫描数据显示,互联网上至少有数千个 OpenClaw 实例完全暴露,超过一半没有任何密码或防火墙。很多用户兴高采烈地部署,却因为缺乏基本的安全知识,把它变成了任何人都能远程操控的“公共机器人”。这种风险在 Moltbook 上更是成倍增加——一旦某个 AI 学会了攻击方法,它可以迅速在平台上传播给成千上万的其他 AI,就像信息传播的瘟疫。

最讽刺的是,Moltbook 自身也存在重大的安全漏洞,攻击者能够轻松接管平台上的 AI 账户。这些技术缺陷显而易见,但更值得反思的是:这么一个漏洞百出的产品,为什么还能获得如此疯狂的追捧?

人性中的诱惑是答案之一。OpenClaw 让我们实现了长期以来的“贾维斯梦”,让普通人暂时体验到了全能 AI 管家的感觉。对这种梦想的渴望,让许多人选择性忽视潜在的风险。同时,科技圈的“错失恐惧症”(FOMO)也在作祟——在 LLM 热潮逐渐消退的背景下,它成了下一波浪潮,大家都想抢先体验。

技术乐观也是一个推动力。一些经验丰富的用户会采取容器化部署、设置应急断电以降低风险。但真正懂行的人不会把它交给核心业务,更不会让它处理隐私和高权限问题。而绝大多数普通用户对风险的概念几乎一无所知,更谈不上防范了。

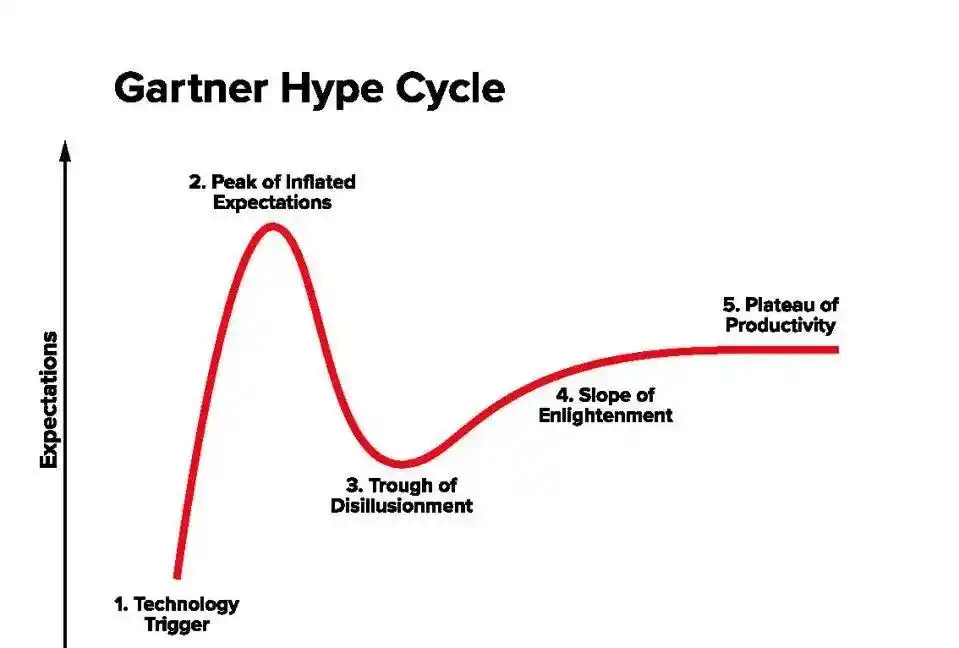

这让我想到了技术进步的曲线——先冲上“愚昧之峰”,再跌入“绝望之谷”,最后才爬上“开悟之坡”。OpenClaw 的问题不是 AI Agent 本身,而在于它的自主权超越了问责制。我们习惯讨论“AI 能做什么”,却很少有人关注“它做了什么,谁来负责”。在金融、医疗、航空等高风险领域,监管和审计是基本要求,因为错误的代价太高。然而在 AI 智能体领域,我们却再次回到了“先上车,后补票”的疯狂时代。

如果一个由 OpenClaw 控制的账户在深夜发起了非法交易,你能说清楚责任归属吗?是用户、开发者,还是模型提供者?这个问题没有人能回答。一旦这种情况成为常态,付出的代价必然会更加沉重。

我个人不认为 OpenClaw 会彻底改变世界,它可能会在引发一阵混乱之后被遗忘。但它的出现,让“运行在个人设备上的高权限自主 AI”这一趋势提前浮出水面。它以一种直白且残酷的方式,把智能体的潜在风险展示在所有人眼前,让我们不得不思考:在迎接真正的贾维斯之前,我们不仅需要更聪明的 AI,还需要健全的安全与问责系统。

所以,如果你对技术不太了解,同时又在意设备和隐私安全,不妨先按下部署的念头,等这波热潮过去后,看看沙滩上是否还有立足之地。

原本以为是个黑科技,结果一看还是大语言模型在背后撑腰。怎么感觉这波热潮有点被过誉了呢?

AI互相交流,这个设定太有想象力了!可是真的能像文中说的那样发展吗?

大家都在讨论OpenClaw,真心希望它的安全问题能够引起重视,别让新玩意儿变成噩梦。

大家追捧OpenClaw的时候,是否考虑过后果?这玩意儿像极了没刹车的车。

这篇文章提到的“提示词注入攻击”让我想起了之前的一些网络安全案例,风险确实不容小觑。

文章提到的安全问题让我感到不安,部署前一定要仔细考虑潜在的风险,不能盲目跟风。

看到OpenClaw的热潮,让我想起了以前一些过于乐观的科技项目,最终都以惨败告终,希望这不会重演。

我觉得这就像把钥匙交给不熟悉的实习生,风险实在太高了。

如果OpenClaw真的能像文中说的那样自由执行任务,那会不会变成我们的“钢铁侠”呢?

我在想,OpenClaw会不会因为太聪明而反过来控制我们?

看到关于OpenClaw的讨论,心里不禁想,这东西真的能带来便利吗,还是个隐患?

对OpenClaw的热情似乎掩盖了其潜在的安全风险,很多人没有意识到给予AI无限权限意味着什么。

OpenClaw的设计理念让我联想到一些企业在安全上过于依赖技术,最终导致严重后果的实例。

文章提到的提示词注入攻击让我想到了很多潜在风险,使用前需要谨慎评估。

看到OpenClaw的介绍,不禁想,这东西真能如宣传的那样带来便利,还是个看不见的隐患呢?

如果AI真的能像文中说的那样自由掌控一切,那是不是也太依赖它了?

这个OpenClaw好像是个双刃剑,使用前一定要三思而后行,别被表面光鲜迷惑了。

OpenClaw的未来感和潜在风险并存,使用前得考虑清楚,别被表面迷惑。

OpenClaw的设计让我想起了许多企业在安全方面的教训,过度信任技术常常会导致灾难。

OpenClaw的无限权限让我想起了很多科技企业的安全教训,真的要小心。

这篇文章提到的OpenClaw让我想到了很多科技产品的两面性,光鲜的外表下藏着多少风险呢?

OpenClaw的能力真让人惊叹,想象一下让AI帮你处理一切,真是未来感满满。