机器之心编辑部

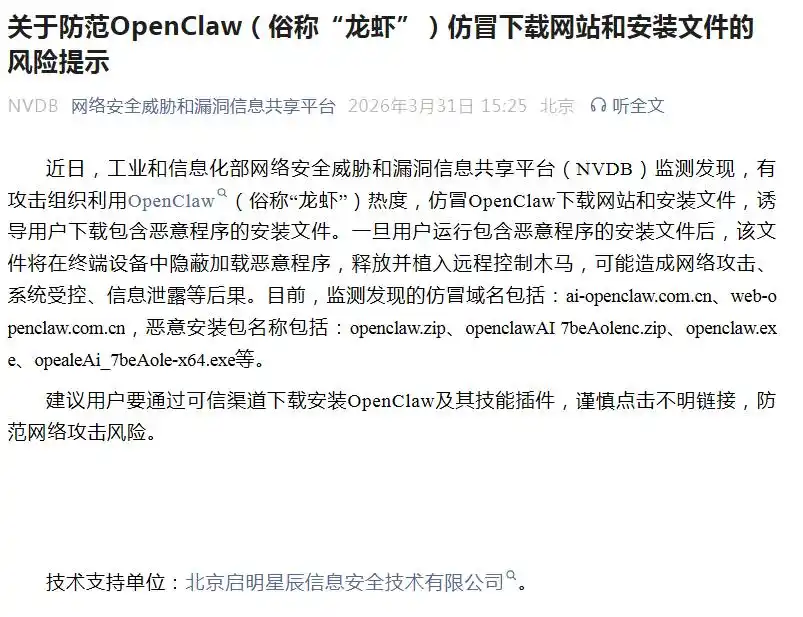

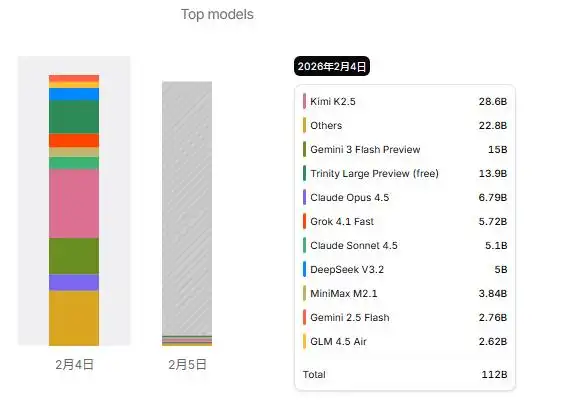

2026年已经过去两个月,Agent 依旧是全球最受瞩目的人工智能领域之一。OpenClaw(原名Clawbot)掀起的Agent热潮至今仍在持续,甚至让“一人公司”这一概念首次真正在现实中得以实现。

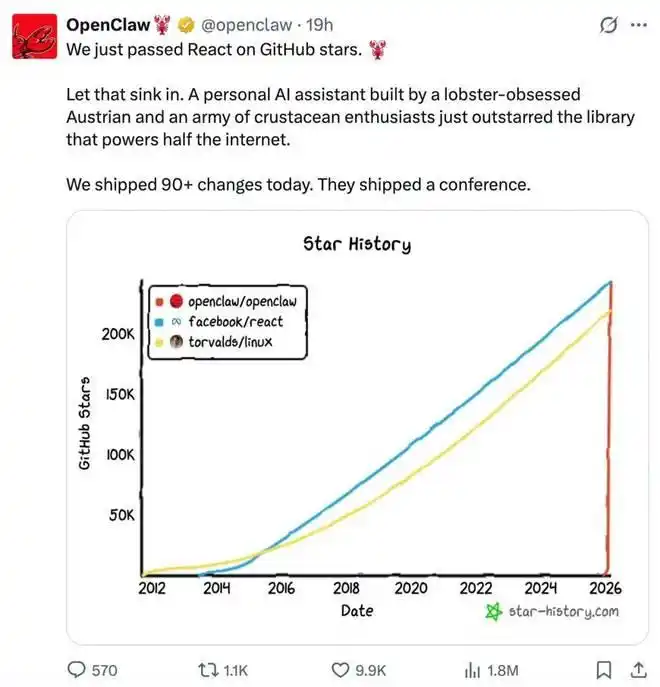

最近,OpenClaw在GitHub上的Star数量超过了React和Linux,成为了非资源/教程类开源软件项目中最受欢迎的。

从浏览器代理到编码代理,再到个人和企业级工作流代理,最明显的变化就是:Agent们能做到的事情越来越多了。

与此同时,像LangChain、Claude Code和OpenClaw这样的运行时框架不断扩展智能体的能力,使它们能够处理更加复杂的任务。尽管这些框架为Agent开辟了广阔的应用前景,但如何在实际环境中保持它们的持续提升和自我进化,依然缺乏完善的支撑体系。

特别是被寄予厚望的强化学习(RL)训练,作为支撑Agent在复杂、多轮和长程任务中进化的关键,面临着诸多挑战,这在一定程度上限制了当前Agent的能力提升。

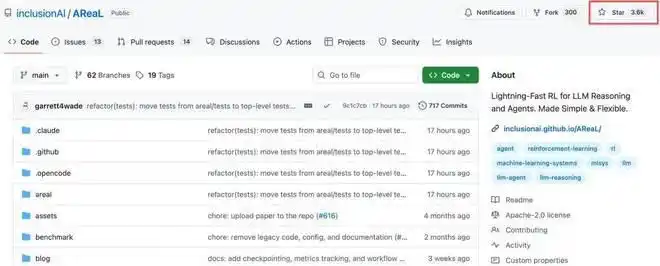

AReaL v1.0的发布传递出一个积极的信号:一个即插即用的Agent RL训练平台已经搭建完成。

这是由蚂蚁和清华大学联合开发的开源强化学习框架 AReaL,经过近一年的不断迭代,终于迎来了一个里程碑式的稳定版本。这套面向Agent的开源全异步强化学习训练框架,最引人注目的进展是实现了“Agent一键接入RL训练”的目标,重新定义了智能体的强化学习模式。

在Agentic RL算法系统的协同创新下,AReaL v1.0能够与任何Agent框架兼容,只需修改一个接口地址就能轻松接入RL训练,包括备受欢迎的OpenClaw,这大大降低了强化学习的训练门槛。而且,AReaL v1.0还引入了一整套系统化的AI辅助开发体系,结合深度定制的PyTorch原生训练引擎Archon,实现了千亿MoE模型的端到端训练,推动了下一代AI基础设施工程的创新。

零代码接入OpenClaw训练

以往的Agent强化学习训练,往往需要开发者深入理解底层框架,甚至需要对Agent的运行时代码进行修改或重构数据流水线。但是,AReaL v1.0彻底打破了这一限制 ——你的Agent框架无需改动任何代码

视频链接:https://mp.weixin.qq.com/s/w3JxlHsI1B4n3OqthaSQ6Q

让我们通过一个实际例子来看看这有多简单。

完整案例:https://github.com/inclusionAI/AReaL/tree/main/examples/openclaw

第一步:启动RL训练服务

uv run python3 examples/openclaw/train.py –config examples/openclaw/config.yaml

启动后,你会看到类似这样的输出:

(AReaL) 代理网关可在 http://x.x.x.x:xx 访问

记住这个网关地址,它是连接你的Agent与RL训练的桥梁。

第二步:配置你的Agent

我们以ZeroClaw为例,它是OpenClaw的一个变种。只需修改一个配置文件,将API地址指向AReaL网关:

# ~/.zeroclaw/config.tomldefault_provider = “localhost”api_key = “sk-sess-xxxxxxxxxxxx” # 从AReaL获取

[model_providers.localhost]base_url = “http://

” # AReaL代理网关地址

就这样,配置完成。你的ZeroClaw Agent现在每次LLM调用都会自动被记录,用于强化学习训练。

第三步:正常使用你的Agent

启动智能体,像往常一样进行交互:

zeroclaw channel start # 启动Discord/Slack/CLI等任意交互渠道

你可以让Agent编写代码、查找资料、执行任务 ——一切照常进行。在后台,AReaL悄悄记录着每次对话中用于强化学习的数据。

第四步:给出反馈,助力Agent进化

当任务完成后,给Agent的表现打个分:

python set_reward.py http://

–api-key sk-sess-xxx –reward 1.0

就这么简单。AReaL会自动将这次交互轨迹和奖励信号打包,送入训练流水线。

当收集到足够的交互轨迹后(由配置中的batch_size控制),系统会自动触发一次训练迭代,更新模型权重。更神奇的是:更新后的权重会无缝应用到后续的推理请求中。

你的Agent在训练的同时依然可以运行,无需重启或重新加载模型 —— 它会悄然变得更聪明

架构创新:通过“异步训练”和“代理网关”实现Agent自我进化

那么,AReaL是如何让OpenClaw实现自我进化的呢?这涉及到两个核心架构设计:“全异步训练”和“代理网关”。

AI助力工程革新:AReaL的全新架构解析

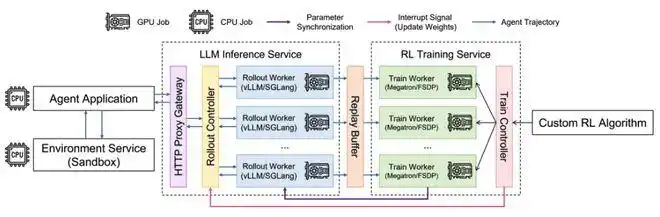

AReaL的一个大亮点就是它在强化学习中的训练和推理彻底分开。推理引擎可以不断生成轨迹,而训练引擎则在不断处理样本,这两者是在独立的GPU上同时进行的,真的是高效又灵活。

通过精心设计的PPO算法和老化控制机制,AReaL确保训练稳定性的同时,提升了超过两倍的处理能力。

这样的设计在智能体的训练场景中展现出了更大的优势——训练引擎可以异步更新参数,不会影响到智能体的推理,让你的OpenClaw在学习的同时也能全力以赴地工作。

AReaL的代理网关和全异步强化学习架构

为了兼容各种智能体框架,AReaL选择将“协议”作为统一标准,设计了代理网关(Proxy Gateway)。这个网关能够提供OpenAI/Anthropic API协议的推理服务,会把所有输入的请求重定向到本地的推理引擎(比如SGLang、vLLM)进行计算,使用起来就像一个普通的推理服务。

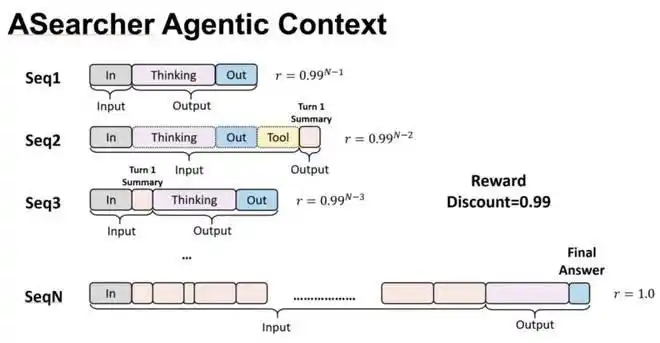

不过,这个代理网关的功能可不止于此——在进行推理的过程中,它还会抓取每次LLM交互中的Token级信息。当一条轨迹结束后,AReaL会进行奖励值的反向传播,为每一轮的输入和输出分配奖励,最终形成独立的训练样本。这样一来,早期的决策也能得到合理的奖励分配,让模型学会“为长远目标做出合理的早期选择”。

在传统方案中,推理时的文本需要在训练时重新进行token化,可能因为tokenizer配置的不同导致token序列不一致。而AReaL的独立导出方案从根本上解决了这个问题:推理时产生的token ID直接被缓存,训练时照样使用。发送给训练引擎进行梯度计算的tokens与推理引擎生成的一模一样,确保了100%的匹配。

AReaL中具体的多轮交互应用案例

基于上述架构设计,AReaL可以支持任意Agent框架的训练——无论是OpenClaw还是你自己搭建的Agent,只要将API地址指向AReaL的代理网关,就能自动接入强化学习训练。

开发者完全不需要改动原有的Agent代码或业务逻辑,就能启动RL训练流程。这意味着,原本零散的Agent接口被整合成了一层标准化的协议级RL入口,让“任意Agent可训”在工程上真正成为现实

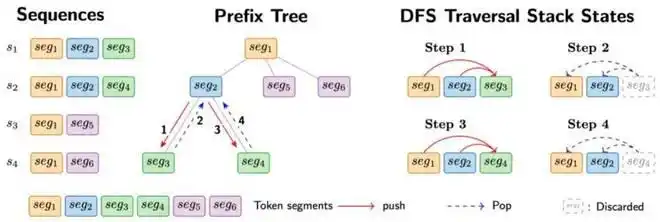

然而,同一个prompt可能会产生多条不同的轨迹(比如多次采样),而每条轨迹也会被AReaL拆分成多条独立的输入输出。一个批次的数据之间往往有大量共享前缀。在传统训练方式中,每条轨迹都是单独计算的,导致了大量的重复计算。

为了应对这个问题,AReaL引入了基于Trie(前缀树)的序列打包方案:

树状注意力的引入显著提升了性能:单个Worker的训练吞吐量最高提升8.31倍,集群整体吞吐量最高提升6.20倍,相较于基线方案减少了超过50%的GPU显存占用

针对Agentic RL训练的树状注意力实现图示,详细参考论文:https://arxiv.org/pdf/2602.00482

用AI实现引擎重构:AI Infra的工程范式革新

除了降低Agent RL训练的门槛,AReaL v1.0的发布还带来了训练引擎的重磅更新

在大规模RL训练领域,Megatron-LM被视为行业标杆。但它的安装依赖需要Docker环境和复杂的C++编译,代码层层嵌套,调试和扩展都很困难。团队一直在思考:能否用PyTorch原生API实现同样强大的分布式训练引擎

最终,AReaL团队基于torchtitan深度定制的训练引擎Archon应运而生——一个支持完整5D并行(DP、TP、PP、CP、EP)的PyTorch原生训练引擎

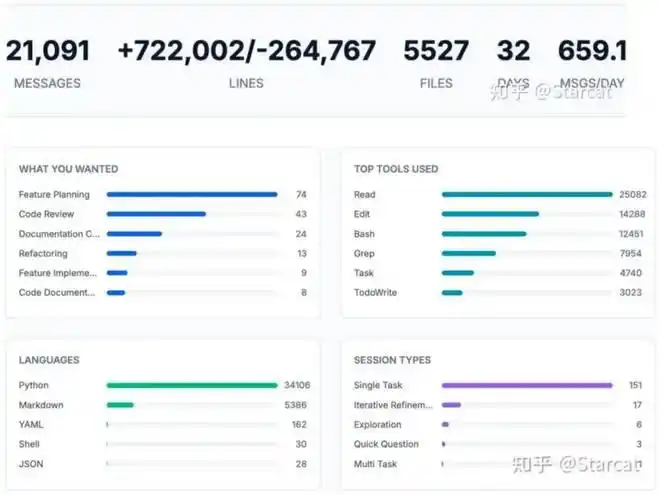

令人惊讶的是,这样一个复杂的分布式系统,从零开始到验证正确性,仅用了1人・月的工作量——在32天内通过累计72万行代码的修改完成了Archon引擎的实现,并验证了它能够训练千亿参数的MoE模型。

创造这一效率奇迹的秘密在于AReaL整合的一整套AI辅助开发体系,实现了复杂工程开发的高度自动化。

基于AI编程的Archon引擎代码修改统计,来源 https://zhuanlan.zhihu.com/p/2003269671630165191

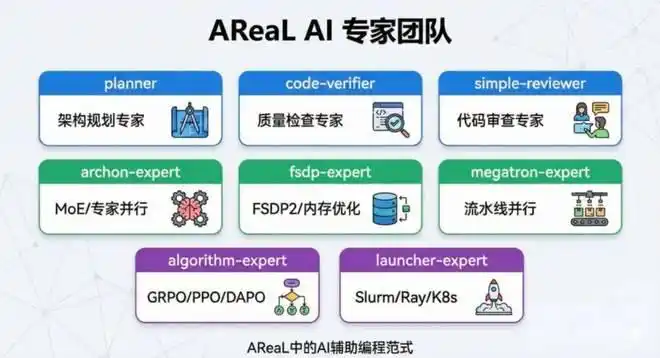

这些掌握AI编程的“秘籍”全部开源,让每位开发者都能借助“专业团队”,在AReaL中加速自己的Agent RL应用开发:

首先,为AReaL各核心模块配置领域专家Agents,使它们具备模块级架构认知,并在代码修改时提供上下文相关的精准指导。

其次,引入以命令驱动的引导式工作流,通过一系列预设的一句话指令将常见开发任务流程化、标准化,让开发方式从“手动实现”转变为“明确需求”,由AI自动完成软件工程中最常见、最耗时的运维任务。

最后,在真实的开发场景中,AReaL提供的特定Agents全程自动化完成任务规划、代码生成、自动校验到PR创建。

AReaL AI Coding Sub-Agents(图片由AI辅助生成)

这套AI辅助开发体系不仅加速了Archon引擎的落地,也释放出一个明确的信号:AI辅助编程不仅是一种效率工具,更具备深度参与复杂系统开发的实际生产力。这一“用AI造训AI工具”的工程实践,重新定义了效率的边界。

随之而来的是,软件工程的角色分工也发生了深刻的重构。人类开发者不再需要将大量精力耗费在具体实现和重复性细节上,而是可以更多地专注于“明确需求、设计系统”等决策性工作。AI将更多地承担那些流程固定、规则明确的工程落地任务。

在当前的变革浪潮中,过去依赖于工程和经验的 Agentic RL,有望因开发门槛的降低,吸引更多的开发者参与进来。

总结一下

如果说在过去的一两年里,行业主要关注的是如何教导 Agent“完成任务”,通过更好的工具使用、更复杂的工作流管理和更细致的提示设计,让 Agent 逐步完成目标。那么接下来的重点,就是“如何让 Agent 实现自我进化”。

因此,以强化学习为核心的系统化训练,从一种附加优势,逐渐演变为决定 Agent 能力上限的关键因素。

在这个关键的转折点,AReaL v1.0 为行业带来了一个易用、可靠且可扩展的开源 Agentic RL 模型:应用层保持开放,能够轻松接入各种 Agent 框架;而引擎层则经过深度优化,极大提升了训练效率和资源利用的效果。

展望未来,AReaL 团队将继续致力于提升系统组件的可用性、Archon 引擎的生产效率、AI 在开发中的辅助能力,以及 VLM/Omni 模型的 Agent 训练等四个方面,力求打造出 Agentic AI 时代的高效 RL 运行时基础设施。

随着训练框架的简化和 Agent 接入方式的统一,以及 AI 在底层系统开发中的深度支持,Agentic RL 将不再是少数顶尖团队的专属,而会成为更加普及的大众开发者的强大工具。这正是实现“技术民主化”的核心目标。

随着这种高性能基础设施的不断成熟,Agent 将能够快速超越初步 Demo 的阶段,真正进入一个持续、自主和规模化进化的新纪元。

看到这个文章让我想起我之前瞎折腾的强化学习,真想再试试!

看完这篇文章,我觉得OpenClaw的应用前景非常广阔,未来可能会改变很多行业的工作方式。

AReaL v1.0真是个好消息,零代码接入让我们这些小白也能尝试强化学习了。

建议关注AReaL的更新动态,快速发展的技术总是充满惊喜,可能会有意想不到的功能。

记得之前尝试过类似的框架,接入时总是遇到各种问题,希望AReaL能真的做到零代码接入。

看到AReaL能兼容多种Agent框架,感觉未来的应用场景会更多样化,值得关注。

希望AReaL能够持续更新,保持与时俱进,毕竟技术更新换代速度快。

如果AReaL能支持更多的自定义功能,那将更加吸引开发者使用。

希望AReaL能为更多开发者提供学习资源,毕竟零代码也需要一定的理解。

这个零代码接入的功能真的太赞了,之前的框架让我头疼不已,希望AReaL能真正做到!

零代码接入的说法听起来好,实际能不能顺利进行还是得看用户反馈,留个心眼。

看到AReaL能与各种框架兼容,觉得未来应用前景很广。

看到AReaL v1.0发布,真心觉得这对开发者是个福音!

我试过用AReaL训练模型,真的比我想象中容易多了,适合新手入门!

希望AReaL能提供更多示例和文档,帮助开发者更好地理解如何接入。

希望AReaL能定期更新,保持与技术前沿的同步,才能吸引更多用户。

想知道AReaL与其他框架兼容的具体表现,是否能无缝操作呢?