IT之家在8月29日发消息,Anthropic最近发布了一个新通知,表示他们将开始利用用户的数据来训练自己的AI模型,这些数据主要来源于新的聊天记录和代码编写记录,当然,用户如果不想参与,可以选择主动退出。此外,他们的数据显示政策也延长到了五年,这同样适用于那些没有选择退出的用户。

根据Anthropic在周四发布的博客,所有用户在9月28日之前需要做出决定。如果用户选择“接受”,那么Anthropic会立刻开始使用他们的数据来训练模型,并会保存这些数据最长达到五年。

这项新政策只针对“新启动或重新开启的聊天及代码编写会话”。即使用户同意Anthropic使用他们的数据进行训练,之前没有重新开启的历史记录也不会被纳入训练中。不过,一旦用户重新使用某段旧的聊天记录,相关数据就会被收录。

在博客中,Anthropic提到,这项更新适用于所有面向消费者的Claude订阅版本,包括免费的、专业版(Pro)和高级版(Max)。而如果是商用版本,例如Claude政府版、企业版或教育版,这次更新就不适用了,API调用场景也不在此列,比如通过亚马逊Bedrock、谷歌云Vertex AI等第三方平台的API使用。

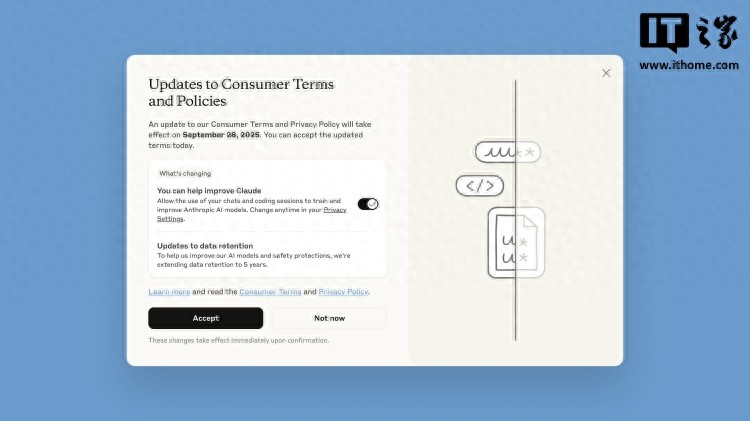

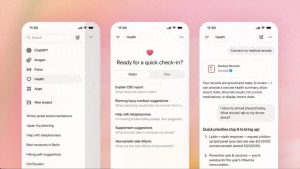

新用户在注册Claude时需要选择自己的偏好设置,而已有用户则会在弹窗中被要求确认选择,他们也可以选择“暂不设置”来推迟决定,但必须在9月28日之前做出最终选择。

需要提醒的是,很多用户可能没有仔细阅读条款,就急着点击了“接受”。在用户看到的弹窗中,明显的大字标注着“消费者条款及政策更新”,下面的说明写着“我们的消费者条款与隐私政策更新将于2025年9月28日生效,您可以今天接受更新后的条款”,底部有一个显眼的黑色“接受”按钮。

IT之家发现,在“接受”按钮下方的小字中,有几行文字提到“允许使用您的聊天记录及代码编写会话,用于训练和改进Anthropic AI模型”,旁边还有一个开关,默认设置为“开启”。所以,尽管用户没有仔细阅读条款,很多人还是会直接点击“接受”,而不去调整这个开关。

如果用户希望退出这个选项,可以在弹窗出现时把开关调到“关闭”。如果不小心点击了“接受”,想要改变选择,可以通过进入个人设置,找到隐私标签,进入隐私设置部分,然后在“帮助改进Claude”选项下将开关调至“关闭”。消费者可以随时在隐私设置中更改自己的选择,但请注意,新设置只会影响未来的数据,之前已经用于训练的数据是无法取消的。

Anthropic在博客中表示:“为了保护用户的隐私,我们会结合多种工具和自动化流程来过滤或模糊处理敏感数据。我们不会将用户的数据出售给第三方。”

这项政策真让人担忧,很多人可能根本没有意识到自己的聊天记录会被用于AI训练,建议大家仔细阅读条款再决定。

这样的政策确实让人感到不安,很多用户可能在不知情的情况下就同意了,希望更多人能关注自己的隐私设置。

这项新政策让人有些担心,用户是否真的了解自己的数据会被如何使用?希望大家能多关注隐私保护。

这种默认同意的做法确实有点令人不安,很多用户可能根本不知道自己在同意什么。希望大家能更加关注自己的隐私选择。

这项政策似乎让很多用户处于一个被动的状态,默认同意可能导致隐私泄露,建议大家在使用前认真审阅条款。

这条新规定让人感觉不太安全,很多人可能在没有充分理解的情况下就默认同意了。希望能有更多透明度,保护用户隐私。

这项政策似乎让用户面临选择困境,很多人可能会在不知情的情况下同意使用自己的数据,建议大家务必仔细查看条款。