橘鸦 AI 早报 2025-08-22

最近我在忙着搬家,可能内容的参与度会比较低,质量可能会受到影响,真心希望大家能够理解,如果有什么错误或漏掉的地方,欢迎在评论区告诉我哦。

概览

- Qoder推出了——Agentic开发平台

#1 - CodeBuddy中国版上线,免去邀请码

#2 - DeepSeek-V3.1正式发布

#3 - Deca 3 Alpha Ultra发布4.6T DynAMoE模型

#4 - Cohere推出Command A Reasoning

#5 - InternLM开源8B科学多模态模型

#6 - NexaAI发布OmniNeural-4B

#7 - OpenAI Codex CLI增加模型选择功能

#8 - OpenAI API迎来双重更新

#9 - Google Flow即将上线nano-banana文生图

#10 - Google AI Mode全球扩展新功能

#11 - Cursor恢复GPT-5待办清单功能

#12 - Runway推出Game Worlds Beta版本

#13 - Dynamics Lab发布Mirage 2

#14 - Ai2推出Paper Finder

#15 - Vercel AI Gateway正式上线

#16 - 腾讯元宝接入腾讯视频

#17 - Meta AI重组,LeCun向Wang汇报

#18 - Anthropic正在洽谈100亿美元融资

#19

Qoder推出——Agentic开发平台 #1

阿里巴巴团队发布了

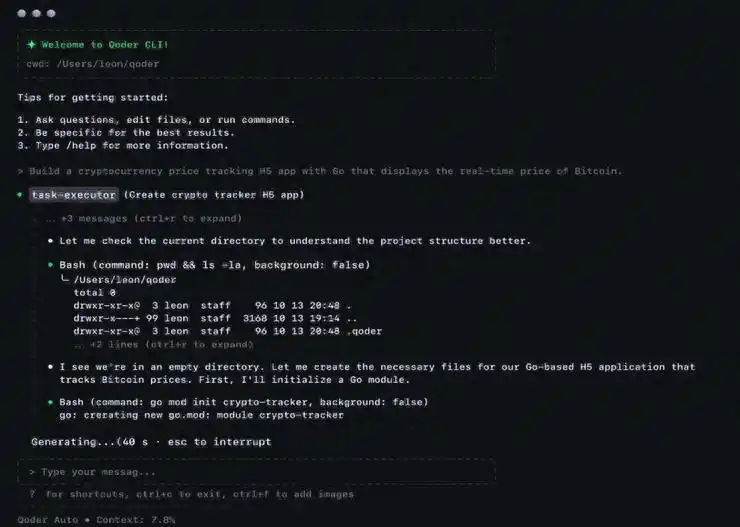

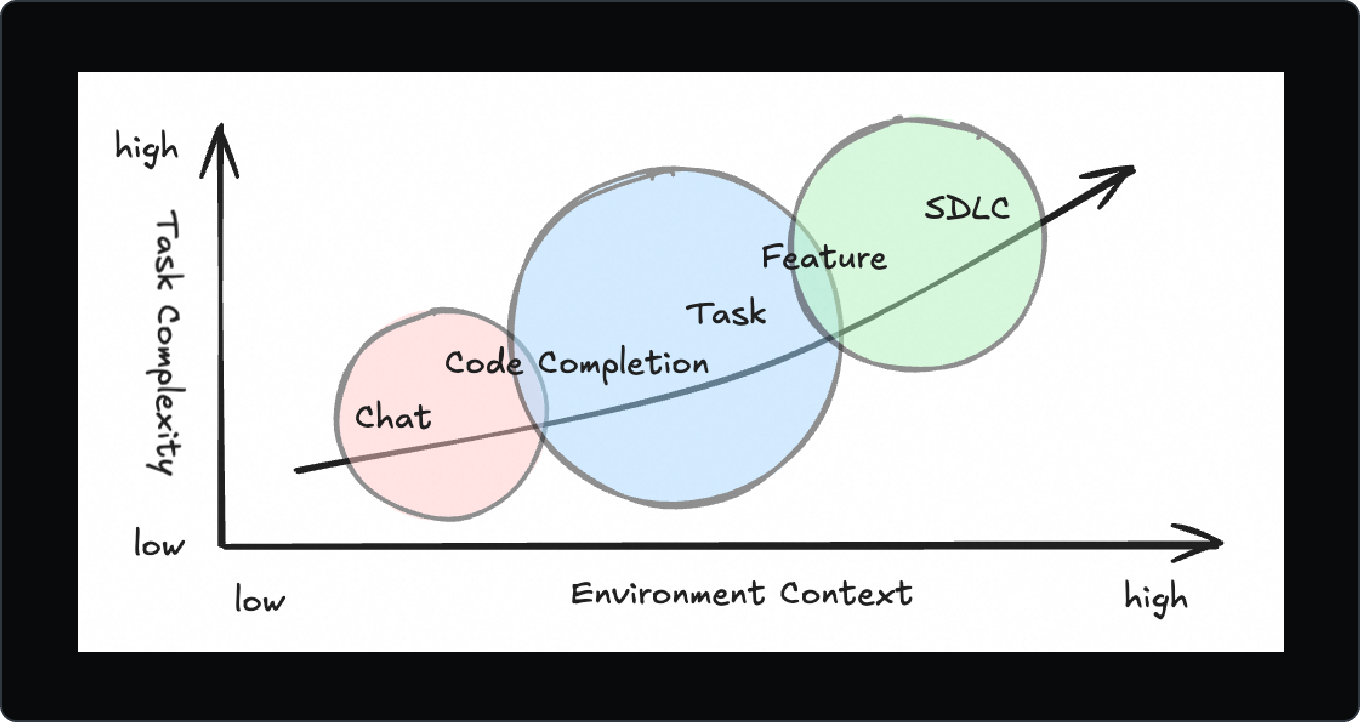

Qoder,这是一个为软件工程设计的Agentic编码平台,能深度整合主流大模型,增强上下文工程,提供从短期迭代到长期任务的全面支持。你可能感兴趣:Qoder帮你轻松升级,从“执行者”变身“架构师”!

阿里巴巴的团队推出了Qoder,这款面向真实软件工程的Agentic编码平台,现在可以免费公测,支持Windows和macOS。它深度接入了Claude、GPT、Gemini等最新的大模型,还能通过自动路由为不同任务选择最适合的模型,用户无需手动切换。

Qoder的特点是“增强上下文工程”。它在后台搭建了高性能向量数据库,客户端则构建代码图并预先索引RepoWiki,实现秒级的实时更新。同时,本地记忆系统记录个人偏好、历史经验和项目知识,避免重复解释。开发者可以使用Chat模式进行短期迭代,或者用Quest模式编写Spec后异步委托长任务,AI将在Action Flow面板上透明展示计划和进度,完成后会输出包含验证步骤和变更列表的Task Report。

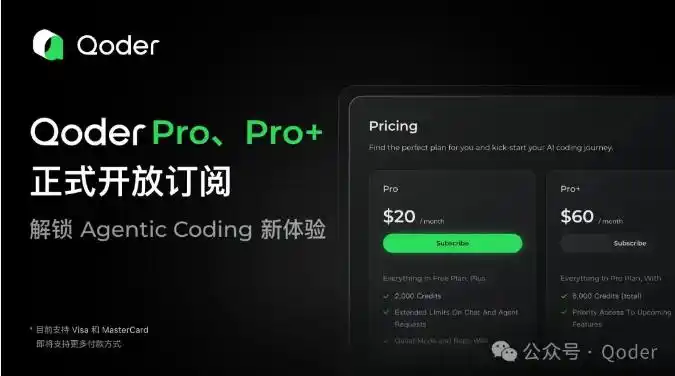

在日常编码中,Qoder提供代码补全、跨文件Next Edit Suggestions、行内编辑等无感增强功能;一键生成RepoWiki,帮助快速理解复杂项目结构。定价方面,公测阶段是完全免费的,未来Pro版的月费待公布,按Credits计费,也可以额外购买Credit Packs。

https://qoder.com/download

https://qoder.com/blog/quest-mode

CodeBuddy中国版上线免邀码 #2

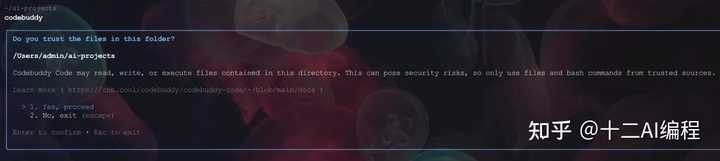

腾讯云宣布其AI代码编辑器

CodeBuddy的中国版正式开放,用户无需邀请码即可下载使用,目前处于免费公测阶段。

腾讯云宣布,针对中国市场的CodeBuddy AI代码编辑器已正式开放,用户可以无需邀请码直接访问copilot.tencent.com/ide进行下载使用。该版本内置最新DeepSeek V3.1模型,拥有代码补全、错误诊断、技术问答和性能优化等核心功能,同时兼容主流开发环境,目前正在进行免费公测。

https://copilot.tencent.com/ide

DeepSeek-V3.1正式发布 #3

DeepSeek正式推出了

DeepSeek-V3.1模型,采用混合推理架构,显著增强了工具调用与Agent任务的能力,并将在2025年9月6日启用新价目表。

DeepSeek昨天发布了DeepSeek-V3.1公告,该模型采用混合推理架构,使得工具调用与Agent任务的能力得到了显著提升。

在保持答案质量的同时,DeepSeek-V3.1-Think响应速度更快,官方测试显示其输出token减少了**20-50%**;非思考模式下,V3-0324在更短的输出下保持了同等的性能。

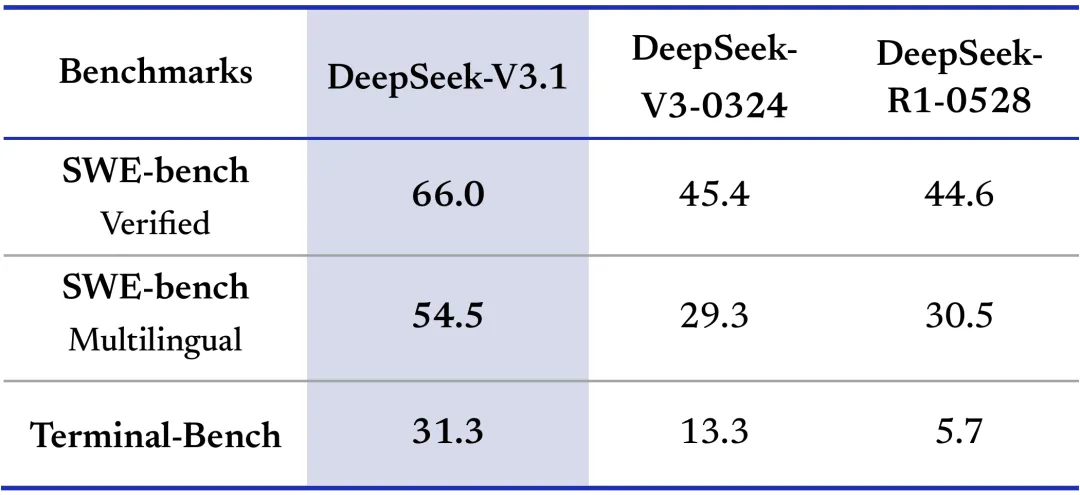

在代码Agent的场景中,SWE Verified得分为66.0,Terminal-Bench为31.3;在搜索Agent中,得分为BrowseComp的30.0,而HLE+Search得分为29.8,这些都大幅领先于R1-0528。

官方的App、网页及API也进行了同步升级:deepseek-chat对应非思考模式,deepseek-reasoner对应思考模式,上下文扩展到128K。API Beta支持strict模式Function Calling,并兼容Anthropic格式,可以直接接入Claude Code。Base与Chat模型已经在Hugging Face与ModelScope开源,MIT许可证。

同时,DeepSeek还宣布将于北京时间2025年9月6日0点启用新的价目表,并取消夜间优惠,价格在此之前保持不变,并继续扩展服务。

DeepSeek还透露,UE8M0 FP8格式的模型权重是为了适应下一代国产芯片。

https://huggingface.co/deepseek-ai/DeepSeek-V3.1

https://api-docs.deepseek.com/zh-cn/news/news250821

Deca 3 Alpha Ultra发布4.6T DynAMoE模型 #4

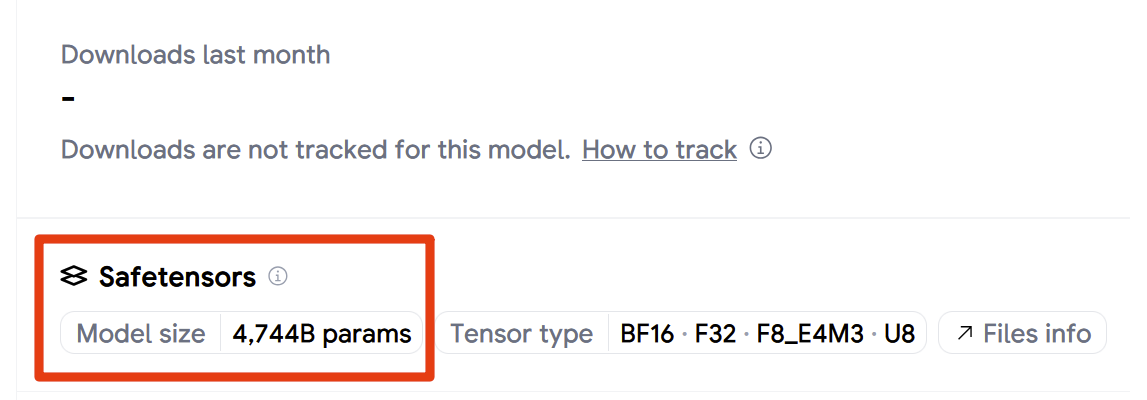

美国初创公司Deca推出了一款参数规模达4.6万亿的

Deca 3 Alpha Ultra模型,采用创新的DynAMoE架构,能够动态激活专家,显著降低了大规模模型的推理门槛。

Deca 3 Alpha Ultra模型今天上线了Hugging Face,它采用了一种名为DynAMoE(Dynamically Activated Mixture of Experts)的新架构,参数规模高达4.6万亿,是目前公开描述中最大的权重模型之一。该模型由GenLabs资助,并由美国初创公司Deca开发,训练数据涵盖了多语言和多领域,支持文本生成、摘要、情感分析和对话推理等多种任务。

新模型动态激活专家,优化内存使用

官方表示,这款新模型与传统的不同之处在于,它能根据具体任务动态选择需要激活的专家。在极端情况下,它甚至可以只用一个专家在64 GB内存上运行量化版本,而完整的推理过程则需要大约1 TB的内存或显存。目前,只有部分研究机构和战略合作伙伴获得了授权,商业使用需要单独申请;不过,随着软件的公开,未来可能会放宽限制。

Deca透露,未来计划推出一款大约有150 B参数的“迷你”版本,目标是可以在32 GB内存上运行,同时也在准备量化、适配和开放API。目前还没有基准测试的结果,团队承认卡片文本是由ChatGPT生成的,会在软件和测试准备好后进行更新。

https://huggingface.co/deca-ai/3-alpha-ultra

https://www.reddit.com/r/LocalLLaMA/comments/1mwla9s/model_release_deca_3_alpha_ultra_46t_parameters/

Cohere推出Command A Reasoning新模型

Cohere Labs推出了一个拥有1110亿参数的

Command A Reasoning-08-2025模型,专为工具调用、Agent和多语言场景设计,支持高达256K的上下文,并在多个基准测试中表现优异。

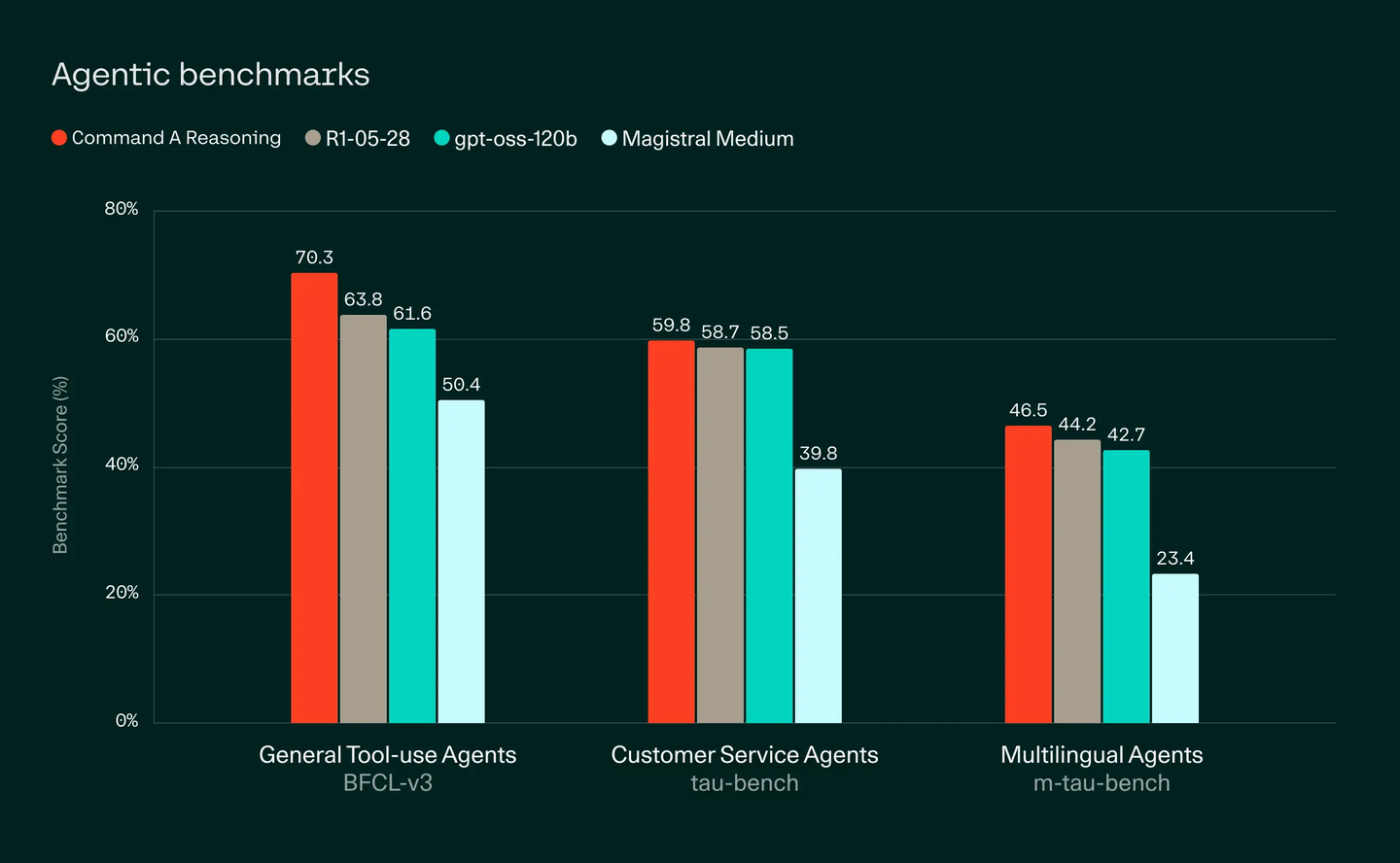

今天,Cohere Labs在Hugging Face和自家平台上线了这个1110亿参数的模型Command A Reasoning-08-2025。它采用了CC-BY-NC的研究和非商业许可,用户需同意隐私条款才能下载权重。该模型旨在支持工具调用、Agent和多语言场景,能够处理256K的上下文和32K的输出,涵盖23种语言的训练;推理开关由reasoning参数控制,可以在单个H100/A100的低功耗模式下运行128K,也可以扩展到多卡的256K。

官方博客强调,这个模型在BFCL-v3、Tau-bench、DeepResearch Bench RACE等基准测试中超越了gpt-oss-120b、DeepSeek-R1 0528、Mistral Magistral Medium,也能直接驱动企业级的Agent平台North。用户可以通过token的预算,动态平衡精度与成本,而无需维护两套模型。

https://huggingface.co/CohereLabs/command-a-reasoning-08-2025

https://cohere.com/blog/command-a-reasoning

InternLM推出8B科学多模态模型

InternLM发布了一款参数仅有8B的轻量级科学多模态模型

Intern-S1-mini,它在大量科学数据上进行了预训练,能够解析分子式和蛋白序列,且在多个科学基准测试中表现优异。

InternLM发布了这款开源轻量级多模态推理模型Intern-S1-mini,参数仅为8B,基于Qwen3-8B语言模型和0.3B视觉编码器InternViT,预训练数据总量达到5万亿,其中超过2.5万亿来自化学、物理、生物和材料等科学领域,能够解析分子式、蛋白序列并规划合成路径。

官方的基准数据显示,Intern-S1-mini在MMLU-Pro、MMMU、GPQA、AIME2024/2025等通用与科学任务上表现超过同规模模型,ChemBench的得分为76.47,MatBench为61.55,ProteinLMBench为58.47,支持文本、图像和视频输入。模型默认开启思考模式,用户可以通过enable_thinking开关进行切换。

https://huggingface.co/internlm/Intern-S1-mini

https://chat.intern-ai.org.cn

NexaAI发布OmniNeural-4B模型

NexaAI推出了全球首款专为

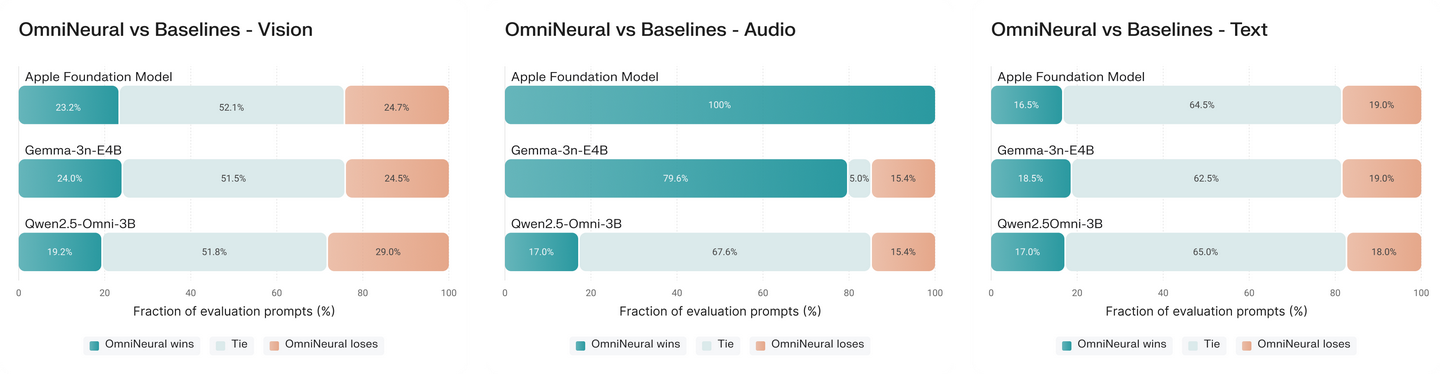

NPU设计的全模态模型OmniNeural-4B,可在手机、PC等终端设备本地运行,能够原生理解文本、图像和音频,并针对高通NPU进行了深度优化。

NexaAI宣布推出全球首款针对NPU设计的全模态模型OmniNeural-4B,能够在手机、PC、汽车、物联网设备和机器人上本地运行。这个模型可以原生理解文本、图像和音频,特别针对高通NPU进行了优化,目前仅支持Snapdragon AIPC,而Apple的NPU支持还在规划中。

在三星S25 Ultra上,OmniNeural-4B通过Snapdragon NPU实现了完全离线的多模态对话,速度比CPU快了1.5倍,比GPU快了4倍,能效提升了2–8倍。

在架构方面,它采用了ReLU、稀疏张量、卷积层和静态图,整体速度比非NPU感知模型快了20%,音频编码速度提升了9倍,图像编码速度提升了3.5倍。人类评估结果显示,视觉任务的胜率约为75%,在音频任务上领先于Gemma3n和Apple基线,文本与主流多模态模型的表现相当或更优。

在隐私方面,所有推理均在本地完成,无需联网;它的应用场景涵盖了PC与移动助手、车载安全与环境感知、工厂与无人机的多模态传感。

https://huggingface.co/NexaAI/OmniNeural-4B

https://sdk.nexa.ai/model/OmniNeural-4B

OpenAI Codex CLI新增模型选择功能

OpenAI对

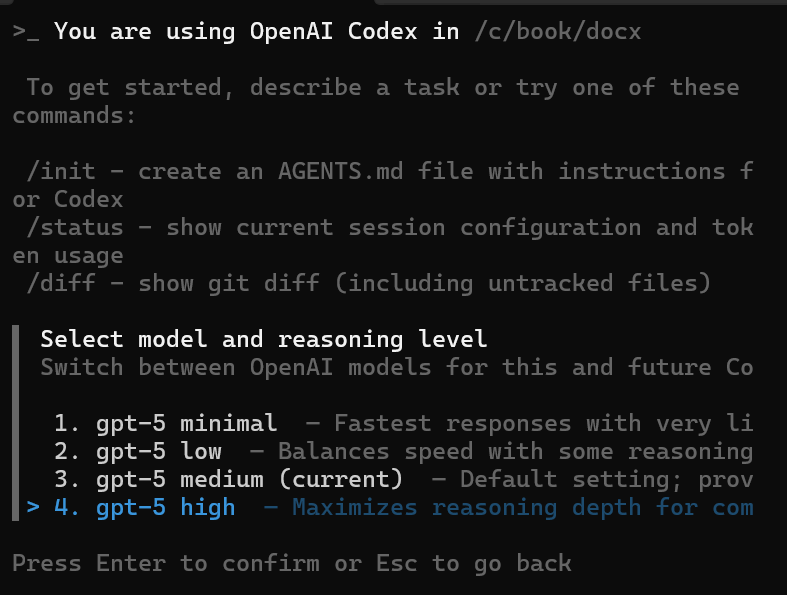

Codex CLI进行了更新,升级至v0.23.0版本,新增了在命令行中动态切换模型的功能,现在支持选择gpt-5 high等版本。

OpenAI在8月21日发布了Codex CLI v0.23.0,现在用户可以在命令行中动态切换模型,当前可选择的版本包括gpt-5 high。用户需要通过npm全局升级到最新版本:npm install -g @openai/codex,然后在交互界面输入/model即可列出并选择所需模型。

https://x.com/jesselaunz/status/1958382026924679512

OpenAI API双更新提升功能

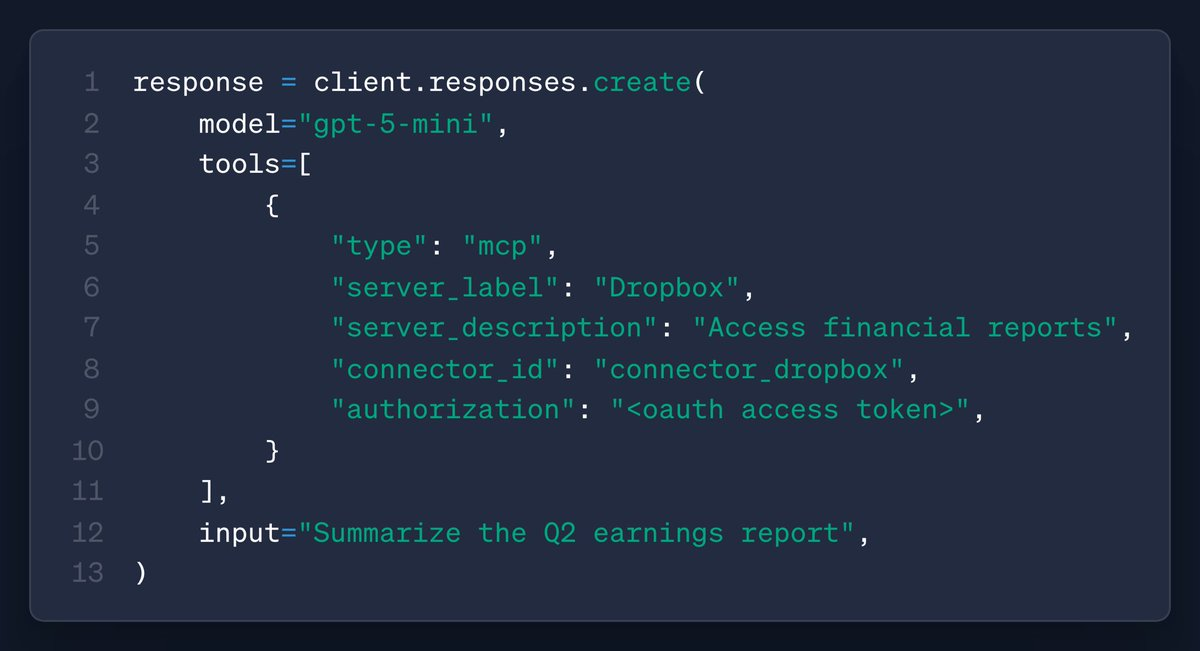

OpenAI在2025年8月21日为其

Responses API推出了Connectors和Conversations两项新功能,旨在简化外部服务数据拉取和提供原生对话记录的持久化能力。

OpenAI于2025年8月21日发布了两项更新:Connectors和Conversations。通过Connectors,开发者可以通过一次API调用,从Gmail、Google Calendar、Google Drive、Dropbox、Teams、Outlook Calendar+Email、SharePoint等外部服务拉取邮件、日程、文件及聊天记录,并可直接应用于deep research的场景。而Conversations则提供了原生的对话记录持久化能力,用户无需自建数据库,即可保存聊天线程。

https://x.com/OpenAIDevs/status/1958660214057791853

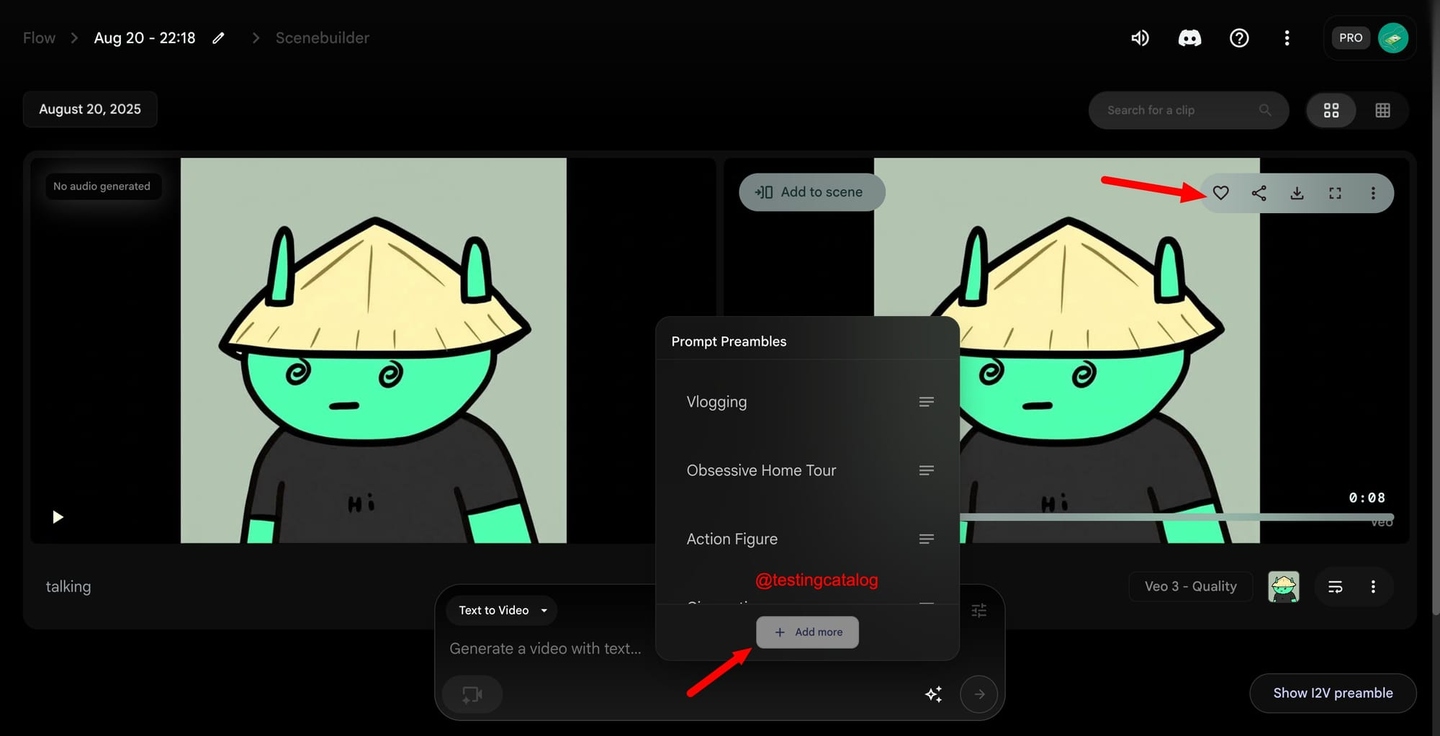

Google Flow即将上线文生图功能,快来看看吧!

Google的新创意工具要搞大事情了,马上就会把

nano-banana模型加入,推出文生图功能。用户可以上传参考图,生成变体,直接用来制作视频,特别适合TikTok和YouTube Shorts这些竖屏平台哦!

不久之后,Google的创意工具将引入nano-banana模型,新增Text-to-Image功能,用户只需上传一张参考图,模型就能生成多种变体,直接用来制作视频。这个功能会支持竖屏比例,完美适配TikTok和YouTube Shorts。在测试阶段,平台还加入了“prompt preambles”预设,像Vlogging和Cinematic这样的提示词都能自动扩展。此外,用户可以收藏视频,甚至通过二维码分享。nano-banana将聚焦多模态和参考式生成,进一步优化Google的创意流程,目前还没有明确的上线时间呢。

https://www.testingcatalog.com/flow-to-get-text-to-image-generations-powered-by-nano-banana/

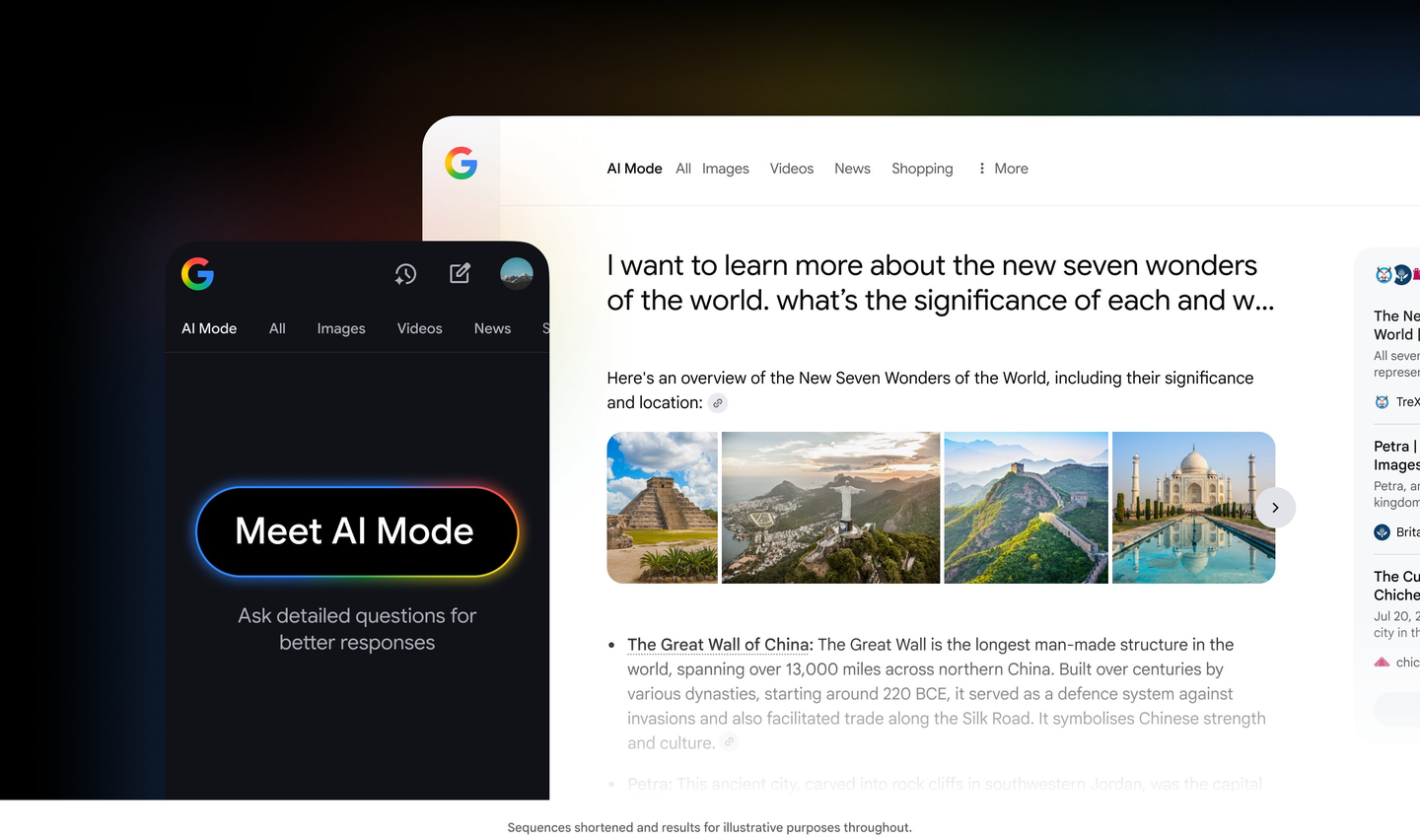

Google AI Mode的全球新功能上线啦!

Google宣布,搜索中的

AI Mode功能新增了agentic,能够自动完成餐厅预订等复杂任务,并且英文版的访问权限扩展至全球180多个国家和地区!

Google刚刚对Search中的AI Mode进行了重磅升级:新增了agentic功能,同时英文版覆盖范围也扩展到180多个国家和地区。之前这个功能只在美国、印度和英国上线,现在终于可以让更多英语用户使用啦!

这个新升级的agentic功能让AI Mode可以自动处理复杂任务,用户可以直接在搜索中查找餐厅并预订座位,未来几个月还会扩展到演出票务和本地预约。系统也引入了个性化机制,可以根据用户的兴趣和偏好调整搜索结果的顺序。而且,任何AI Mode的对话都可以通过新增的“Share”按钮轻松分享给朋友,对方只需点击就能从同一个节点继续互动。

团队表示,更多语言版本和功能更新会在不久的将来陆续推出哦。

https://blog.google/products/search/ai-mode-agentic-personalized/

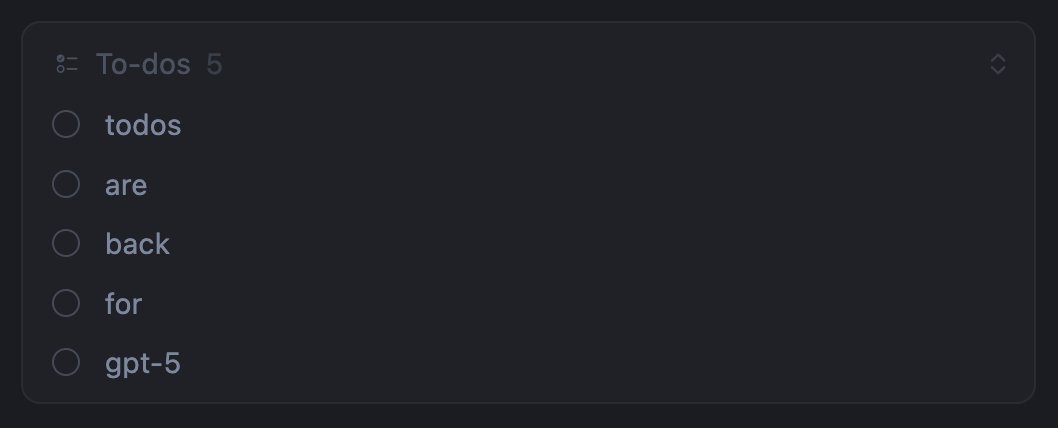

Cursor重磅回归GPT-5待办清单功能

由于用户的强烈需求,Cursor在其AI中重新启用了

GPT-5的待办清单功能,让用户更轻松地处理复杂任务,并提供实时工作摘要!

Cursor终于重新启用了GPT-5的待办清单功能。产品经理Jediah Katz表示,这一功能是应用户的迫切要求而恢复的,模型在面对长且复杂的任务时表现得更加出色,而且能实时给用户提供工作摘要,受益的不仅是Agent,还有开发者们。

https://x.com/ericzakariasson/status/1958616314278531141

https://x.com/ryolu_/status/1958648286891606416

https://x.com/shyamalanadkat/status/1958611142395544022

Runway推出Game Worlds Beta测试

Runway启动了

Game Worlds Beta测试,这个系统以AI实时生成为核心,支持用户通过文字驱动即时创造和体验个性化的故事、角色和世界。

Runway今天正式推出了Game Worlds Beta测试。这个系统的核心是AI实时生成,支持非线性叙事,用户可以立刻生成个性化的故事、角色和多模态内容。官方还准备了三款文字驱动的示例:劫案主题The Last Score、悬疑故事Athena Springs和历史题材The Gallic Storm,用户也可以自定义创建私人或共享体验。Runway表示,团队在过去几个月一直在研究如何让任何角色、故事和世界都能实时探索,而Game Worlds Beta正是实现这一愿景的重要一步。

https://x.com/runwayml/status/1958516860149997672

Dynamics Lab发布Mirage 2

Dynamics Lab推出了

Mirage 2,这是一个可以在线实时运行的通用生成式世界引擎,用户可以上传任何图像,系统便能瞬间将其转化为可实时互动的场景。

Dynamics Lab今天推出了Mirage 2,这款通用生成式世界引擎在社区中被称为“真正实用的Genie 3”。用户只需上传任何图像——无论是照片、概念艺术、经典名画还是儿童涂鸦——就能进入对应的场景并与之实时互动。系统还支持文本提示,进一步生成并操控任何超现实场景。官方演示视频显示了从静态画作到可行走世界的即时转换过程。

https://x.com/scaling01/status/1958604179741593824

Ai2发布Paper Finder文献检索工具

Ai2发布并开源了

Paper Finder,这是一个基于大语言模型的文献检索系统,模拟人类研究者的迭代检索流程,能高效查找并解释相关学术论文。

Ai2推出了Paper Finder,一款基于大语言模型的文献检索系统,现已上线paperfinder.allen.ai,同时在GitHub上开源了静态快照allenai/asta-paper-finder。这个系统模拟人类研究者的多轮检索流程:先理解查询意图,然后执行搜索、追踪引用、评估相关性,最后给出论文列表和匹配原因的简要说明。

从技术架构上看,查询先由“query analyzer”拆解为语义和元数据元素;“query planner”将任务路由到特定子流程,比如“semantic search”和“specific paper search”。语义子流程通过LLM生成多重查询,在3个稠密向量索引和Semantic Scholar API中并行检索,并结合前后引用追踪形成候选池;接着,LLM根据用户的语义标准逐篇打分,利用“batched multi-armed bandit”策略减少判断次数。系统同时提供“fast mode”快速响应(默认开启)和“exhaustive mode”深度检索两种模式。

内部评估显示,在覆盖数百万篇论文的LitSearch基准中,Paper Finder在exhaustive模式下能找到**89%完全相关、98%高度相关的结果;fast mode分别为85%和97%**。团队计划后续完善元数据查询、多轮交互、个性化以及更动态的流程控制,并逐步开源更多组件。

https://allenai.org/blog/paper-finder

https://github.com/allenai/asta-paper-finder

https://paperfinder.allen.ai/

Vercel AI Gateway正式上线!

Vercel宣布其

AI Gateway服务现已全面上线,提供统一API来调用数百种模型,具备零额外费用、高并发、自动故障转移等特点,旨在帮助开发者避免被单一模型或平台所约束。Vercel AI Gateway正式上线,开发者福音来了!

嘿,大家好!Vercel最近宣布他们的AI Gateway服务已经全面上线啦!这项服务可是个大杀器,能够通过统一的API调用数百种模型,省去了你管理各种API密钥、账户和配额的麻烦。而且最棒的是,它完全免费哦!想象一下,高并发、自动故障转移、延迟低于20毫秒,这些都帮你轻松搞定。它还兼容各种格式,已经在多个产品上为数百万用户提供服务,现在所有团队都可以正式使用了!开发者们只需要调整一下模型字符串,就能秒级切换不同的供应商,同时还能实时监控用量和成本,真是避免了被单一平台绑架的好方法!

https://vercel.com/blog/ai-gateway-is-now-generally-available https://vercel.com/ai-gateway/models

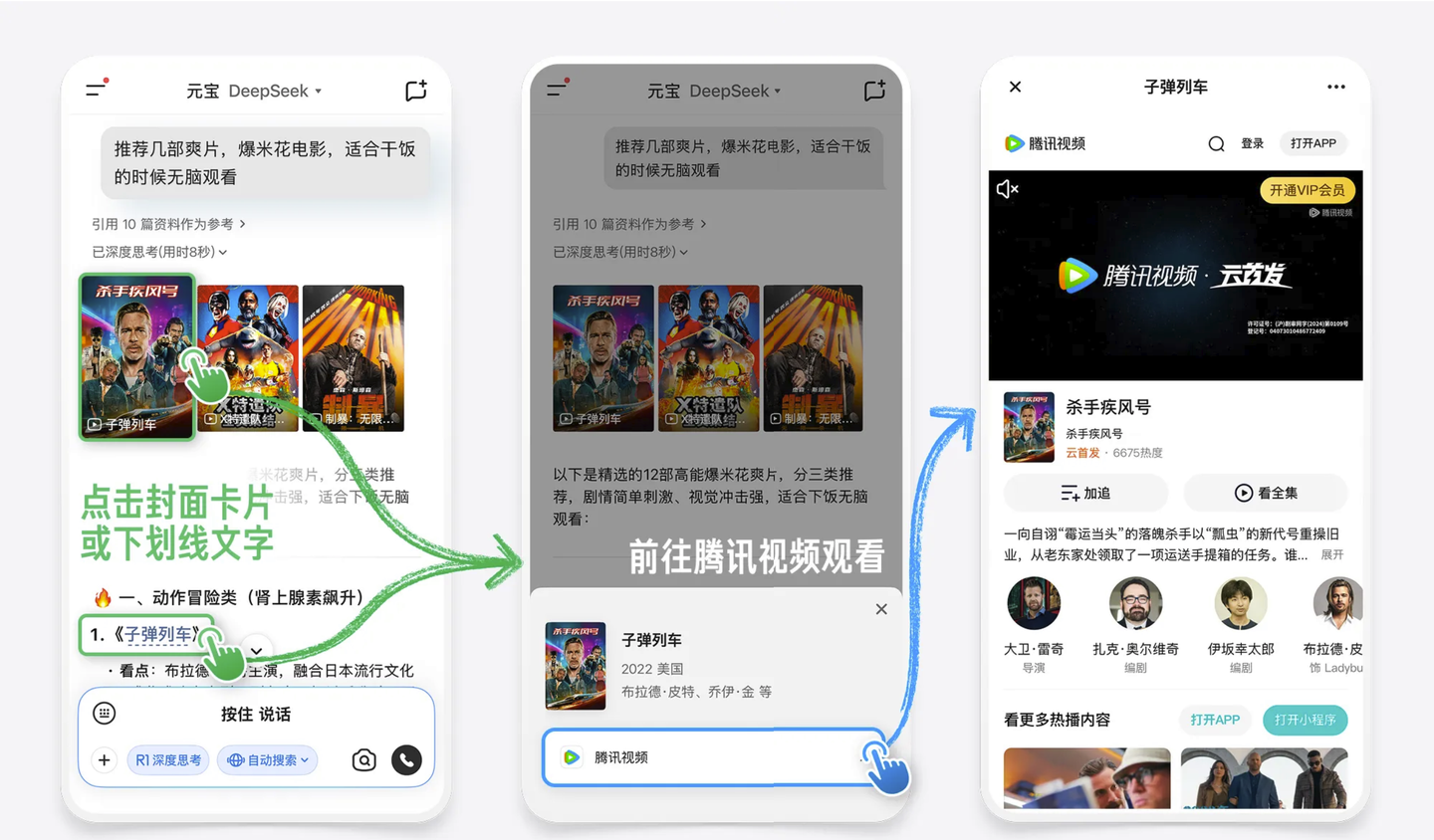

腾讯元宝接入腾讯视频,影视搜索更便捷!

好消息!腾讯元宝的移动端现在成功接入了腾讯视频,用户只需在对话中搜索影视内容,就能通过点击回答中的卡片或链接直接观看,真的是“搜到就能看”的无缝体验呀!

用户在开启联网的情况下,可以轻松地在元宝移动端搜索和讨论影视内容。如果找到了腾讯视频的片源,系统会自动生成可点击的封面卡片或者带下划线的片名,轻轻一按就能跳转到腾讯视频观看界面。

除了直接观看影片,元宝还提供了四项特别功能:只要输入片名,就能找到同类型的电影;只需描述场景、演员或类型,就能生成个性化的片单;如果你忘记片名,模糊的剧情或台词也能帮助你回忆起来;在众多剧集中,凭借片段的记忆也能准确找到想看的集数。此外,用户还可以和元宝聊聊影片的制作背景、剧情深意以及流派,提到相关作品时同样可以一键观看,真是太方便了!

这个功能已经在元宝移动端上线,赶快更新到最新版本试试看吧!

https://mp.weixin.qq.com/s/R4LOLXr53_gFCYMbEfILAQ

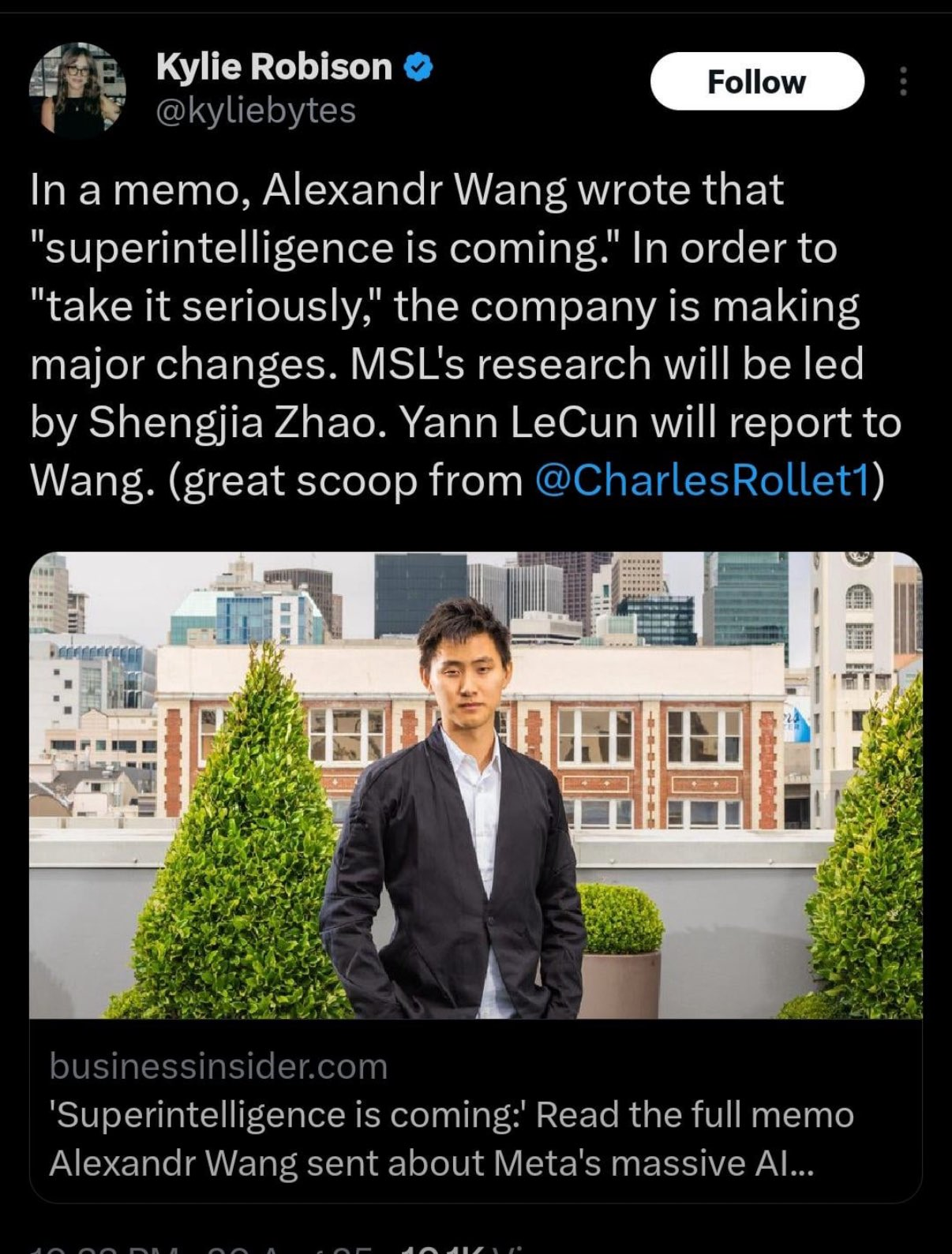

Meta AI大变革,LeCun向Wang汇报!

根据Business Insider的报道,Meta正在进行一次重大的AI研究架构调整,Scale AI的创始人Alexandr Wang宣布,之前的首席科学家Yann LeCun将直接向他汇报。

据Business Insider在8月20日的消息,Alexandr Wang在一份内部备忘录中提到,Meta正在认真对待即将到来的超级智能,因此对AI研究体系进行重组。

备忘录中还提到,Yann LeCun将直接向Alexandr Wang汇报,而Meta的超级智能实验室的研究工作则将由Shengjia Zhao接管。

https://www.businessinsider.com/meta-ai-superintelligence-labs-reorg-alexandr-wang-memo-2025-8 https://x.com/kimmonismus/status/1958411789613322746

Anthropic洽谈高达100亿美元融资!

最近,彭博社报道,Anthropic正在进行一轮高达100亿美元的新融资的最后谈判,这笔资金将使其投后估值达到约1700亿美元。

根据彭博社在8月21日的报道,Anthropic计划筹集最多100亿美元,原设定的50亿美元融资规模由于投资者的需求远超预期,直接翻了一番。融资完成后,Anthropic的现金储备将大幅提高。

https://www.bloomberg.com/news/articles/2025-08-21/anthropic-in-talks-to-raise-up-to-10-billion-in-new-funding

提示:内容由AI辅助创作,可能存在幻觉和错误。

作者

橘鸦Juya,视频版在同名哔哩哔哩。欢迎点赞、关注、分享。

腾讯的CodeBuddy也来了,两个平台比较一下,谁会更好呢?

对于Qoder的长任务委托,有没有人试过?到底好不好用呢?

Qoder支持多种大模型,选择最适合的模型是个亮点,未来会不会有更多集成呢?

听说Qoder能自动路由选择模型,这样的功能真是太棒了,不用手动切换了。

Qoder的增强上下文工程理念很新颖,是否会影响传统开发流程?期待观察变化。

CodeBuddy也上线了,两个平台的用户体验会不会有很大差异?