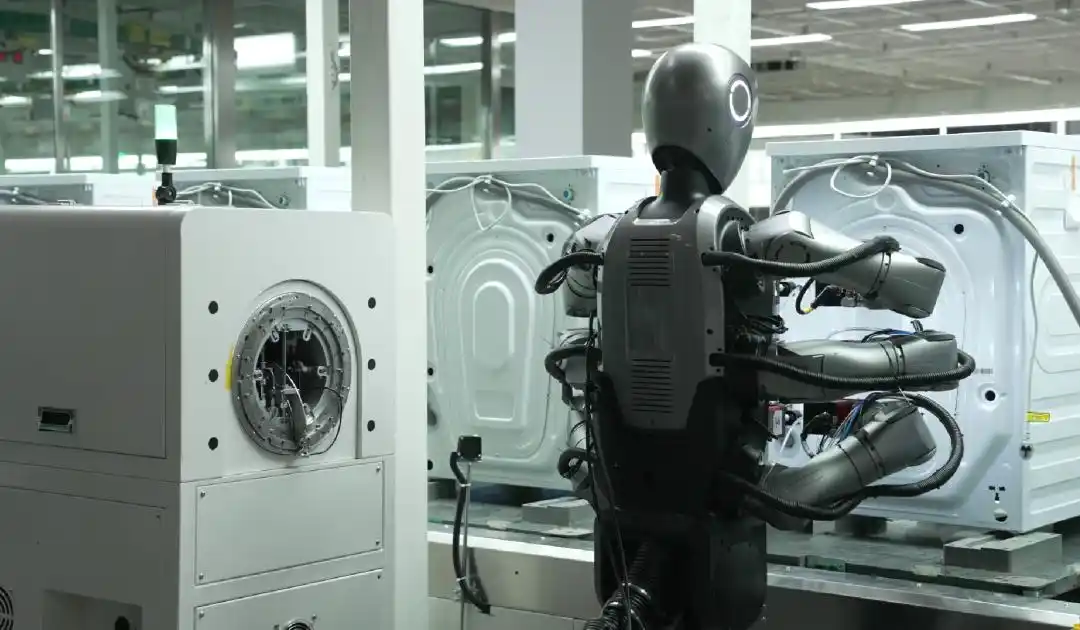

自动化信息采集工具的真相:方便却不完美

说到自动化信息采集工具,很多人都觉得它能够省去不少麻烦,免去手动筛选和查找的时间。不过,经过实际测试后,我们发现理想和现实之间的差距还挺大的。

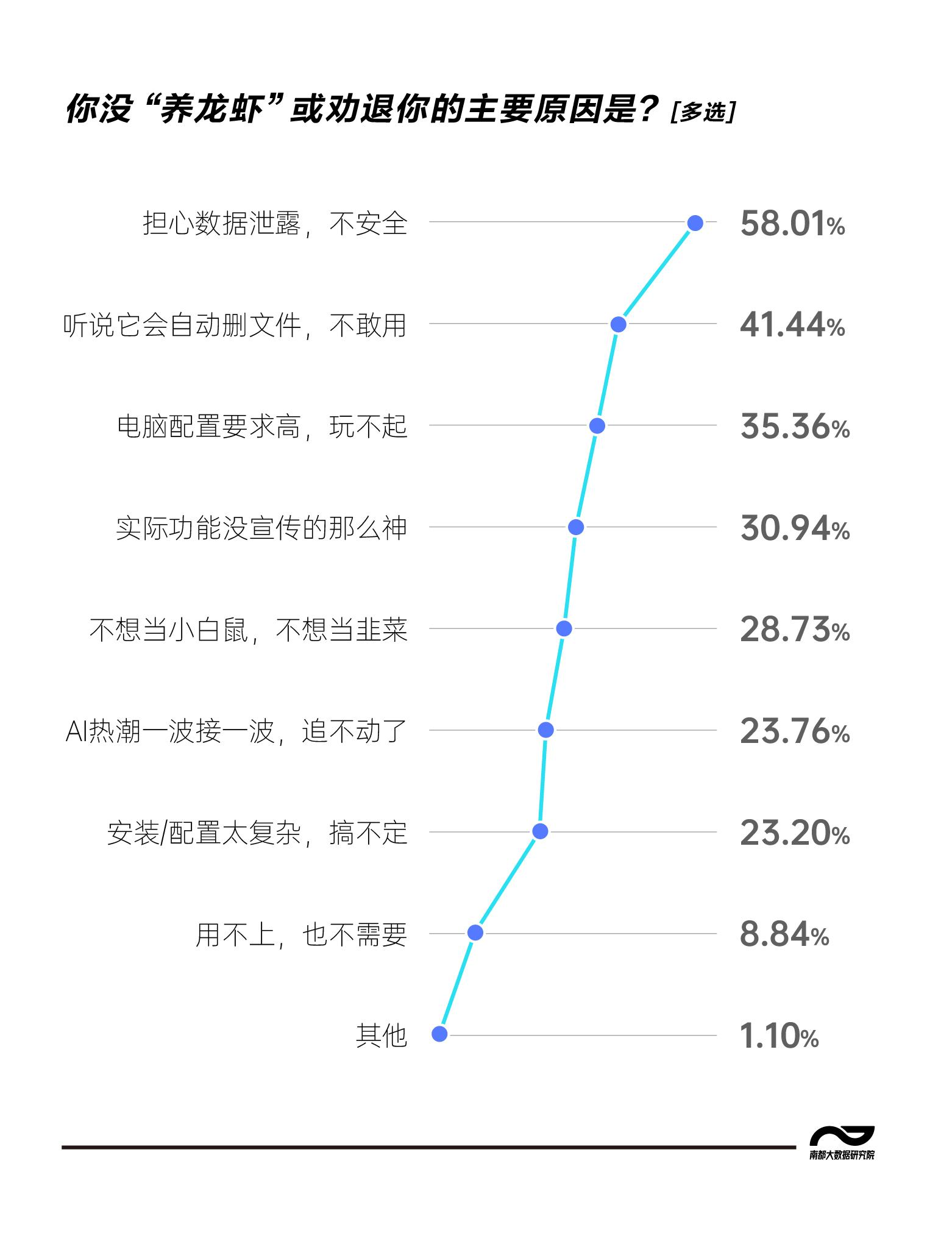

拿“龙虾”这个自动信息获取工具来说吧,用户的期待是很明确的——希望每天能轻松收到一份内容丰富的行业日报,完全不用自己动手。然而,现场测试的结果却并没有完全达成这一目标。

在我们选定的20家媒体中,发现大约35%的网站可以正常访问并抓取到内容,比如量子位、新智元、虎嗅、InfoQ、The Verge、MIT Tech Review和PetaPixel等。然而,有40%的网站则遭遇了访问限制,比如智东西和36氪会要求用户等待或扫描二维码才能继续,而TechCrunch和Wired则直接拒绝访问。还有大约25%的网站完全无法访问,原因各异,包括服务器问题、安全服务干扰和域名解析失败等。

这些问题的根源不在于媒体的内容类型,而是网络安全机制。很多网站都在使用Cloudflare或类似的服务来过滤异常访问。一旦系统判断访问请求来自机器人,就会被直接挡下。这些安全措施其实是为了防止未经授权的大规模内容抓取。

为了看看是否只有AI类网站会受到限制,我们也测试了20个摄影类网站,结果发现它们的正常访问、受限和无法访问的比例与AI类媒体几乎一致。这表明,行业类别并不是唯一的决定因素,整体互联网环境中的防爬策略正变得越来越严格。

既然全面自动抓取有技术限制,我们不妨考虑一些折中的方法,比如通过搜索工具间接获取摘要内容,使用一些支持RSS的媒体,或是降低每日抓取的数量。比如把最初的“20个媒体×每站5条”调整为“每站1-2条”,然后进行去重整理,这样也能稳定获取到20-40条高质量的信息。

最终的结论是,自动化并不是解决一切问题的灵丹妙药。它确实能提高信息获取的效率,但还得和手动维护和其他方案结合使用。与其幻想一个完全“零成本”的全自动情报中心,不如正视技术和环境的局限,找到自动化和人工干预之间的平衡点。

你在使用自动化信息采集工具的过程中有没有遇到过类似的问题或限制呢?欢迎在评论区分享你的想法和经历!

我觉得可以试试你提到的RSS方法,或许能找到更好的解决方案。

KimiClaw的实际效果似乎和预期差距不小,有没有更好的替代工具推荐?

我之前也尝试过类似的自动抓取工具,结果经常遇到一些意想不到的问题,比如抓取数据不全。

技术的限制确实让人无奈,不能完全依赖自动化。我们还是得灵活应对。

有没有人用过其他的抓取工具?效果怎么样?我也想试试。

这让我想起我之前用过的工具,抓取的数据总是有遗漏,难道真的是网络环境的问题吗?