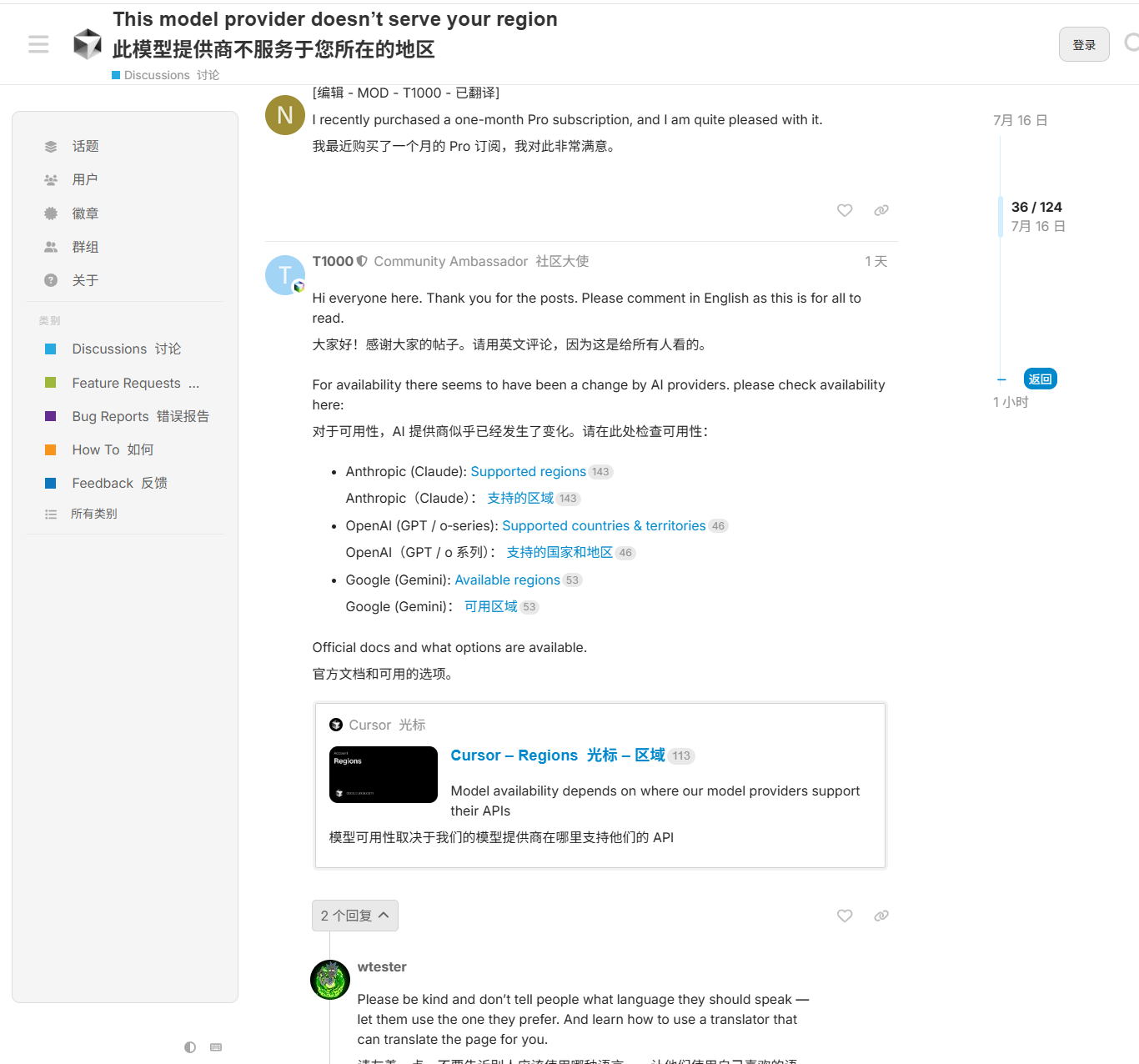

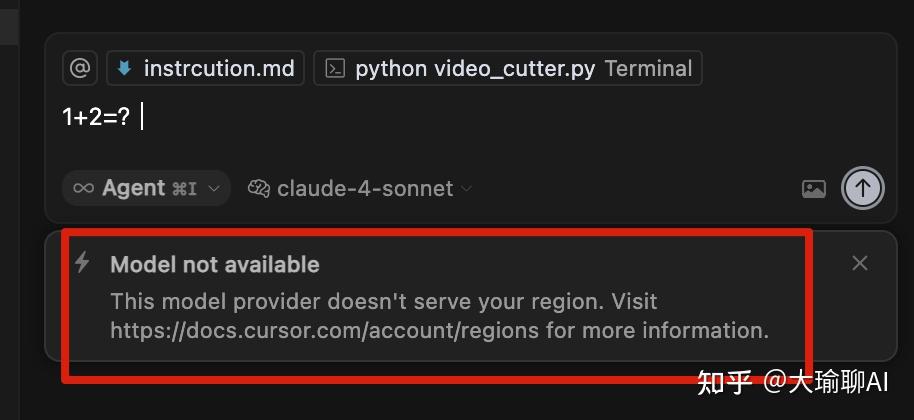

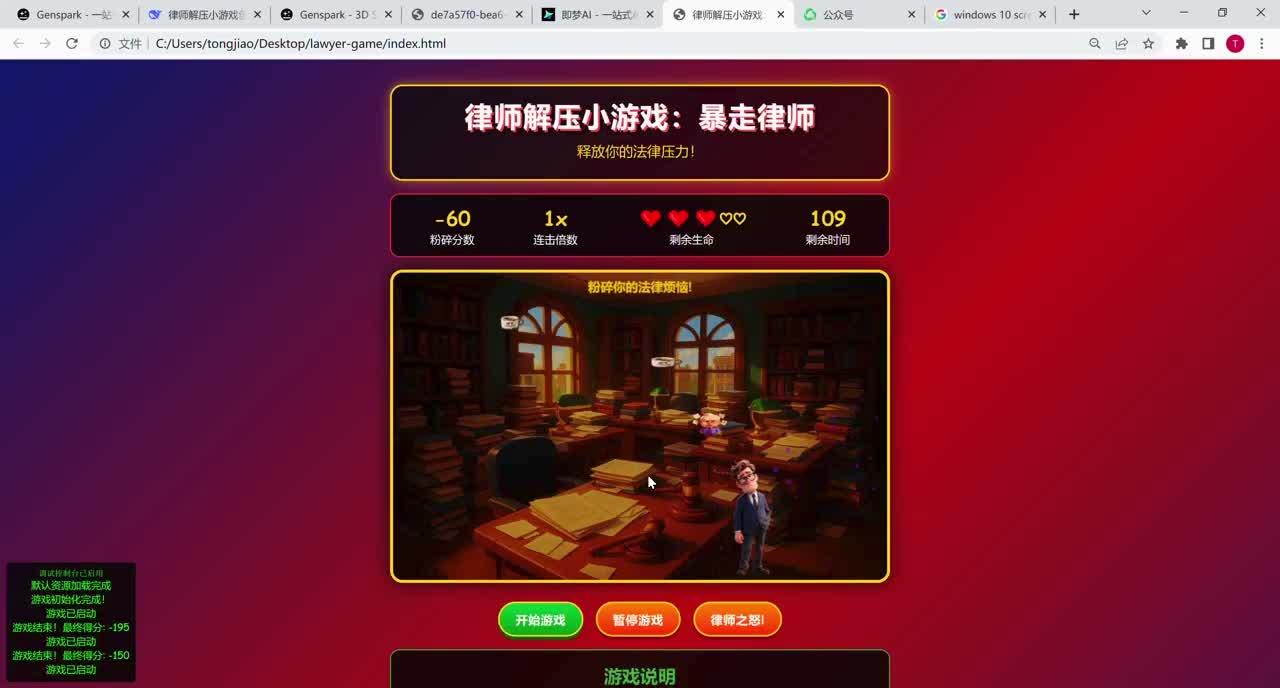

最近我用cursor配合Claude工作,效率提升了不少,所以我还特意开了Pro会员。可是今天遇到个烦心事,选择Claude和ChatGPT时,竟然弹出提示“这个模型提供者不支持你的地区”。论坛的工作人员告诉我,AI供应商换了。真是让人有点失望。

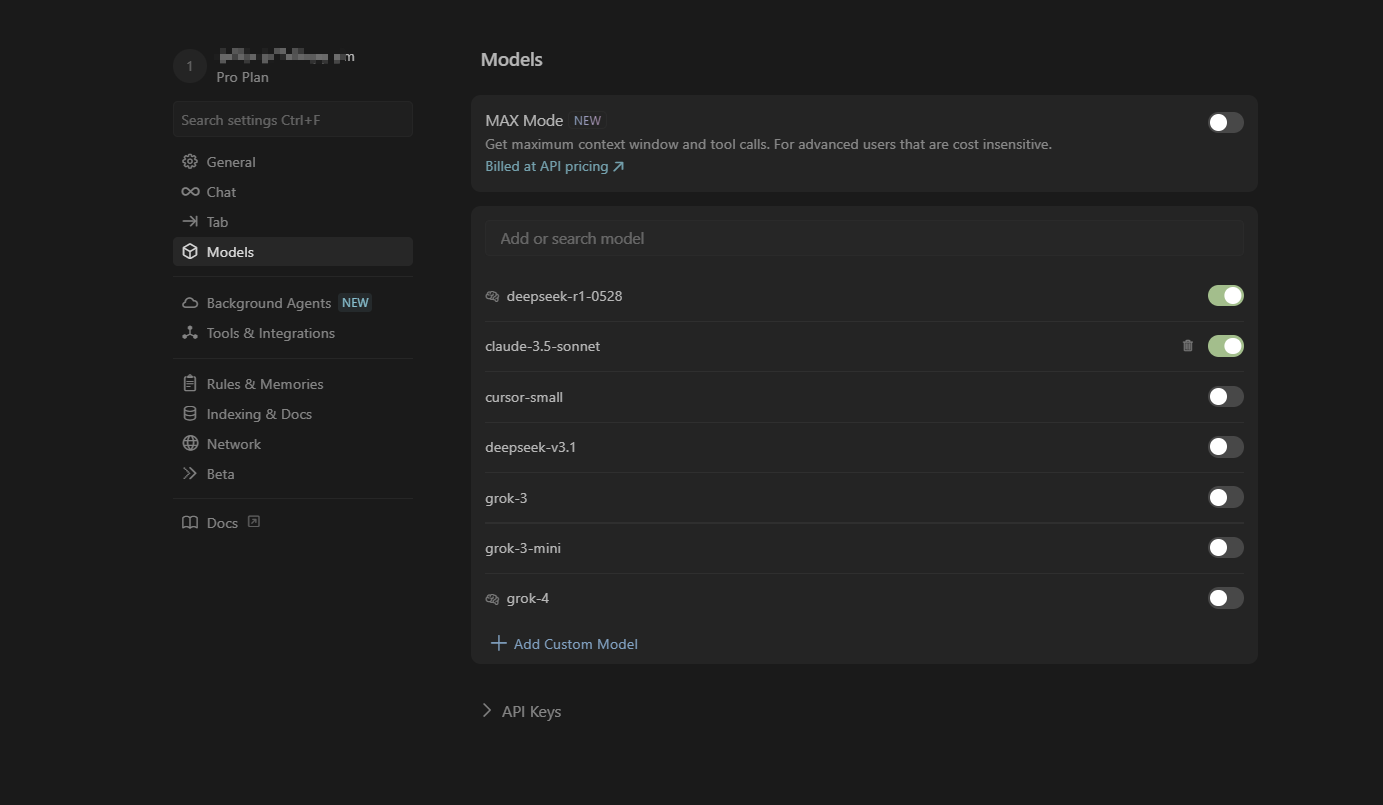

回到家一看,发现可选的模型少得可怜。

前言

cursor 这个AI编程工具,真的是让人惊叹,它简直是程序员的福音,但有时候也让人觉得有点头疼。它能帮你补全代码、续写、优化重构,甚至可以从零开始生成一个完整的项目,能力可真不一般。

想要掌握AI大模型的完整学习资料?这里有从入门到实战的全套学习路线、面试真题和PDF笔记,通通都在这里哦!

MCP 最近也火得不行,想了解的朋友可以去看看官网文档。MCP的目的是为大模型LLM调用外部资源和工具提供一个统一的标准。借助MCP,智能体可以快速接入各种工具,真的是太方便了。

MCP的生态也在快速发展,许多云平台都推出了可直接使用的MCP服务器,质量参差不齐。根据我的使用习惯,优先考虑的顺序是Smithery > composio > cursor.so > mcp.so > 官方github 等等。不同平台(mac/linux、Windows)的命令可能不一样,大家只要理解配置中的命令意思就能轻松上手了。

# 效果体验

正文

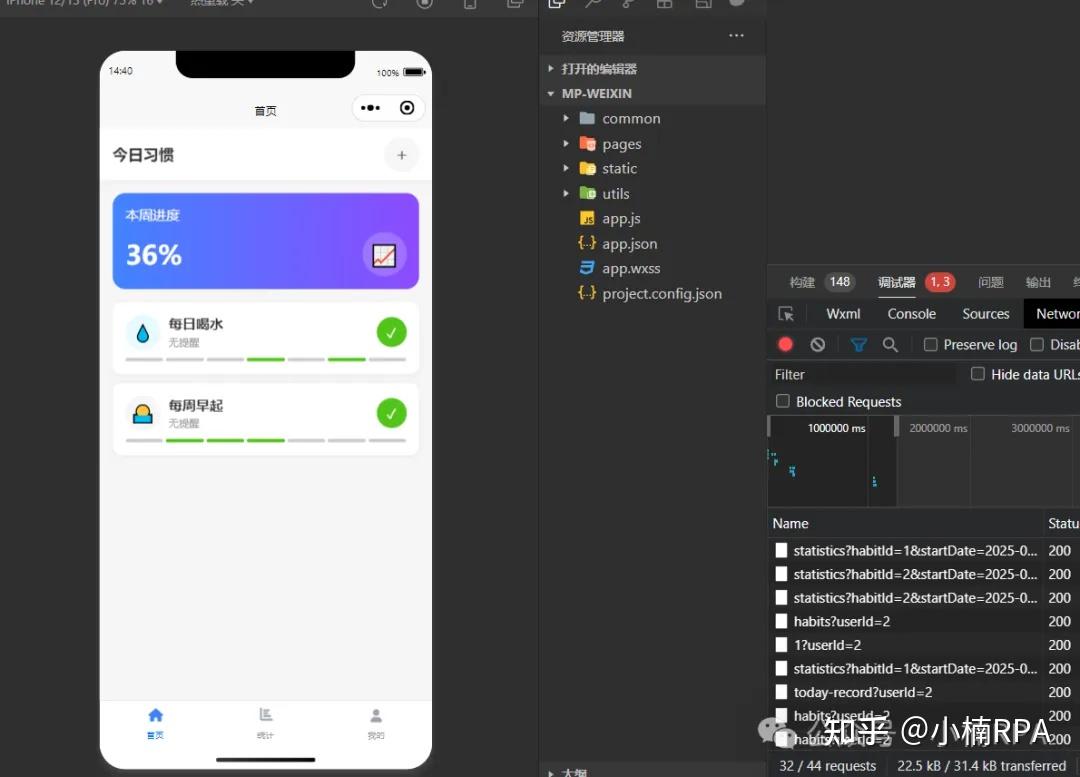

说到正事,既然LLM通过MCP服务器能做这么多事情,那要是有个软件设计工具(比如figma、墨刀、Axure、PS)也接入MCP服务器,能否实现从文本到设计图的转变呢?答案当然是可以的!不过我在找相关的MCP服务器时发现,大部分还没实现这个想法,让我不禁想对软件提供商们喊一声:加油啊!不过幸运的是,我还是找到了一家能做到的,虽然效果有点差强人意,但至少流程是通了。

FigMa MCP仓库

我们这次使用的是cursor-talk-to-figma-mcp这个GitHub仓库,相关的操作流程也都有提供。

流程

注意事项:

- 在mac和Windows系统上流程会有所不同

- figma需要下载桌面版本

第一步

首先从上面的仓库把代码拉到本地,找到项目路径sr/cursor_mcp_plugin/mainfest.json的文件,后面需要在figma里进行配置。

第二步 环境配置

按照项目中的README.md文件说明添加环境配置(mac和Windows的步骤有所区别)。

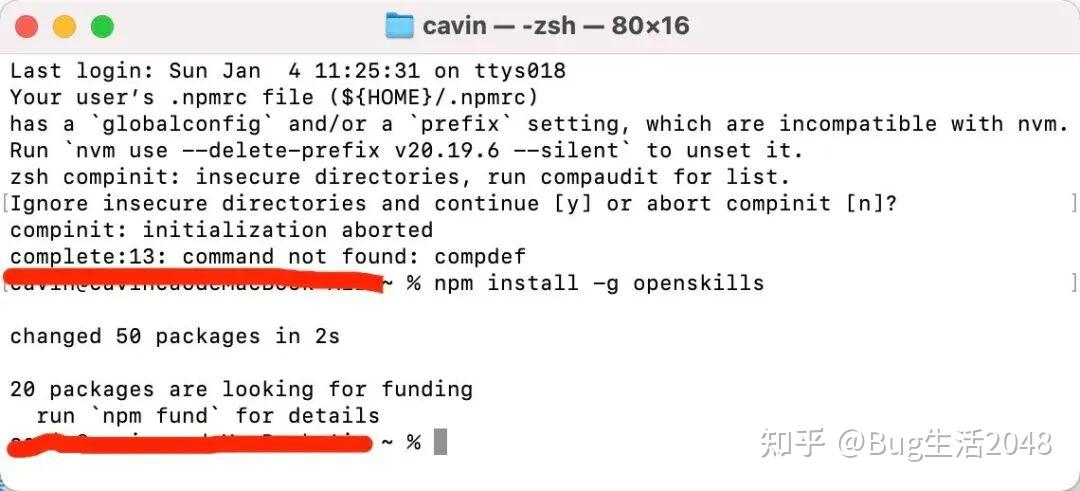

mac)

1、在终端输入以下指令

curl -fsSL https://bun.sh/install | bash2、执行设置,这样就会在你的Cursor项目中安装MCP了。

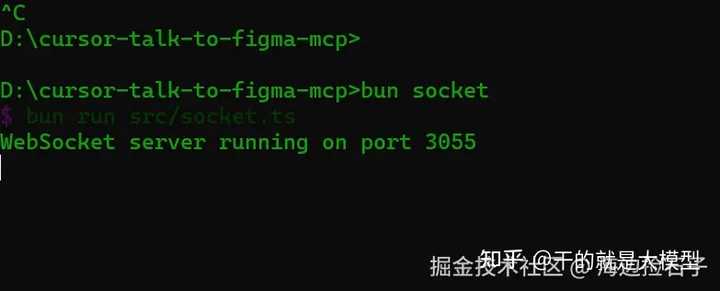

bun setup3)启动WebSocket服务器,在项目根目录下执行

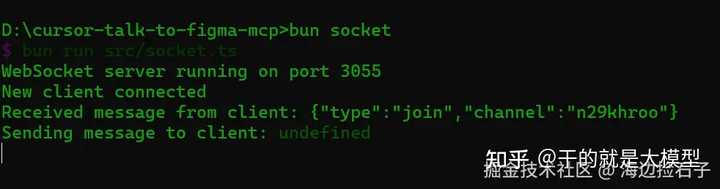

bun socket

运行一个websocket服务,服务成功启动。

windows) 1、通过PowerShell安装bun。

powershell -c "irm bun.sh/install.ps1|iex"2、启动websocket服务器,在项目根目录下执行

bun socket这样就开启了一个websocket服务,作为Cursor连接figma应用的中间服务。

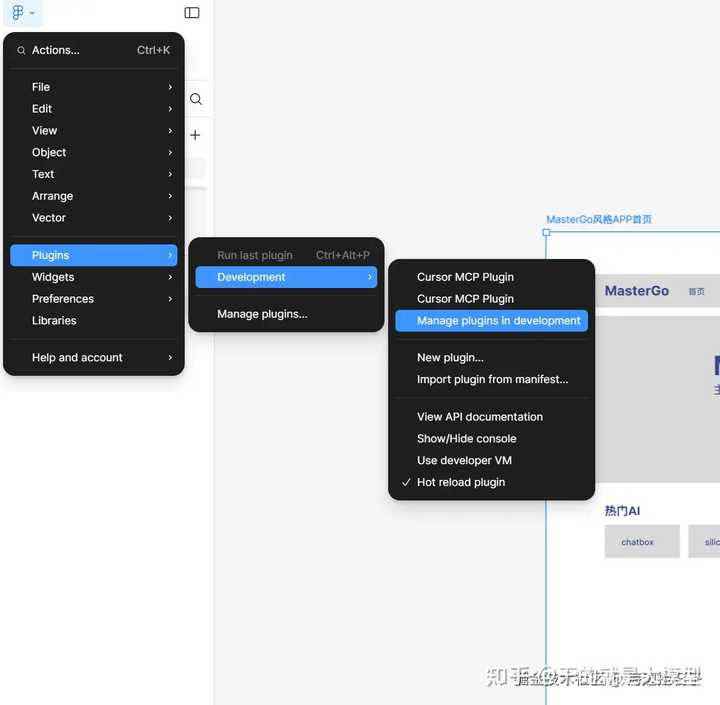

第三步 安装Figma桌面端和figma插件

Figma网页端,在左侧下拉菜单中点击“获取桌面应用”即可。

安装figma插件。

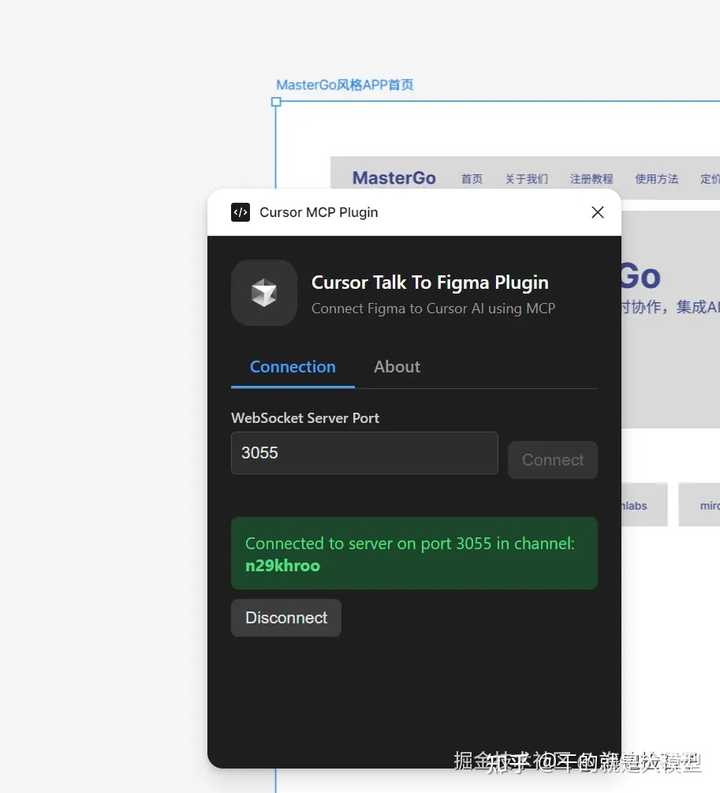

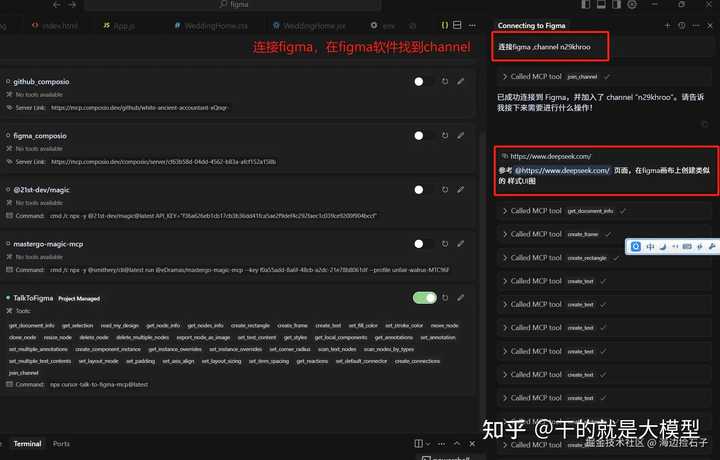

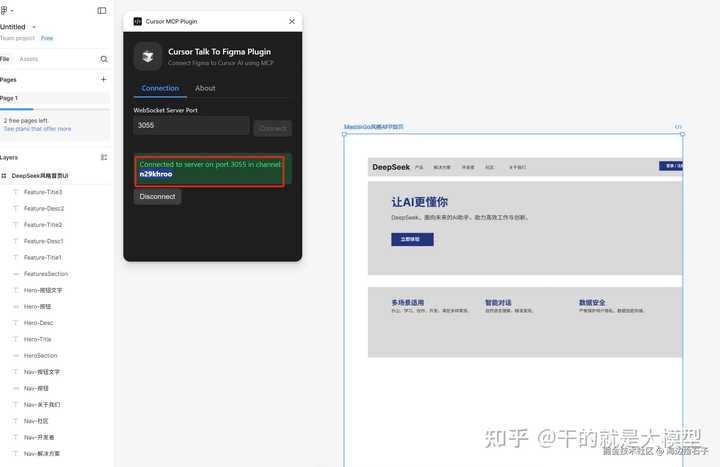

安装成功后,会弹出提示socket连接成功的页面,插件安装完成,并且随机生成了一个渠道 channel: n29khroo。

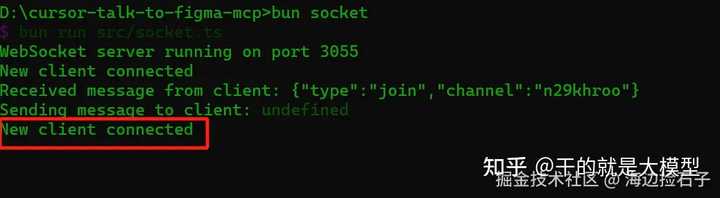

查看websocket端,能看到figma客户端已成功连接。

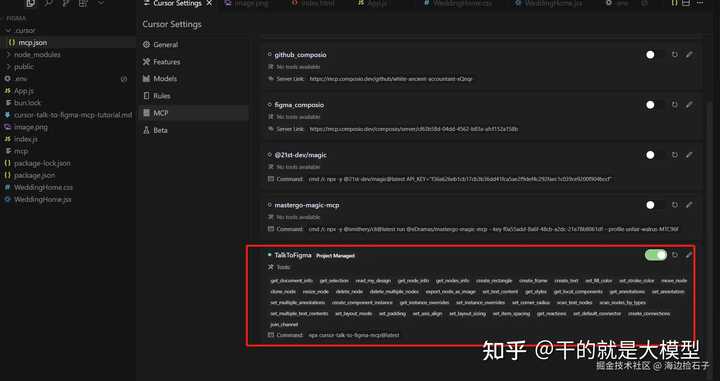

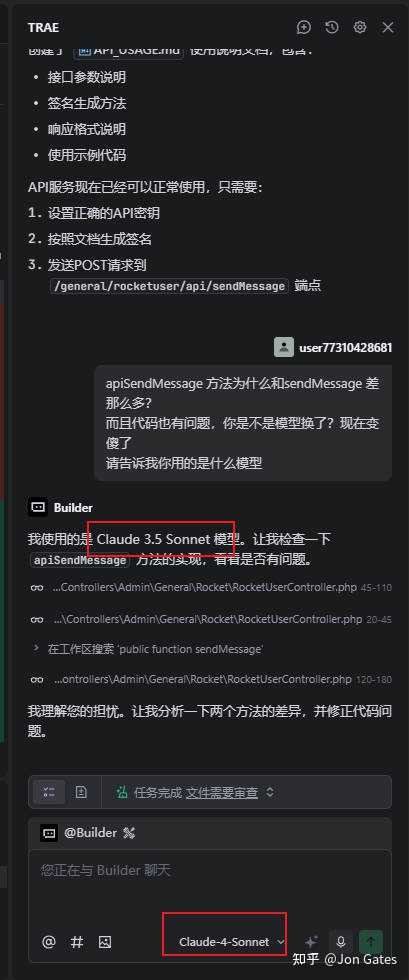

第四步 配置cursor MCP server

配置方式有两种,mac和windows可能不同。

项目中使用的是

{

"mcpServers": {

"TalkToFigma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp@latest"]

}

}

}应该适用于mac。

在Windows中测试连接客户端失败,但用下面的命令成功了。

{

"mcpServers": {

"TalkToFigma": {

"command": "npx",

"args": ["cursor-talk-to-figma-mcp@latest"]

}

}

}bunx和npmx命令的作用相似,都是用来运行项目中或远程的npm包的工具。

展示出工具,说明连接成功。在socket端的日志中也能看到客户端连接的记录。

第五步 在cursor对话

1、在figma页面找到channel,进行连接;2、直接输入对话内容,开始生成设计图。

第六步 查看效果图

刚开始做原型图,效果可能不尽如人意,但总算把流程走了一遍。

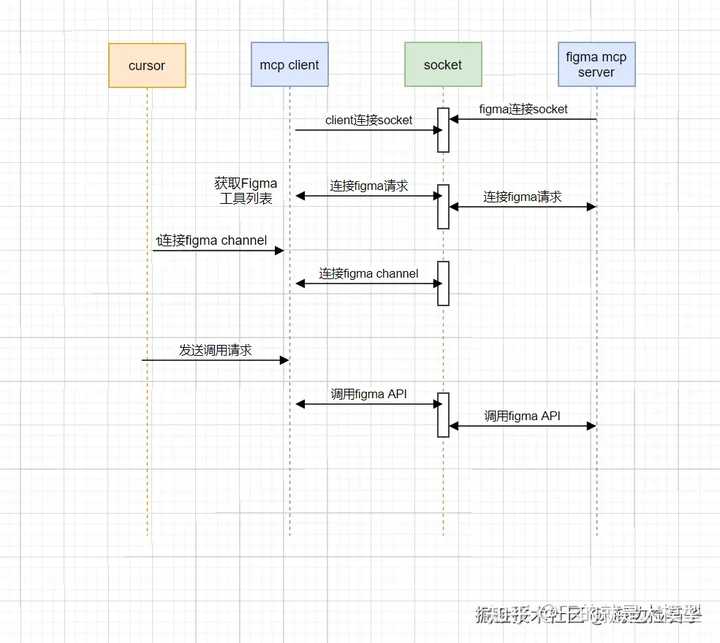

完整的调用流程

如何掌握大模型的学习方法?

学习AI大模型其实是一个循序渐进的过程,得从基础知识开始,慢慢深入到更复杂的技术。

为了帮助大家,这里整理了一份非常全面的AI大模型学习资源,包括:从入门到实战的学习路线、精选的学习书籍、视频教程、实战练习和面试题等,所有资料都是免费分享的哦!

这份大模型的学习路线大纲,从零基础到进阶,大家一定要记得收藏起来!

100套AI大模型商业化方案

全面的大模型视频教程

200本关于大模型的PDF书籍

学会后的收获:

• 通过全栈工程,大家可以实现基于大模型的项目(前端、后端、产品设计、数据分析等),这门课程能帮助你提升多种能力;

• 有能力运用大模型来解决实际项目的需求:在大数据时代,很多企业都需要处理海量数据,利用大模型技术可以更高效地分析和决策。因此,掌握大模型的开发技能会让程序员在实际项目中更游刃有余;

• 能够进行AI应用开发,结合企业的数据与大模型,掌握GPU算力、硬件知识、LangChain开发框架及项目实战技能,轻松学会Fine-tuning的垂直训练(包括数据准备、蒸馏和模型部署);

• 提升在热门领域进行大模型训练的能力,增强程序员的编码技巧:大模型的应用开发要求掌握机器学习和深度学习等技术,这些知识能够提高程序员的编程和分析能力,使其能够写出高质量的代码。

LLM面试题集合

大模型产品经理资源集合

大模型项目实战资源

有需要的朋友,欢迎点击下方的小卡片领取哦!

AI大模型完整学习资料包:包含学习路线、大模型面试真题、PDF笔记等等,让你从入门到实战全面掌握!

MCP的生态发展速度确实让人惊讶,感觉以后会有更多的工具支持这个标准,值得持续关注。

看到很多软件还没实现MCP的功能,真有点失望,开发者们加油啊!

看到很多人用cursor提升效率,真想试试,效果如何呢?

使用cursor真的能提升效率,特别是编程方面,值得尝试。

在使用过程中,发现不同操作系统的配置差异确实麻烦,真希望能统一一下。

用cursor的时候,代码补全功能确实很强大,这点我非常赞同,真的很实用。

MCP的标准确实很有潜力,感觉能带来很多便利,值得关注。

看到MCP的潜力,真希望更多软件能够快速接入,让我们能更方便地使用这些工具。

看到MCP的应用前景,想问问有没有人试过它接入其他软件,效果如何?

听说MCP越来越火,想问问有没有人尝试过不同平台的效果如何?

看到有些功能还没实现,真想对开发者们说,加油啊,期待你们的更新!