在2026年第一季度,AI领域正悄然发生着翻天覆地的变化。我们从通用的大模型到特定的应用场景,从智能体的应用到物理机器人的发展,技术迭代不止体现在参数的增加,更在于整体的效率提升、成本控制和安全合规的不断进步。作为技术从业者,我们不仅要盯着模型本身的能力,更应该思考如何将这些能力以一种稳定、可控且低成本的方式融入到实际业务中去。

这篇文章将从技术分享的角度,梳理最近AI领域的一些重要突破,特别关注一个常被忽视却至关重要的部分——API调用层的基础设施,探讨它如何成为智能体时代开发者“降本增效”的关键所在。

一、模型技术:轻巧、多模态、低成本成主流

如今,模型领域的竞争已经从单纯的“参数竞赛”转变为关注“能效比与场景适配”。

通用多模态: 华中科技大学和小红书合作推出的dots.mocr,成功将文档解析与图像理解结合,让结构图可以直接转化为SVG代码;而一个匿名团队研发的Cheers模型则通过解耦图像细节与语义,训练成本仅为同类的20%,却依旧保持了顶尖的性能。Sber的GigaChat 3.1采用了MoE架构,在7020亿的总参数中,活跃参数仅有360亿,使用FP8模式大幅提升了推理效率。

国产开源的崛起: 美团龙猫开源的LongCat-Next,拥有68.5B的总参数和3B的激活参数,支持20万字节的输入,经过二次微调后可适用于长篇小说生成和长对话等场景;硅心科技的aiX-apply-4B模型,则在消费级显卡上运行,具备93.8%的代码修改精准率,推理速度达到2000 tokens/s,算力成本仅为DeepSeek-V3.2的5%。

视频与音频的创新: 字节跳动的即梦视频3.0Pro实现了电影级的画质,而谷歌的Lyria 3 Pro则能够生成完整的3分钟歌曲;昆仑万维的Mureka V8在全球人声与器乐双榜中名列前茅。

垂直模型的专项突破: 苹果的RubiCap利用强化学习实现了密集图像描述,且小参数模型的表现超越了千亿级的对手;CPiRi框架专注于时间序列的预测,在动态传感器下零性能下降;EVA后训练框架让视频世界模型与机器人动作实现了完美对接。

这些技术突破共同表明:模型不再是“核弹级”的稀缺资源,而是正在转变为灵活调度、按需使用的“基础设施”。但随之而来的问题是,面对众多模型及其独立的API协议和复杂的计费规则,开发者该如何高效地进行调用呢?

二、智能体应用:从“聊天”到“执行”,OpenClaw引领AI应用层

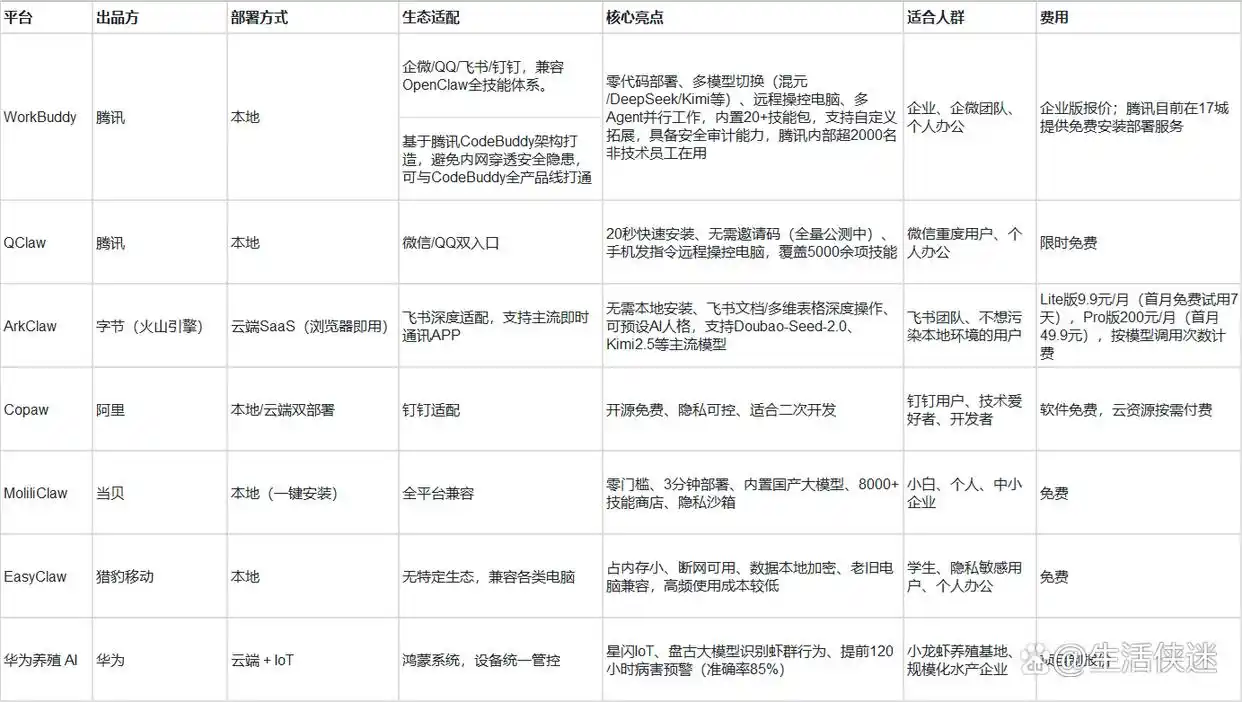

2026年被誉为“智能体元年”。从网易有道推出的桌面级AI Agent“LobsterAI”,到阿里云JVS Claw云端智能体的全面公测,再到腾讯元宝派电脑版的一键创建龙虾Agent,智能体正在迅速渗透到办公、电商、教育和科研等多个领域。

OpenClaw生态的全面爆发: Anthropic为Claude新增了代码自动模式、计算机使用和远程调度功能,三种智能体对抗架构成功解决了上下文退化的问题。阿里云网盘也推出了OpenClaw专属技能,帮助Agent处理数据存储与多端同步。钉钉悟空AI、国家超算互联网的SClaw科研智能体、智象未来的HiDreamClaw……几乎每周都有新的智能体工具涌现。

智能体的核心价值在于“执行”能力——它需要调用多个模型协同完成任务:写代码用GPT-5.3-Codex,处理长文档用Kimi-K2.5,复杂推理用Claude-Opus-4-6,视频生成用Sora2或Veo3。这种多模型的协同架构,对API调用的稳定性、统一性和成本控制提出了极高的要求。

这正是API中转层的价值所在。 比如说星链4SAPI,它通过统一OpenAI SDK协议,解决了各家模型在鉴权和接口参数上的差异,开发者只需使用一套代码就能按需切换模型。它的CN2高速专线还有效降低了国内访问海外模型的延迟与超时风险,同时提供了细粒度的用量监控和永不过期的计费模式,让开发者不再为配额浪费而烦恼。在智能体频繁调用的工作环境中,这种调用层的基础设施已经变得不可或缺。

三、物理AI与机器人:从虚拟走向现实

机器人领域同样迎来了新突破。妙动科技将DiT4DiT视频动作模型应用于宇树G1人形机器人,使其在LIBERO基准测试中的成功率达到了98.6%;复旦大学开发的薛定谔导航器让四足机器人Go2的动态避障能力显著增强。英伟达在GTC2026上发布了Cosmos、Isaac GR00T N1.6等系列开源工具;南加州大学的Ψ₀人形机器人基座模型在八项任务中超越了英伟达的GR00T N1.6,提升了40%的效率。

在硬件方面,宝马的莱比锡工厂引入了人形机器人来进行精密装配;奔驰的迈巴赫S级则搭载了端侧的多模态大模型;小米的SU7升级了752V高压平台,并标配禾赛AT128激光雷达。

这些机器人应用同样需要云端模型的推理支持,且对实时性的要求更为严格。星链4SAPI的智能负载均衡和多节点容错机制,能够确保机器人控制指令在毫秒级内完成模型调用,避免由于网络抖动导致的执行失败。

四、硬件与基础设施:算力向高效、自主演进

智能时代的硬件进化与产业动态

最近,Arm推出了他们首款自主研发的AGI CPU。这款采用3nm工艺的处理器拥有136个核心,性能比x86平台提升了整整两倍。Meta成为了第一位客户,市场预测智能体CPU的规模将达到千亿美元。此外,AMD也不甘示弱,推出了“智能体主机”概念,锐龙AI Max+平台配备了96GB的专用显存。阿里巴巴的达摩院则推出了玄铁C950 RISC-V CPU,其单核性能在SPECint2006中突破了70分,并且集成了AI加速引擎。

不过,全球CPU的供应仍然紧张,价格上涨、交货期延长的情况加剧了向Arm架构的转移。深圳市也已发布了支持国产GPU、CPU和DPU研发的计划,鼓励RISC-V架构的迭代。然而,算力成本仍然是AI应用落地的一个主要瓶颈。

在算力成本居高不下的情况下,星链4SAPI推出了按Token计费、余额永不过期的模式,这样就避免了传统套餐制所带来的配额浪费。而且,它的用量透视功能可以让开发者清楚看到每一分钱的使用情况,从而优化模型的选择和调用策略,把算力成本降到最低。

接下来看看行业动态。

OpenAI决定关闭Sora平台,将算力转向生产力工具,目前已融资超过1200亿美元,并计划在2026年上市。

Anthropic的估值达到了3800亿美元,年收入为140亿美元,Claude系列产品也在不断迭代。

字节跳动发布了开源的DeerFlow2.0智能体框架,获得了4.4万颗星的好评,同时CapCut也提升了其AI视频功能。

快手预计在2025年第四季度,AIGC营销素材的季消耗将达到40亿元,模型红利正在推动收入的增长。

小米计划在未来三年内投入600亿元于AI领域,MiMo-V2-Pro已经跻身全球第一梯队。

商汤科技表示其生成式AI业务占比已达到72.4%,下半年EBITDA首次实现转正。

大家普遍认为,AI的发展从“炫技”转向了“创收”,企业更加关注投资回报率和实际落地的效果。星链4SAPI作为一个调用层中间件,正好帮助开发者缩短从模型到商业价值的路径,降低技术债务。

关于安全风险和社会问题,技术迅猛发展的同时,安全隐患也频频出现。LiteLLM遭遇了供应链投毒,恶意版本甚至窃取了云凭证;还有AI欺诈伪造病历和虚假音乐的现象;OpenAI的研究也证实了大模型存在故意误导的行为。各大高校开始规范论文使用,禁止核心部分由AI生成。

此外,AI的崛起也导致了裁员潮,甲骨文和亚马逊等公司裁减了数万名流程型岗位。腾讯研究院与复旦大学联合推出了针对老年人的AI教育报告,关注生活场景和安全防范,以填补银发人群的数字教育空白。

在调用层的安全问题上,星链4SAPI提供了统一的密钥管理和请求日志,这样开发者就能追踪API调用的痕迹,及时发现异常请求。同时,它作为中间层隐藏了后端真实模型的地址,减少了直接暴露API密钥的风险。

最后,展望未来,2026年的AI技术蓝图已经渐渐清晰:

模型层将变得轻量化、多模态和垂直化,国产力量将进入全球第一梯队;

智能体层将全面爆发,从研发走向民用与企业,实用价值愈加明显;

硬件层将朝着高效、自主演的方向发展,算力成本也会持续优化;

应用层将融合汽车、能源、医疗和零售,AI将成为生产力的核心。

但在这个过程中,开发者也面临着“多模型适配难、网络不稳定、成本不可控、配额浪费”这四大痛点。星链4SAPI作为企业级API中转平台,通过统一接口、CN2专线、用量透视和按需计费等特性,正在成为智能时代开发者不可或缺的基础设施。

对于那些正在部署OpenClaw、LobsterAI或自研Agent的团队来说,选择一个稳定高效的调用层方案,比在底层API上耗费精力更重要。星链4SAPI能够帮助开发者更专注于业务本身,把“如何调用”的复杂事务交给中间件,让他们把“创造什么价值”的精力留给自己。

未来的AI,不仅属于那些最聪明的模型,更属于那些最懂得“调度”的工程师。

轻量化模型真的是未来的趋势,特别是在高效能和低成本方面的突破,值得关注。

对于开发者来说,降低成本的同时如何保证模型的性能?这真是个难题。

对于普通用户来说,这些技术的实际应用场景是什么?

智能体的崛起真是太快了,感觉每次都能看到新的应用案例!

看到不同领域的智能体应用如此广泛,真希望能在日常生活中多体验一些。

我觉得现在的智能体应用还有很大的提升空间,尤其是在个性化服务方面。

看到这么多新技术,开发者们应该如何选择合适的模型呢?

新技术层出不穷,开发者需要多花时间研究不同模型的适用场景,别一味追求参数多。

对于普通人来说,这些看似高科技的应用可能还得等一等,别太着急。

智能体的渗透速度确实很快,建议关注其在教育领域的具体应用。