在GPT-5.2系列模型发布一周后,OpenAI又有大动作。美东时间18日(周四),他们推出了基于GPT-5.2的新一代Codex模型——GPT-5.2-Codex。这款被称为最前沿的智能编码模型,专注于专业软件开发和网络安全,进一步强化了OpenAI在AI编程领域与谷歌Gemini的竞争力。

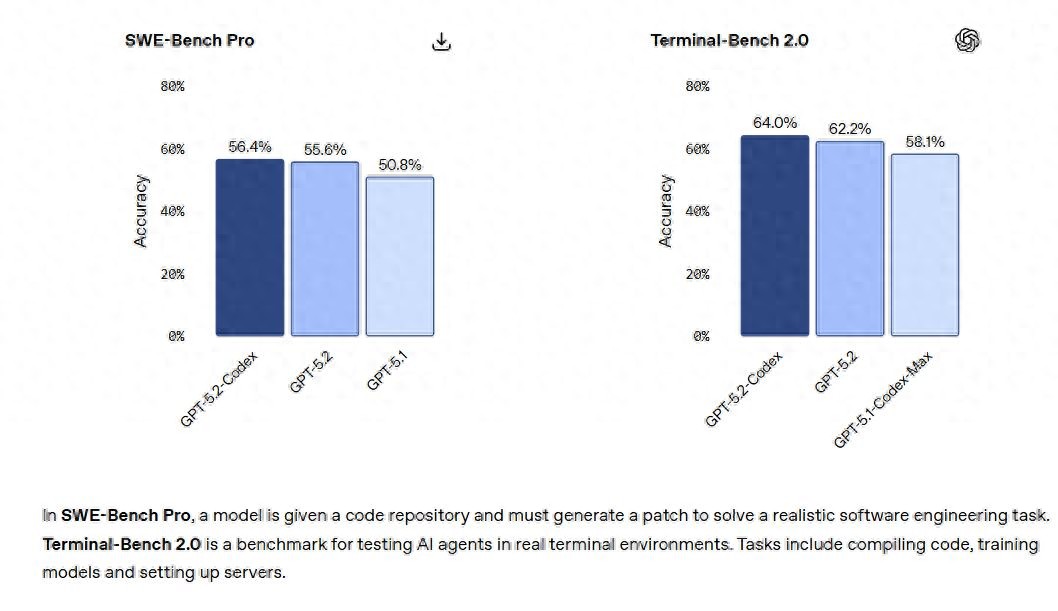

OpenAI表示,GPT-5.2-Codex在编码能力、网络安全性能以及处理长时间任务上都有了新的突破。在SWE-Bench Pro的测试中,它的准确率达到了56.4%,在Terminal-Bench 2.0测试中则达到64.0%,这两个成绩都刷新了之前的纪录。发布当天,这款模型就对所有付费的ChatGPT用户开放,API用户的接入工作也在持续推进中。

OpenAI特别指出,GPT-5.2-Codex在网络安全方面有了显著提升。公司的CEO Sam Altman提到,早些时候,有一名安全研究员使用之前的GPT-5.1-Codex发现了React中的一个可能导致源代码泄露的漏洞,并负责将其报告给相关团队。虽然OpenAI认为新模型目前还未达到“高”级别的网络安全能力,但他们正在为未来的模型做准备,以期达到这个标准。

根据OpenAI的说法,GPT-5.2-Codex在周四发布后,付费ChatGPT用户就可以使用,而API用户的访问权限将在未来几周内安全启用。OpenAI计划通过逐步推出、结合部署与保护措施,并与安全社区密切合作,力求在最大化防御效果的同时,降低被滥用的风险。

这次的发布标志着OpenAI在AI编程领域持续发力。

上周发布GPT-5.2时,OpenAI提到了来自编码初创公司的用户反馈,称该模型具备“最先进的智能体编码性能”,同时还透露GPT-5.2的Thinking版本在SWE编码能力测试中取得了历史最高分,成为OpenAI首个性能达到或超过人类专家水平的模型。这被视为对谷歌Gemini 3在编码和推理能力上好评的直接回应。

编码能力再上台阶,针对实战场景进行优化

GPT-5.2-Codex实际上是对GPT-5.2的深度优化,特别强化了Codex中的智能编码功能。OpenAI表示,新模型在三个重要领域取得了进展:通过上下文压缩提升长时间工作能力,在重构和迁移等项目级任务上有更佳表现,以及在Windows环境中的性能提升。

在基准测试中,GPT-5.2-Codex在SWE-Bench Pro测试中的准确率达到了56.4%,超过了GPT-5.2的55.6%和GPT-5.1的50.8%。在Terminal-Bench 2.0测试中,GPT-5.2-Codex的准确率为64.0%,而GPT-5.2和GPT-5.1分别为62.2%和58.1%。SWE-Bench Pro要求模型在特定的代码库中生成补丁以解决实际软件工程的任务,而Terminal-Bench 2.0则测试AI智能体在真实终端环境中完成编译代码、训练模型和设置服务器的能力。

凭借这些改进,GPT-5.2-Codex能够在大型代码库中进行长时间的工作,保持完整的上下文,更可靠地完成大规模重构、代码迁移和功能构建等复杂任务,即使在计划变更或尝试失败的情况下,也不会失去进展的追踪。

网络安全能力显著提升,准备迎接高级别挑战

网络安全也是GPT-5.2-Codex的一个重要突破领域。OpenAI观察到,从GPT-5-Codex开始,其网络安全能力就有了显著提升,GPT-5.1-Codex-Max又实现了一次飞跃,而现在GPT-5.2-Codex则完成了第三次跃升。

在专业夺旗赛的评估中,GPT-5.2-Codex展现了应对需要专业网络安全技能的复杂多步骤真实挑战的能力。根据OpenAI的准备框架评估,虽然GPT-5.2-Codex尚未达到“高”级别的网络安全能力,但该公司预计未来的AI模型将沿着这一方向不断发展,正在按照每个新模型都有可能达到“高”级别的标准进行规划和评估。

一个真实的案例展示了新模型在防御性网络安全方面的潜力。在12月11日,React团队公开了三个影响使用React服务器组件构建的应用程序的安全漏洞。Stripe旗下Privy公司的首席安全工程师Andrew MacPherson在研究另一个严重漏洞时,意外发现了这些此前未知的漏洞,并负责任地向React团队披露。

Altman在社交平台上分享道:“上周,一名使用我们上一代(Codex)模型的安全研究人员发现并披露了React中可能导致源代码泄露的漏洞。我相信这些模型在网络安全领域会带来积极的影响,而随着它们的不断改进,我们正处在一个‘真实影响阶段’。”

开启可信访问计划,为安全专家提供特权

为了在提升能力的同时确保安全,OpenAI在模型和产品层面上都加强了保护措施,特别是针对有害任务和提示注入这类安全隐患,增加了专门的安全训练、智能体沙箱以及可调节的网络访问功能。与此同时,公司还启动了一个仅限邀请的可信访问计划,进行试点。

这个计划一开始只向经过审查的安全专家和有明确网络安全需求的组织开放。符合条件的参与者将可以使用OpenAI最强大的模型进行防御性工作,帮助他们进行合法的双重用途操作,比如漏洞研究或授权的红队测试,这样就能避免在模拟威胁行为、分析恶意软件或压力测试关键基础设施时遇到的种种限制。

Altman在社交平台X上提到:”我们正着手探索用于防御性网络安全工作的可信访问计划。”他还在另一条信息中为Codex的招聘信息打广告,表示:”Codex已经非常出色,并且会迅速改进。如果你想帮助它在明年变得更好,团队现在在招人。保证会有很多刺激的挑战,成功的机会也很大!”

本文由华尔街见闻提供,欢迎下载APP获取更多精彩内容。